23 KiB

ਮਸ਼ੀਨ ਲਰਨਿੰਗ ਹੱਲਾਂ ਨੂੰ ਜ਼ਿੰਮੇਵਾਰ AI ਨਾਲ ਬਣਾਉਣਾ

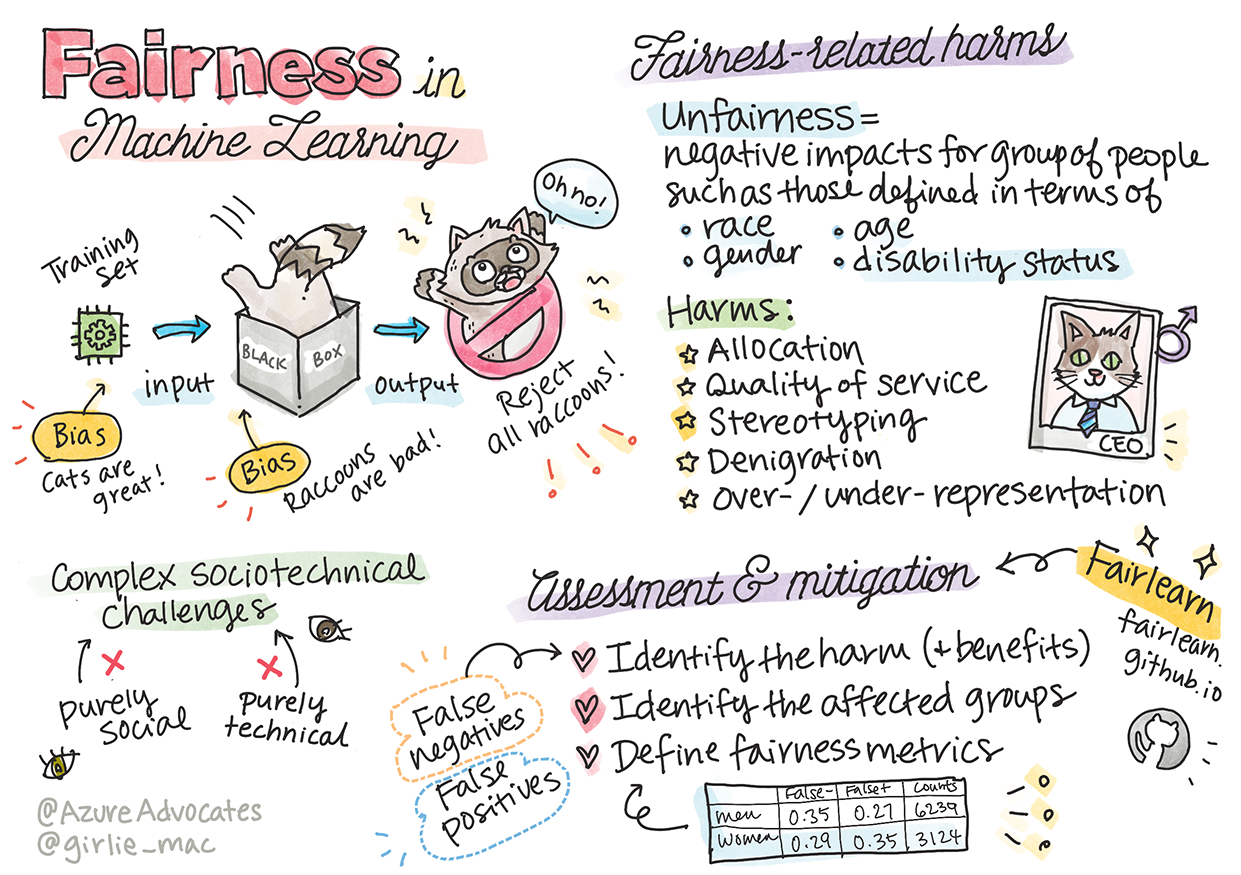

ਸਕੈਚਨੋਟ ਟੋਮੋਮੀ ਇਮੁਰਾ ਦੁਆਰਾ

ਪ੍ਰੀ-ਲੈਕਚਰ ਕਵਿਜ਼

ਪਰਿਚਯ

ਇਸ ਪਾਠਕ੍ਰਮ ਵਿੱਚ, ਤੁਸੀਂ ਇਹ ਪਤਾ ਲਗਾਉਣਾ ਸ਼ੁਰੂ ਕਰੋਗੇ ਕਿ ਮਸ਼ੀਨ ਲਰਨਿੰਗ ਕਿਵੇਂ ਅਤੇ ਕਿੰਨਾ ਸਾਡੇ ਰੋਜ਼ਾਨਾ ਜੀਵਨ ਨੂੰ ਪ੍ਰਭਾਵਿਤ ਕਰ ਰਿਹਾ ਹੈ। ਅੱਜ ਵੀ, ਸਿਸਟਮ ਅਤੇ ਮਾਡਲ ਸਿਹਤ ਸੰਭਾਲ ਨਿਰਣਯ, ਲੋਨ ਅਪ੍ਰੂਵਲ ਜਾਂ ਧੋਖੇ ਦੀ ਪਛਾਣ ਵਰਗੇ ਦਿਨ-ਚਲਣ ਵਾਲੇ ਫੈਸਲੇ ਲੈਣ ਵਾਲੇ ਕੰਮਾਂ ਵਿੱਚ ਸ਼ਾਮਲ ਹਨ। ਇਸ ਲਈ ਇਹ ਜ਼ਰੂਰੀ ਹੈ ਕਿ ਇਹ ਮਾਡਲ ਭਰੋਸੇਯੋਗ ਨਤੀਜੇ ਦੇਣ ਲਈ ਚੰਗਾ ਕੰਮ ਕਰਨ। ਜਿਵੇਂ ਕਿ ਕੋਈ ਵੀ ਸਾਫਟਵੇਅਰ ਐਪਲੀਕੇਸ਼ਨ, AI ਸਿਸਟਮ ਉਮੀਦਾਂ 'ਤੇ ਖਰਾ ਨਹੀਂ ਉਤਰ ਸਕਦੇ ਜਾਂ ਅਣਚਾਹੇ ਨਤੀਜੇ ਦੇ ਸਕਦੇ ਹਨ। ਇਸੇ ਲਈ ਇਹ ਜ਼ਰੂਰੀ ਹੈ ਕਿ AI ਮਾਡਲ ਦੇ ਵਿਹਾਰ ਨੂੰ ਸਮਝਣ ਅਤੇ ਵਿਆਖਿਆ ਕਰਨ ਦੀ ਸਮਰੱਥਾ ਹੋਵੇ।

ਸੋਚੋ ਕਿ ਕੀ ਹੋ ਸਕਦਾ ਹੈ ਜਦੋਂ ਤੁਸੀਂ ਇਹ ਮਾਡਲ ਬਣਾਉਣ ਲਈ ਵਰਤ ਰਹੇ ਡਾਟਾ ਵਿੱਚ ਕੁਝ ਜਾਤੀਆਂ, ਜੈਂਡਰ, ਰਾਜਨੀਤਿਕ ਦ੍ਰਿਸ਼ਟੀਕੋਣ, ਧਰਮ ਜਾਂ ਅਸਮਾਨ ਪ੍ਰਤੀਨਿਧਤਾ ਦੀ ਕਮੀ ਹੋਵੇ। ਜਦੋਂ ਮਾਡਲ ਦਾ ਨਤੀਜਾ ਕੁਝ ਜਾਤੀਆਂ ਨੂੰ ਵਧੇਰੇ ਤਰਜੀਹ ਦੇਣ ਵੱਲ ਵਿਆਖਿਆ ਕੀਤਾ ਜਾਂਦਾ ਹੈ, ਤਾਂ ਐਪਲੀਕੇਸ਼ਨ ਲਈ ਕੀ ਨਤੀਜਾ ਹੋਵੇਗਾ? ਇਸ ਤੋਂ ਇਲਾਵਾ, ਜਦੋਂ ਮਾਡਲ ਦਾ ਨਤੀਜਾ ਨੁਕਸਾਨਦਾਇਕ ਹੋਵੇ ਅਤੇ ਲੋਕਾਂ ਲਈ ਹਾਨਿਕਾਰਕ ਹੋਵੇ, ਤਾਂ ਕੀ ਹੋਵੇਗਾ? AI ਸਿਸਟਮ ਦੇ ਵਿਹਾਰ ਲਈ ਕੌਣ ਜ਼ਿੰਮੇਵਾਰ ਹੈ? ਇਹ ਕੁਝ ਸਵਾਲ ਹਨ ਜੋ ਅਸੀਂ ਇਸ ਪਾਠਕ੍ਰਮ ਵਿੱਚ ਖੋਜਾਂਗੇ।

ਇਸ ਪਾਠ ਵਿੱਚ, ਤੁਸੀਂ:

- ਮਸ਼ੀਨ ਲਰਨਿੰਗ ਵਿੱਚ ਨਿਰਪੱਖਤਾ ਅਤੇ ਇਸ ਨਾਲ ਜੁੜੇ ਨੁਕਸਾਨਾਂ ਦੀ ਮਹੱਤਤਾ ਬਾਰੇ ਜਾਗਰੂਕਤਾ ਵਧਾਉਣਗੇ।

- ਵਿਸ਼ੇਸ਼ ਘਟਨਾਵਾਂ ਅਤੇ ਅਜੀਬ ਸਥਿਤੀਆਂ ਦੀ ਜਾਂਚ ਕਰਨ ਦੀ ਪ੍ਰਕਿਰਿਆ ਨਾਲ ਜਾਣੂ ਹੋਵੋਗੇ ਤਾਂ ਜੋ ਭਰੋਸੇਯੋਗਤਾ ਅਤੇ ਸੁਰੱਖਿਆ ਨੂੰ ਯਕੀਨੀ ਬਣਾਇਆ ਜਾ ਸਕੇ।

- ਸਮਝ ਪ੍ਰਾਪਤ ਕਰੋਗੇ ਕਿ ਸਭ ਨੂੰ ਸ਼ਾਮਲ ਕਰਨ ਵਾਲੇ ਸਿਸਟਮ ਡਿਜ਼ਾਈਨ ਕਰਕੇ ਸਸ਼ਕਤ ਬਣਾਉਣਾ ਕਿੰਨਾ ਜ਼ਰੂਰੀ ਹੈ।

- ਡਾਟਾ ਅਤੇ ਲੋਕਾਂ ਦੀ ਗੋਪਨੀਯਤਾ ਅਤੇ ਸੁਰੱਖਿਆ ਦੀ ਰੱਖਿਆ ਕਰਨ ਦੀ ਮਹੱਤਤਾ ਦੀ ਖੋਜ ਕਰੋਗੇ।

- AI ਮਾਡਲਾਂ ਦੇ ਵਿਹਾਰ ਨੂੰ ਵਿਆਖਿਆ ਕਰਨ ਲਈ ਗਲਾਸ ਬਾਕਸ ਪਹੁੰਚ ਦੀ ਮਹੱਤਤਾ ਦੇਖੋਗੇ।

- ਇਸ ਗੱਲ ਦਾ ਧਿਆਨ ਰੱਖੋਗੇ ਕਿ AI ਸਿਸਟਮ ਵਿੱਚ ਭਰੋਸਾ ਬਣਾਉਣ ਲਈ ਜ਼ਿੰਮੇਵਾਰੀ ਕਿੰਨੀ ਜ਼ਰੂਰੀ ਹੈ।

ਪੂਰਵ-ਸ਼ਰਤ

ਪੂਰਵ-ਸ਼ਰਤ ਵਜੋਂ, ਕਿਰਪਾ ਕਰਕੇ "ਜ਼ਿੰਮੇਵਾਰ AI ਸਿਧਾਂਤ" ਲਰਨ ਪਾਠ ਲਓ ਅਤੇ ਹੇਠਾਂ ਦਿੱਤੇ ਵਿਡੀਓ ਨੂੰ ਦੇਖੋ:

ਜ਼ਿੰਮੇਵਾਰ AI ਬਾਰੇ ਹੋਰ ਜਾਣਕਾਰੀ ਪ੍ਰਾਪਤ ਕਰਨ ਲਈ ਇਸ ਲਰਨਿੰਗ ਪਾਠ ਨੂੰ ਫਾਲੋ ਕਰੋ।

🎥 ਉਪਰ ਦਿੱਤੀ ਤਸਵੀਰ 'ਤੇ ਕਲਿਕ ਕਰੋ: ਮਾਈਕਰੋਸਾਫਟ ਦਾ ਜ਼ਿੰਮੇਵਾਰ AI ਲਈ ਦ੍ਰਿਸ਼ਟੀਕੋਣ

ਨਿਰਪੱਖਤਾ

AI ਸਿਸਟਮ ਨੂੰ ਹਰ ਕਿਸੇ ਨਾਲ ਨਿਰਪੱਖ ਵਿਹਾਰ ਕਰਨਾ ਚਾਹੀਦਾ ਹੈ ਅਤੇ ਸਮਾਨ ਸਮੂਹਾਂ ਨੂੰ ਵੱਖ-ਵੱਖ ਤਰੀਕਿਆਂ ਨਾਲ ਪ੍ਰਭਾਵਿਤ ਕਰਨ ਤੋਂ ਬਚਣਾ ਚਾਹੀਦਾ ਹੈ। ਉਦਾਹਰਣ ਲਈ, ਜਦੋਂ AI ਸਿਸਟਮ ਸਿਹਤ ਇਲਾਜ, ਲੋਨ ਅਰਜ਼ੀਆਂ ਜਾਂ ਰੋਜ਼ਗਾਰ ਬਾਰੇ ਸਲਾਹ ਦਿੰਦੇ ਹਨ, ਤਾਂ ਉਹ ਸਮਾਨ ਲੱਛਣਾਂ, ਵਿੱਤੀ ਹਾਲਾਤਾਂ ਜਾਂ ਪੇਸ਼ੇਵਰ ਯੋਗਤਾਵਾਂ ਵਾਲੇ ਹਰ ਕਿਸੇ ਲਈ ਇੱਕੋ ਜਿਹੇ ਸਿਫਾਰਸ਼ਾਂ ਕਰਨ। ਸਾਡੇ ਵਿੱਚੋਂ ਹਰ ਇੱਕ ਮਨੁੱਖ ਵਿਰਾਸਤ ਵਿੱਚ ਮਿਲੇ ਪੱਖਪਾਤਾਂ ਨੂੰ ਆਪਣੇ ਨਾਲ ਲੈ ਕੇ ਚਲਦਾ ਹੈ ਜੋ ਸਾਡੇ ਫੈਸਲਿਆਂ ਅਤੇ ਕਾਰਵਾਈਆਂ ਨੂੰ ਪ੍ਰਭਾਵਿਤ ਕਰਦੇ ਹਨ। ਇਹ ਪੱਖਪਾਤ ਉਹ ਡਾਟਾ ਵਿੱਚ ਵੀ ਦਿਖਾਈ ਦੇ ਸਕਦੇ ਹਨ ਜੋ ਅਸੀਂ AI ਸਿਸਟਮਾਂ ਨੂੰ ਸਿਖਾਉਣ ਲਈ ਵਰਤਦੇ ਹਾਂ। ਕਈ ਵਾਰ ਇਹ ਮੈਨਿਪੂਲੇਸ਼ਨ ਅਣਜਾਣੇ ਵਿੱਚ ਹੋ ਸਕਦਾ ਹੈ। ਅਕਸਰ ਇਹ ਜਾਣਨਾ ਮੁਸ਼ਕਲ ਹੁੰਦਾ ਹੈ ਕਿ ਤੁਸੀਂ ਡਾਟਾ ਵਿੱਚ ਪੱਖਪਾਤ ਕਦੋਂ ਸ਼ਾਮਲ ਕਰ ਰਹੇ ਹੋ।

"ਅਨਨਿਰਪੱਖਤਾ" ਵਿੱਚ ਨਕਾਰਾਤਮਕ ਪ੍ਰਭਾਵ ਜਾਂ "ਨੁਕਸਾਨ" ਸ਼ਾਮਲ ਹੁੰਦੇ ਹਨ, ਜੋ ਕਿਸੇ ਸਮੂਹ ਲਈ ਹੁੰਦੇ ਹਨ, ਜਿਵੇਂ ਕਿ ਜਾਤੀ, ਜੈਂਡਰ, ਉਮਰ ਜਾਂ ਅਪੰਗਤਾ ਸਥਿਤੀ ਦੇ ਅਧਾਰ 'ਤੇ ਪਰਿਭਾਸ਼ਿਤ। ਨਿਰਪੱਖਤਾ ਨਾਲ ਜੁੜੇ ਮੁੱਖ ਨੁਕਸਾਨਾਂ ਨੂੰ ਹੇਠਾਂ ਦਿੱਤੇ ਤਰੀਕਿਆਂ ਵਿੱਚ ਵਰਗਬੱਧ ਕੀਤਾ ਜਾ ਸਕਦਾ ਹੈ:

- ਵੰਡ, ਜੇਕਰ ਜੈਂਡਰ ਜਾਂ ਜਾਤੀ ਨੂੰ ਦੂਜੇ ਉੱਤੇ ਤਰਜੀਹ ਦਿੱਤੀ ਜਾਵੇ।

- ਸੇਵਾ ਦੀ ਗੁਣਵੱਤਾ। ਜੇਕਰ ਤੁਸੀਂ ਡਾਟਾ ਨੂੰ ਇੱਕ ਖਾਸ ਸਥਿਤੀ ਲਈ ਸਿਖਾਉਂਦੇ ਹੋ ਪਰ ਹਕੀਕਤ ਕਾਫ਼ੀ ਜਟਿਲ ਹੈ, ਤਾਂ ਇਹ ਘੱਟ ਗੁਣਵੱਤਾ ਵਾਲੀ ਸੇਵਾ ਦੀ ਵਜ੍ਹਾ ਬਣਦਾ ਹੈ। ਉਦਾਹਰਣ ਲਈ, ਇੱਕ ਹੱਥ ਸਾਬਣ ਡਿਸਪੈਂਸਰ ਜੋ ਗੂੜ੍ਹੀ ਚਮੜੀ ਵਾਲੇ ਲੋਕਾਂ ਨੂੰ ਸੈਂਸ ਕਰਨ ਵਿੱਚ ਅਸਮਰੱਥ ਸੀ। ਹਵਾਲਾ

- ਨਿੰਦਾ। ਕੁਝ ਜਾਂ ਕਿਸੇ ਨੂੰ ਅਨਨਿਰਪੱਖ ਤਰੀਕੇ ਨਾਲ ਆਲੋਚਨਾ ਕਰਨਾ ਅਤੇ ਲੇਬਲ ਕਰਨਾ। ਉਦਾਹਰਣ ਲਈ, ਇੱਕ ਚਿੱਤਰ ਲੇਬਲਿੰਗ ਤਕਨਾਲੋਜੀ ਨੇ ਕਾਲੇ ਚਮੜੀ ਵਾਲੇ ਲੋਕਾਂ ਦੀਆਂ ਚਿੱਤਰਾਂ ਨੂੰ ਗੋਰਿਲਾ ਵਜੋਂ ਗਲਤ ਲੇਬਲ ਕੀਤਾ।

- ਵੱਧ ਜਾਂ ਘੱਟ ਪ੍ਰਤੀਨਿਧਤਾ। ਇਹ ਵਿਚਾਰ ਕਿ ਇੱਕ ਖਾਸ ਸਮੂਹ ਨੂੰ ਇੱਕ ਖਾਸ ਪੇਸ਼ੇ ਵਿੱਚ ਨਹੀਂ ਦੇਖਿਆ ਜਾਂਦਾ, ਅਤੇ ਕੋਈ ਵੀ ਸੇਵਾ ਜਾਂ ਫੰਕਸ਼ਨ ਜੋ ਇਸ ਨੂੰ ਵਧਾਉਂਦਾ ਹੈ, ਨੁਕਸਾਨ ਪਹੁੰਚਾਉਣ ਵਿੱਚ ਯੋਗਦਾਨ ਪਾਉਂਦਾ ਹੈ।

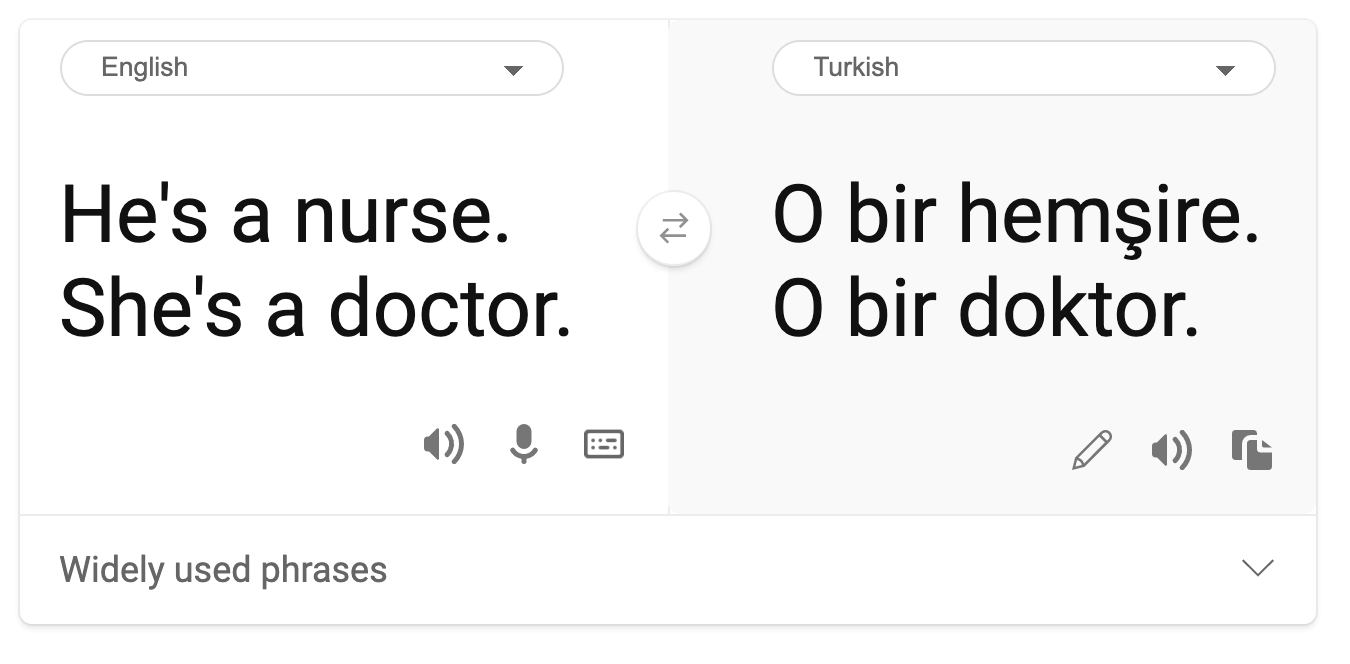

- ਸਟਰਿਓਟਾਈਪਿੰਗ। ਇੱਕ ਦਿੱਤੇ ਸਮੂਹ ਨੂੰ ਪਹਿਲਾਂ ਤੋਂ ਨਿਰਧਾਰਤ ਗੁਣਾਂ ਨਾਲ ਜੋੜਨਾ। ਉਦਾਹਰਣ ਲਈ, ਅੰਗਰੇਜ਼ੀ ਅਤੇ ਤੁਰਕੀ ਦੇ ਵਿਚਕਾਰ ਭਾਸ਼ਾ ਅਨੁਵਾਦ ਸਿਸਟਮ ਵਿੱਚ ਜੈਂਡਰ ਨਾਲ ਜੁੜੇ ਸਟਰਿਓਟਾਈਪਿਕਲ ਸ਼ਬਦਾਂ ਦੇ ਕਾਰਨ ਗਲਤੀਆਂ ਹੋ ਸਕਦੀਆਂ ਹਨ।

ਤੁਰਕੀ ਵਿੱਚ ਅਨੁਵਾਦ

ਵਾਪਸ ਅੰਗਰੇਜ਼ੀ ਵਿੱਚ ਅਨੁਵਾਦ

ਜਦੋਂ AI ਸਿਸਟਮਾਂ ਨੂੰ ਡਿਜ਼ਾਈਨ ਅਤੇ ਟੈਸਟ ਕੀਤਾ ਜਾ ਰਿਹਾ ਹੈ, ਤਾਂ ਇਹ ਯਕੀਨੀ ਬਣਾਉਣਾ ਜ਼ਰੂਰੀ ਹੈ ਕਿ AI ਨਿਰਪੱਖ ਹੈ ਅਤੇ ਪੱਖਪਾਤੀ ਜਾਂ ਵਿਤਕਰਮਕ ਫੈਸਲੇ ਕਰਨ ਲਈ ਪ੍ਰੋਗਰਾਮ ਨਹੀਂ ਕੀਤਾ ਗਿਆ, ਜੋ ਮਨੁੱਖਾਂ ਲਈ ਵੀ ਮਨਾਹੀ ਹੈ। AI ਅਤੇ ਮਸ਼ੀਨ ਲਰਨਿੰਗ ਵਿੱਚ ਨਿਰਪੱਖਤਾ ਦੀ ਗਰੰਟੀ ਦੇਣਾ ਇੱਕ ਜਟਿਲ ਸਮਾਜ-ਤਕਨੀਕੀ ਚੁਣੌਤੀ ਬਣੀ ਰਹਿੰਦੀ ਹੈ।

ਭਰੋਸੇਯੋਗਤਾ ਅਤੇ ਸੁਰੱਖਿਆ

ਭਰੋਸਾ ਬਣਾਉਣ ਲਈ, AI ਸਿਸਟਮਾਂ ਨੂੰ ਆਮ ਅਤੇ ਅਣਪ੍ਰਤੀਕਸ਼ਿਤ ਸਥਿਤੀਆਂ ਵਿੱਚ ਭਰੋਸੇਯੋਗ, ਸੁਰੱਖਿਅਤ ਅਤੇ ਸਥਿਰ ਹੋਣਾ ਚਾਹੀਦਾ ਹੈ। ਇਹ ਜਾਣਨਾ ਮਹੱਤਵਪੂਰਨ ਹੈ ਕਿ AI ਸਿਸਟਮ ਵੱਖ-ਵੱਖ ਸਥਿਤੀਆਂ ਵਿੱਚ ਕਿਵੇਂ ਵਿਹਾਰ ਕਰੇਗਾ, ਖਾਸ ਕਰਕੇ ਜਦੋਂ ਉਹ ਅਜੀਬ ਸਥਿਤੀਆਂ ਵਿੱਚ ਹੋਵੇ। AI ਹੱਲਾਂ ਬਣਾਉਣ ਸਮੇਂ, ਇਹ ਯਕੀਨੀ ਬਣਾਉਣ ਲਈ ਕਾਫ਼ੀ ਧਿਆਨ ਦੇਣ ਦੀ ਲੋੜ ਹੈ ਕਿ AI ਹੱਲਾਂ ਵੱਖ-ਵੱਖ ਸਥਿਤੀਆਂ ਦਾ ਕਿਵੇਂ ਸਫਲਤਾਪੂਰਵਕ ਸਾਮਨਾ ਕਰਦੇ ਹਨ। ਉਦਾਹਰਣ ਲਈ, ਇੱਕ ਸਵੈ-ਚਲਾਉਣ ਵਾਲੀ ਕਾਰ ਨੂੰ ਲੋਕਾਂ ਦੀ ਸੁਰੱਖਿਆ ਨੂੰ ਸਿਖਰ ਤਰਜੀਹ ਦੇਣੀ ਚਾਹੀਦੀ ਹੈ। ਇਸ ਦੇ ਨਤੀਜੇ ਵਜੋਂ, ਕਾਰ ਨੂੰ ਚਲਾਉਣ ਵਾਲੇ AI ਨੂੰ ਉਹ ਸਾਰੇ ਸੰਭਾਵਿਤ ਦ੍ਰਿਸ਼ਾਂ ਨੂੰ ਧਿਆਨ ਵਿੱਚ ਰੱਖਣਾ ਚਾਹੀਦਾ ਹੈ ਜੋ ਕਾਰ ਨੂੰ ਮਿਲ ਸਕਦੇ ਹਨ, ਜਿਵੇਂ ਕਿ ਰਾਤ, ਬਿਜਲੀ ਦੀ ਗਰਜ, ਬਰਫ਼ੀਲੇ ਤੂਫ਼ਾਨ, ਸੜਕ 'ਤੇ ਦੌੜਦੇ ਬੱਚੇ, ਪਾਲਤੂ ਜਾਨਵਰ, ਸੜਕ ਦੇ ਕੰਮ ਆਦਿ। AI ਸਿਸਟਮ ਕਿਸ ਹੱਦ ਤੱਕ ਵੱਖ-ਵੱਖ ਸਥਿਤੀਆਂ ਨੂੰ ਭਰੋਸੇਯੋਗ ਅਤੇ ਸੁਰੱਖਿਅਤ ਤਰੀਕੇ ਨਾਲ ਸੰਭਾਲ ਸਕਦਾ ਹੈ, ਇਹ ਡਾਟਾ ਸਾਇੰਟਿਸਟ ਜਾਂ AI ਡਿਵੈਲਪਰ ਦੁਆਰਾ ਡਿਜ਼ਾਈਨ ਜਾਂ ਟੈਸਟਿੰਗ ਦੌਰਾਨ ਕੀਤੇ ਅਨੁਮਾਨਾਂ ਨੂੰ ਦਰਸਾਉਂਦਾ ਹੈ।

ਸ਼ਾਮਲਤਾ

AI ਸਿਸਟਮਾਂ ਨੂੰ ਹਰ ਕਿਸੇ ਨੂੰ ਸ਼ਾਮਲ ਕਰਨ ਅਤੇ ਸਸ਼ਕਤ ਬਣਾਉਣ ਲਈ ਡਿਜ਼ਾਈਨ ਕੀਤਾ ਜਾਣਾ ਚਾਹੀਦਾ ਹੈ। ਜਦੋਂ AI ਸਿਸਟਮਾਂ ਨੂੰ ਡਿਜ਼ਾਈਨ ਅਤੇ ਲਾਗੂ ਕੀਤਾ ਜਾ ਰਿਹਾ ਹੈ, ਡਾਟਾ ਸਾਇੰਟਿਸਟ ਅਤੇ AI ਡਿਵੈਲਪਰ ਸਿਸਟਮ ਵਿੱਚ ਸੰਭਾਵਿਤ ਰੁਕਾਵਟਾਂ ਦੀ ਪਛਾਣ ਕਰਦੇ ਹਨ ਅਤੇ ਪਤਾ ਲਗਾਉਂਦੇ ਹਨ ਜੋ ਅਣਜਾਣੇ ਵਿੱਚ ਲੋਕਾਂ ਨੂੰ ਬਾਹਰ ਰੱਖ ਸਕਦੇ ਹਨ। ਉਦਾਹਰਣ ਲਈ, ਦੁਨੀਆ ਭਰ ਵਿੱਚ 1 ਬਿਲੀਅਨ ਲੋਕ ਅਪੰਗਤਾ ਨਾਲ ਜੀਵਨ ਬਿਤਾਉਂਦੇ ਹਨ। AI ਦੇ ਵਿਕਾਸ ਨਾਲ, ਉਹ ਆਪਣੇ ਰੋਜ਼ਾਨਾ ਜੀਵਨ ਵਿੱਚ ਵੱਖ-ਵੱਖ ਜਾਣਕਾਰੀ ਅਤੇ ਮੌਕਿਆਂ ਤੱਕ ਆਸਾਨੀ ਨਾਲ ਪਹੁੰਚ ਕਰ ਸਕਦੇ ਹਨ। ਰੁਕਾਵਟਾਂ ਨੂੰ ਦੂਰ ਕਰਕੇ, ਇਹ ਨਵੀਨਤਾ ਅਤੇ AI ਉਤਪਾਦਾਂ ਨੂੰ ਬਿਹਤਰ ਅਨੁਭਵਾਂ ਨਾਲ ਵਿਕਸਿਤ ਕਰਨ ਦੇ ਮੌਕੇ ਪੈਦਾ ਕਰਦਾ ਹੈ ਜੋ ਹਰ ਕਿਸੇ ਨੂੰ ਲਾਭ ਪਹੁੰਚਾਉਂਦੇ ਹਨ।

ਸੁਰੱਖਿਆ ਅਤੇ ਗੋਪਨੀਯਤਾ

AI ਸਿਸਟਮਾਂ ਨੂੰ ਸੁਰੱਖਿਅਤ ਹੋਣਾ ਚਾਹੀਦਾ ਹੈ ਅਤੇ ਲੋਕਾਂ ਦੀ ਗੋਪਨੀਯਤਾ ਦਾ ਆਦਰ ਕਰਨਾ ਚਾਹੀਦਾ ਹੈ। ਲੋਕ ਉਹਨਾਂ ਸਿਸਟਮਾਂ 'ਤੇ ਘੱਟ ਭਰੋਸਾ ਕਰਦੇ ਹਨ ਜੋ ਉਨ੍ਹਾਂ ਦੀ ਗੋਪਨੀਯਤਾ, ਜਾਣਕਾਰੀ ਜਾਂ ਜੀਵਨ ਨੂੰ ਖਤਰੇ ਵਿੱਚ ਪਾਉਂਦੇ ਹਨ। ਮਸ਼ੀਨ ਲਰਨਿੰਗ ਮਾਡਲਾਂ ਨੂੰ ਸਿਖਾਉਣ ਸਮੇਂ, ਅਸੀਂ ਸਭ ਤੋਂ ਵਧੀਆ ਨਤੀਜੇ ਪ੍ਰਾਪਤ ਕਰਨ ਲਈ ਡਾਟਾ 'ਤੇ ਨਿਰਭਰ ਕਰਦੇ ਹਾਂ। ਇਸ ਦੌਰਾਨ, ਡਾਟਾ ਦੀ ਮੂਲ ਸਥਿਤੀ ਅਤੇ ਅਖੰਡਤਾ ਨੂੰ ਧਿਆਨ ਵਿੱਚ ਰੱਖਣਾ ਜ਼ਰੂਰੀ ਹੈ। ਉਦਾਹਰਣ ਲਈ, ਕੀ ਡਾਟਾ ਉਪਭੋਗਤਾ ਦੁਆਰਾ ਸਪੁਰਦ ਕੀਤਾ ਗਿਆ ਸੀ ਜਾਂ ਜਨਤਕ ਤੌਰ 'ਤੇ ਉਪਲਬਧ ਸੀ? ਅਗਲੇ ਕਦਮ ਵਿੱਚ, ਡਾਟਾ ਨਾਲ ਕੰਮ ਕਰਦੇ ਸਮੇਂ, ਇਹ ਜ਼ਰੂਰੀ ਹੈ ਕਿ AI ਸਿਸਟਮਾਂ ਨੂੰ ਵਿਕਸਿਤ ਕੀਤਾ ਜਾਵੇ ਜੋ ਗੁਪਤ ਜਾਣਕਾਰੀ ਦੀ ਰੱਖਿਆ ਕਰ ਸਕਦੇ ਹਨ ਅਤੇ ਹਮਲਿਆਂ ਦਾ ਵਿਰੋਧ ਕਰ ਸਕਦੇ ਹਨ। ਜਿਵੇਂ ਕਿ AI ਵਧ ਰਿਹਾ ਹੈ, ਗੋਪਨੀਯਤਾ ਦੀ ਰੱਖਿਆ ਅਤੇ ਮਹੱਤਵਪੂਰਨ ਨਿੱਜੀ ਅਤੇ ਕਾਰੋਬਾਰੀ ਜਾਣਕਾਰੀ ਦੀ ਸੁਰੱਖਿਆ ਕਰਨਾ ਹੋਰ ਜ਼ਰੂਰੀ ਅਤੇ ਜਟਿਲ ਬਣ ਰਿਹਾ ਹੈ। AI ਲਈ ਗੋਪਨੀਯਤਾ ਅਤੇ ਡਾਟਾ ਸੁਰੱਖਿਆ ਦੇ ਮੁੱਦਿਆਂ ਨੂੰ ਖਾਸ ਧਿਆਨ ਦੀ ਲੋੜ ਹੈ ਕਿਉਂਕਿ ਡਾਟਾ ਤੱਕ ਪਹੁੰਚ AI ਸਿਸਟਮਾਂ ਨੂੰ ਲੋਕਾਂ ਬਾਰੇ ਸਹੀ ਅਤੇ ਜਾਣਕਾਰੀ ਵਾਲੇ ਅਨੁਮਾਨ ਅਤੇ ਫੈਸਲੇ ਕਰਨ ਲਈ ਜ਼ਰੂਰੀ ਹੈ।

- ਉਦਯੋਗ ਵਜੋਂ, ਅਸੀਂ ਗੋਪਨੀਯਤਾ ਅਤੇ ਸੁਰੱਖਿਆ ਵਿੱਚ ਮਹੱਤਵਪੂਰਨ ਤਰੱਕੀ ਕੀਤੀ ਹੈ, ਜੋ ਮੁੱਖ ਤੌਰ 'ਤੇ GDPR (ਜਨਰਲ ਡਾਟਾ ਪ੍ਰੋਟੈਕਸ਼ਨ ਰੈਗੂਲੇਸ਼ਨ) ਵਰਗੇ ਨਿਯਮਾਂ ਦੁਆਰਾ ਚਲਾਈ ਗਈ ਹੈ।

- ਫਿਰ ਵੀ AI ਸਿਸਟਮਾਂ ਨਾਲ, ਸਾਨੂੰ ਇਸ ਤਣਾਅ ਨੂੰ ਮੰਨਣਾ ਪਵੇਗਾ ਕਿ ਸਿਸਟਮਾਂ ਨੂੰ ਹੋਰ ਨਿੱਜੀ ਅਤੇ ਪ੍ਰਭਾਵਸ਼ਾਲੀ ਬਣਾਉਣ ਲਈ ਹੋਰ ਨਿੱਜੀ ਡਾਟਾ ਦੀ ਲੋੜ ਹੈ - ਅਤੇ ਗੋਪਨੀਯਤਾ।

- ਜਿਵੇਂ ਕਿ ਇੰਟਰਨੈਟ ਨਾਲ ਜੁੜੇ ਕੰਪਿਊਟਰਾਂ ਦੇ ਜਨਮ ਨਾਲ, ਅਸੀਂ AI ਨਾਲ ਜੁੜੇ ਸੁਰੱਖਿਆ ਮੁੱਦਿਆਂ ਦੀ ਗਿਣਤੀ ਵਿੱਚ ਵੱਡਾ ਵਾਧਾ ਦੇਖ ਰਹੇ ਹਾਂ।

- ਇਸੇ ਸਮੇਂ, ਅਸੀਂ ਸੁਰੱਖਿਆ ਵਿੱਚ ਸੁਧਾਰ ਕਰਨ ਲਈ AI ਦੀ ਵਰਤੋਂ ਦੇਖੀ ਹੈ। ਉਦਾਹਰਣ ਲਈ, ਅੱਜ ਦੇ ਜ਼ਿਆਦਾਤਰ ਆਧੁਨਿਕ ਐਂਟੀ-ਵਾਇਰਸ ਸਕੈਨਰ AI ਹਿਊਰਿਸਟਿਕਸ ਦੁਆਰਾ ਚਲਾਏ ਜਾਂਦੇ ਹਨ।

- ਸਾਨੂੰ ਯਕੀਨੀ ਬਣਾਉਣਾ ਚਾਹੀਦਾ ਹੈ ਕਿ ਸਾਡੇ ਡਾਟਾ ਸਾਇੰਸ ਪ੍ਰਕਿਰਿਆਵਾਂ ਨਵੀਂ ਗੋਪਨੀਯਤਾ ਅਤੇ ਸੁਰੱਖਿਆ ਪ੍ਰਕਿਰਿਆਵਾਂ ਨਾਲ ਸਦਭਾਵਨਾ ਨਾਲ ਮਿਲਦੀਆਂ ਹਨ।

ਪਾਰਦਰਸ਼ਤਾ

AI ਸਿਸਟਮਾਂ ਨੂੰ ਸਮਝਣਯੋਗ ਹੋਣਾ ਚਾਹੀਦਾ ਹੈ। ਪਾਰਦਰਸ਼ਤਾ ਦਾ ਇੱਕ ਮਹੱਤਵਪੂਰਨ ਹਿੱਸਾ AI ਸਿਸਟਮਾਂ ਅਤੇ ਉਨ੍ਹਾਂ ਦੇ ਘਟਕਾਂ ਦੇ ਵਿਹਾਰ ਦੀ ਵਿਆਖਿਆ ਕਰਨਾ ਹੈ। AI ਸਿਸਟਮਾਂ ਦੀ ਸਮਝ ਵਿੱਚ ਸੁਧਾਰ ਕਰਨ ਲਈ, ਇਹ ਜ਼ਰੂਰੀ ਹੈ ਕਿ ਸਟੇਕਹੋਲਡਰ ਇਹ ਸਮਝਣ ਕਿ ਉਹ ਕਿਵੇਂ ਅਤੇ ਕਿਉਂ ਕੰਮ ਕਰਦੇ ਹਨ ਤਾਂ ਜੋ ਉਹ ਸੰਭਾਵਿਤ ਪ੍ਰਦਰਸ਼ਨ ਮੁੱਦਿਆਂ, ਸੁਰੱਖਿਆ ਅਤੇ ਗੋਪਨੀਯਤਾ ਦੀ ਇਸ ਵਰਕਸ਼ਾਪ ਨੂੰ ਦੇਖੋ ਤਾਂ ਜੋ ਵਿਸ਼ਿਆਂ ਵਿੱਚ ਹੋਰ ਡੂੰਘਾਈ ਨਾਲ ਜਾ ਸਕੋ:

- ਜ਼ਿੰਮੇਵਾਰ AI ਦੀ ਖੋਜ ਵਿੱਚ: ਸਿਧਾਂਤਾਂ ਨੂੰ ਅਮਲ ਵਿੱਚ ਲਿਆਉਣਾ, ਬੇਸਮੀਰਾ ਨੂਸ਼ੀ, ਮਹਰਨੂਸ਼ ਸਮੇਕੀ ਅਤੇ ਅਮਿਤ ਸ਼ਰਮਾ ਦੁਆਰਾ

🎥 ਉਪਰ ਦਿੱਤੀ ਤਸਵੀਰ 'ਤੇ ਕਲਿੱਕ ਕਰੋ ਇੱਕ ਵੀਡੀਓ ਲਈ: RAI Toolbox: ਜ਼ਿੰਮੇਵਾਰ AI ਬਣਾਉਣ ਲਈ ਇੱਕ ਖੁੱਲ੍ਹਾ-ਸਰੋਤ ਫਰੇਮਵਰਕ, ਬੇਸਮੀਰਾ ਨੂਸ਼ੀ, ਮਹਰਨੂਸ਼ ਸਮੇਕੀ ਅਤੇ ਅਮਿਤ ਸ਼ਰਮਾ ਦੁਆਰਾ

ਇਹ ਵੀ ਪੜ੍ਹੋ:

-

ਮਾਈਕਰੋਸਾਫਟ ਦਾ RAI ਰਿਸੋਰਸ ਸੈਂਟਰ: ਜ਼ਿੰਮੇਵਾਰ AI ਰਿਸੋਰਸ – ਮਾਈਕਰੋਸਾਫਟ AI

-

ਮਾਈਕਰੋਸਾਫਟ ਦਾ FATE ਰਿਸਰਚ ਗਰੁੱਪ: FATE: AI ਵਿੱਚ ਨਿਰਪੱਖਤਾ, ਜਵਾਬਦੇਹੀ, ਪਾਰਦਰਸ਼ਤਾ ਅਤੇ ਨੈਤਿਕਤਾ - ਮਾਈਕਰੋਸਾਫਟ ਰਿਸਰਚ

RAI Toolbox:

Azure Machine Learning ਦੇ ਸਾਧਨਾਂ ਬਾਰੇ ਪੜ੍ਹੋ ਜੋ ਨਿਰਪੱਖਤਾ ਨੂੰ ਯਕੀਨੀ ਬਣਾਉਂਦੇ ਹਨ:

ਅਸਾਈਨਮੈਂਟ

ਅਸਵੀਕਤੀ:

ਇਹ ਦਸਤਾਵੇਜ਼ AI ਅਨੁਵਾਦ ਸੇਵਾ Co-op Translator ਦੀ ਵਰਤੋਂ ਕਰਕੇ ਅਨੁਵਾਦ ਕੀਤਾ ਗਿਆ ਹੈ। ਜਦੋਂ ਕਿ ਅਸੀਂ ਸਹੀਤਾ ਲਈ ਯਤਨਸ਼ੀਲ ਹਾਂ, ਕਿਰਪਾ ਕਰਕੇ ਧਿਆਨ ਦਿਓ ਕਿ ਸਵੈਚਾਲਿਤ ਅਨੁਵਾਦਾਂ ਵਿੱਚ ਗਲਤੀਆਂ ਜਾਂ ਅਸੁਚੀਤਤਾਵਾਂ ਹੋ ਸਕਦੀਆਂ ਹਨ। ਮੂਲ ਦਸਤਾਵੇਜ਼ ਨੂੰ ਇਸਦੀ ਮੂਲ ਭਾਸ਼ਾ ਵਿੱਚ ਅਧਿਕਾਰਤ ਸਰੋਤ ਮੰਨਿਆ ਜਾਣਾ ਚਾਹੀਦਾ ਹੈ। ਮਹੱਤਵਪੂਰਨ ਜਾਣਕਾਰੀ ਲਈ, ਪੇਸ਼ੇਵਰ ਮਨੁੱਖੀ ਅਨੁਵਾਦ ਦੀ ਸਿਫਾਰਸ਼ ਕੀਤੀ ਜਾਂਦੀ ਹੈ। ਇਸ ਅਨੁਵਾਦ ਦੀ ਵਰਤੋਂ ਤੋਂ ਪੈਦਾ ਹੋਣ ਵਾਲੇ ਕਿਸੇ ਵੀ ਗਲਤਫਹਿਮੀ ਜਾਂ ਗਲਤ ਵਿਆਖਿਆ ਲਈ ਅਸੀਂ ਜ਼ਿੰਮੇਵਾਰ ਨਹੀਂ ਹਾਂ।