38 KiB

जिम्मेवार AI को साथमा मेसिन लर्निङ समाधान निर्माण गर्नुहोस्

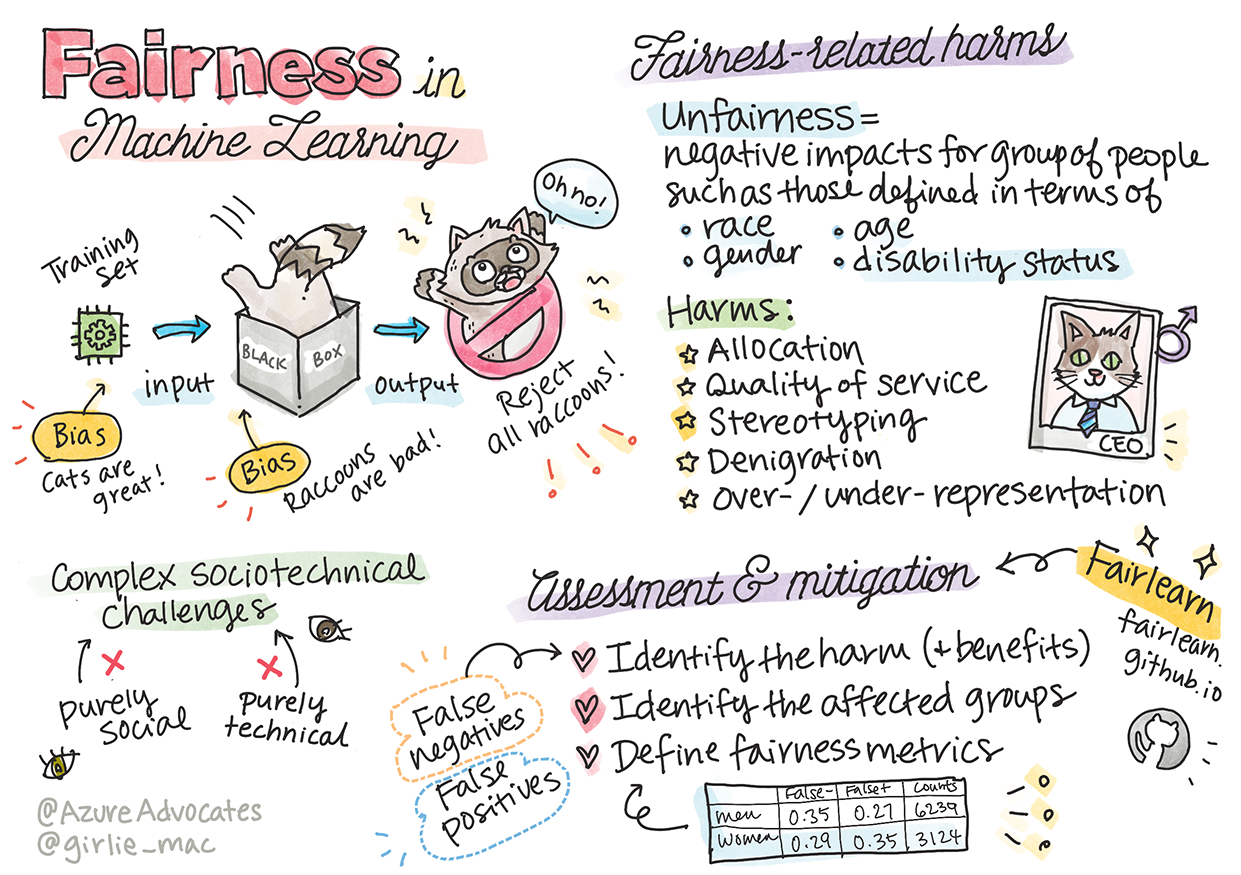

स्केच नोट Tomomi Imura द्वारा

पाठ अघि क्विज

परिचय

यस पाठ्यक्रममा, तपाईंले मेसिन लर्निङले कसरी हाम्रो दैनिक जीवनलाई प्रभाव पार्दैछ भन्ने कुरा पत्ता लगाउन सुरु गर्नुहुनेछ। अहिले पनि, प्रणालीहरू र मोडेलहरू स्वास्थ्य सेवा निदान, ऋण स्वीकृति, वा ठगी पत्ता लगाउने जस्ता दैनिक निर्णय गर्ने कार्यहरूमा संलग्न छन्। त्यसैले, यी मोडेलहरूले विश्वासयोग्य परिणामहरू प्रदान गर्न राम्रोसँग काम गर्नु महत्त्वपूर्ण छ। कुनै पनि सफ्टवेयर अनुप्रयोग जस्तै, AI प्रणालीहरूले अपेक्षाहरू पूरा गर्न नसक्न सक्छन् वा अवांछित परिणाम दिन सक्छन्। यही कारणले AI मोडेलको व्यवहारलाई बुझ्न र व्याख्या गर्न सक्षम हुनु आवश्यक छ।

कल्पना गर्नुहोस् कि तपाईंले यी मोडेलहरू निर्माण गर्न प्रयोग गर्ने डाटामा जात, लिङ्ग, राजनीतिक दृष्टिकोण, धर्म जस्ता जनसांख्यिकीय तत्वहरू अभाव छन् वा ती जनसांख्यिकीय तत्वहरू असमान रूपमा प्रतिनिधित्व गरिएका छन् भने के हुन्छ। मोडेलको परिणामले कुनै जनसांख्यिकीयलाई प्राथमिकता दिएको रूपमा व्याख्या गरिन्छ भने के हुन्छ? अनुप्रयोगको लागि परिणाम के हो? साथै, मोडेलले हानिकारक परिणाम दिन्छ भने के हुन्छ? AI प्रणालीको व्यवहारको लागि को जिम्मेवार छ? यी केही प्रश्नहरू हामी यस पाठ्यक्रममा अन्वेषण गर्नेछौं।

यस पाठमा, तपाईं:

- मेसिन लर्निङमा निष्पक्षताको महत्त्व र निष्पक्षता सम्बन्धी हानिहरूको बारेमा सचेत हुनुहुनेछ।

- असामान्य परिदृश्यहरू अन्वेषण गर्ने अभ्याससँग परिचित हुनुहुनेछ ताकि विश्वसनीयता र सुरक्षा सुनिश्चित गर्न सकियोस्।

- समावेशी प्रणालीहरू डिजाइन गरेर सबैलाई सशक्त बनाउने आवश्यकता बुझ्नुहुनेछ।

- डाटा र व्यक्तिहरूको गोपनीयता र सुरक्षाको रक्षा गर्न कति महत्त्वपूर्ण छ भन्ने कुरा अन्वेषण गर्नुहुनेछ।

- AI मोडेलहरूको व्यवहार व्याख्या गर्न "ग्लास बक्स" दृष्टिकोणको महत्त्व देख्नुहुनेछ।

- AI प्रणालीहरूमा विश्वास निर्माण गर्न जिम्मेवारी कति आवश्यक छ भन्ने कुरा ध्यान दिनुहुनेछ।

पूर्वआवश्यकता

पूर्वआवश्यकताका रूपमा, कृपया "जिम्मेवार AI सिद्धान्तहरू" सिक्ने मार्ग लिनुहोस् र तलको भिडियो हेर्नुहोस्:

जिम्मेवार AI को बारेमा थप जान्नका लागि यो सिक्ने मार्ग अनुसरण गर्नुहोस्।

🎥 माथिको छवि क्लिक गर्नुहोस्: Microsoft को जिम्मेवार AI को दृष्टिकोण

निष्पक्षता

AI प्रणालीहरूले सबैलाई निष्पक्ष रूपमा व्यवहार गर्नुपर्छ र समान समूहका व्यक्तिहरूलाई फरक तरिकाले असर गर्नबाट बच्नुपर्छ। उदाहरणका लागि, जब AI प्रणालीहरूले चिकित्सा उपचार, ऋण आवेदन, वा रोजगारको सन्दर्भमा मार्गदर्शन प्रदान गर्छन्, तिनीहरूले समान लक्षण, वित्तीय अवस्था, वा व्यावसायिक योग्यता भएका सबैलाई समान सिफारिसहरू दिनुपर्छ। हामी प्रत्येक मानिसले हाम्रो निर्णय र कार्यहरूलाई प्रभावित गर्ने पूर्वाग्रहहरू बोक्छौं। यी पूर्वाग्रहहरू हामीले AI प्रणालीहरूलाई प्रशिक्षण दिन प्रयोग गर्ने डाटामा देखिन सक्छ। यस्तो हेरफेर कहिलेकाहीँ अनजानेमा हुन सक्छ। डाटामा पूर्वाग्रह परिचय गराउँदा तपाईं सचेत रूपमा थाहा पाउन कठिन हुन सक्छ।

**"असमानता"**ले एक समूहका व्यक्तिहरूका लागि नकारात्मक प्रभावहरू वा "हानिहरू" समेट्छ, जस्तै जात, लिङ्ग, उमेर, वा अपाङ्गता स्थितिको सन्दर्भमा परिभाषित। मुख्य निष्पक्षता सम्बन्धी हानिहरूलाई निम्न प्रकारले वर्गीकृत गर्न सकिन्छ:

- आवंटन, यदि लिङ्ग वा जातीयता उदाहरणका लागि अर्कोको तुलनामा प्राथमिकता दिइन्छ।

- सेवाको गुणस्तर। यदि तपाईंले एक विशिष्ट परिदृश्यको लागि डाटा प्रशिक्षण दिनुभयो तर वास्तविकता धेरै जटिल छ भने, यसले खराब प्रदर्शन गर्ने सेवामा परिणत हुन्छ। उदाहरणका लागि, एउटा हात साबुन डिस्पेन्सरले गाढा छालाका व्यक्तिहरूलाई पहिचान गर्न नसक्ने समस्या। सन्दर्भ

- निन्दा। कुनै कुरा वा कसैलाई अन्यायपूर्ण रूपमा आलोचना र लेबल लगाउनु। उदाहरणका लागि, छविलाई लेबल गर्ने प्रविधिले गाढा छालाका व्यक्तिहरूलाई गोरिल्ला भनेर गलत लेबल लगाएको थियो।

- अधिक वा कम प्रतिनिधित्व। विचार यो हो कि कुनै समूहलाई कुनै पेशामा देखिँदैन, र कुनै पनि सेवा वा कार्यले त्यसलाई निरन्तर प्रवर्द्धन गरिरहन्छ भने त्यो हानिमा योगदान पुर्याउँछ।

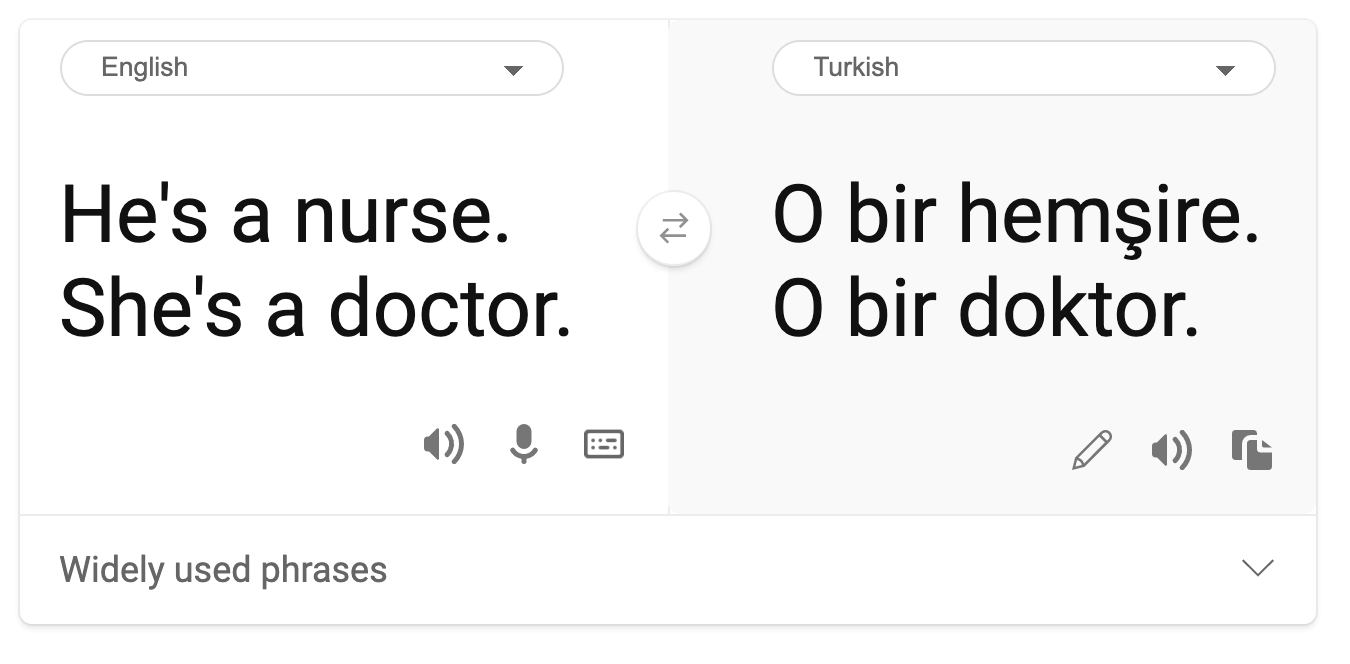

- रूढिवादी सोच। कुनै समूहलाई पूर्वनिर्धारित विशेषतासँग जोड्नु। उदाहरणका लागि, अंग्रेजी र टर्किश बीचको भाषा अनुवाद प्रणालीमा लिङ्गसँग रूढिवादी सम्बन्ध भएका शब्दहरूको कारण त्रुटिहरू हुन सक्छ।

टर्किशमा अनुवाद

अंग्रेजीमा पुन: अनुवाद

AI प्रणालीहरू डिजाइन र परीक्षण गर्दा, हामीले सुनिश्चित गर्नुपर्छ कि AI निष्पक्ष छ र पूर्वाग्रही वा भेदभावपूर्ण निर्णयहरू गर्न प्रोग्राम गरिएको छैन, जुन मानिसहरूलाई पनि गर्न निषेध गरिएको छ। AI र मेसिन लर्निङमा निष्पक्षता सुनिश्चित गर्नु एक जटिल सामाजिक-प्राविधिक चुनौती हो।

विश्वसनीयता र सुरक्षा

विश्वास निर्माण गर्न, AI प्रणालीहरू विश्वसनीय, सुरक्षित, र सामान्य र अप्रत्याशित अवस्थाहरूमा स्थिर हुनुपर्छ। विभिन्न परिस्थितिहरूमा AI प्रणालीहरूको व्यवहार कस्तो हुन्छ भन्ने कुरा जान्न महत्त्वपूर्ण छ, विशेष गरी जब तिनीहरू असामान्य हुन्छन्। AI समाधानहरू निर्माण गर्दा, AI समाधानहरूले सामना गर्ने विभिन्न परिस्थितिहरूलाई कसरी व्यवस्थापन गर्ने भन्ने कुरामा पर्याप्त ध्यान दिन आवश्यक छ। उदाहरणका लागि, एक स्वचालित कारले मानिसहरूको सुरक्षालाई शीर्ष प्राथमिकतामा राख्नुपर्छ। नतिजा स्वरूप, कारलाई शक्ति दिने AI ले रात, आँधीबेहरी, वा हिउँको आँधी, सडकमा दौडिरहेका बच्चाहरू, घरपालुवा जनावरहरू, सडक निर्माणहरू जस्ता सबै सम्भावित परिदृश्यहरू विचार गर्नुपर्छ। AI प्रणालीले विभिन्न अवस्थाहरूलाई विश्वसनीय र सुरक्षित रूपमा कसरी व्यवस्थापन गर्न सक्छ भन्ने कुरा डाटा वैज्ञानिक वा AI विकासकर्ताले प्रणालीको डिजाइन वा परीक्षणको क्रममा कति अनुमान गरेको छ भन्ने स्तरलाई प्रतिबिम्बित गर्दछ।

समावेशिता

AI प्रणालीहरू सबैलाई संलग्न र सशक्त बनाउन डिजाइन गरिनुपर्छ। AI प्रणालीहरू डिजाइन र कार्यान्वयन गर्दा डाटा वैज्ञानिकहरू र AI विकासकर्ताहरूले प्रणालीमा सम्भावित बाधाहरू पहिचान र सम्बोधन गर्छन् जसले अनजानेमा व्यक्तिहरूलाई बहिष्कृत गर्न सक्छ। उदाहरणका लागि, विश्वभर १ अर्ब अपाङ्गता भएका व्यक्तिहरू छन्। AI को प्रगतिसँगै, उनीहरूले आफ्नो दैनिक जीवनमा जानकारी र अवसरहरूको विस्तृत दायरा सजिलैसँग पहुँच गर्न सक्छन्। बाधाहरूलाई सम्बोधन गरेर, यसले सबैलाई लाभ दिने राम्रो अनुभवहरू भएका AI उत्पादनहरू नवाचार र विकास गर्ने अवसर सिर्जना गर्दछ।

सुरक्षा र गोपनीयता

AI प्रणालीहरू सुरक्षित हुनुपर्छ र व्यक्तिहरूको गोपनीयताको सम्मान गर्नुपर्छ। प्रणालीहरूले व्यक्तिको गोपनीयता, जानकारी, वा जीवनलाई जोखिममा राख्छन् भने मानिसहरूले प्रणालीप्रति कम विश्वास गर्छन्। मेसिन लर्निङ मोडेलहरू प्रशिक्षण गर्दा, हामीले उत्कृष्ट परिणामहरू उत्पादन गर्न डाटामा निर्भर गर्दछौं। यसो गर्दा, डाटाको उत्पत्ति र अखण्डता विचार गर्नुपर्छ। उदाहरणका लागि, डाटा प्रयोगकर्ताले प्रस्तुत गरेको हो वा सार्वजनिक रूपमा उपलब्ध छ? त्यसपछि, डाटासँग काम गर्दा, गोपनीय जानकारीको रक्षा गर्न र आक्रमणको प्रतिरोध गर्न सक्ने AI प्रणालीहरू विकास गर्नु महत्त्वपूर्ण छ। AI अधिक व्यापक हुँदै जाँदा, गोपनीयता संरक्षण र महत्त्वपूर्ण व्यक्तिगत र व्यावसायिक जानकारी सुरक्षित राख्न अझ महत्त्वपूर्ण र जटिल हुँदैछ। गोपनीयता र डाटा सुरक्षा मुद्दाहरूले AI को लागि विशेष ध्यान आवश्यक छ किनभने डाटामा पहुँचले AI प्रणालीहरूलाई व्यक्तिहरूको बारेमा सटीक र सूचित भविष्यवाणी र निर्णय गर्न सक्षम बनाउँछ।

- उद्योगका रूपमा हामीले गोपनीयता र सुरक्षामा महत्त्वपूर्ण प्रगति गरेका छौं, GDPR (General Data Protection Regulation) जस्ता नियमहरूले महत्त्वपूर्ण रूपमा प्रेरित।

- तर AI प्रणालीहरूसँग हामीले स्वीकार गर्नुपर्छ कि प्रणालीलाई अधिक व्यक्तिगत र प्रभावकारी बनाउन थप व्यक्तिगत डाटाको आवश्यकता र गोपनीयताको बीचमा तनाव छ।

- इन्टरनेटको साथमा जडित कम्प्युटरहरूको जन्मसँगै, हामी AI सम्बन्धित सुरक्षा मुद्दाहरूको संख्या बढेको देखिरहेका छौं।

- त्यही समयमा, हामीले सुरक्षा सुधार गर्न AI प्रयोग भएको देखेका छौं। उदाहरणका लागि, अधिकांश आधुनिक एन्टी-भाइरस स्क्यानरहरू आज AI ह्युरिस्टिक्सद्वारा संचालित छन्।

- हामीले सुनिश्चित गर्नुपर्छ कि हाम्रो डाटा विज्ञान प्रक्रिया नवीनतम गोपनीयता र सुरक्षा अभ्यासहरूसँग सुसंगत रूपमा मिश्रित छ।

पारदर्शिता

AI प्रणालीहरू बुझ्न सकिने हुनुपर्छ। पारदर्शिताको एक महत्त्वपूर्ण भाग AI प्रणालीहरूको व्यवहार र तिनीहरूको घटकहरूको व्याख्या गर्नु हो। AI प्रणालीहरूको बुझाइ सुधार गर्नको लागि सरोकारवालाहरूले तिनीहरू कसरी र किन काम गर्छन् भन्ने कुरा बुझ्न आवश्यक छ ताकि तिनीहरूले सम्भावित प्रदर्शन समस्याहरू, सुरक्षा र गोपनीयता चिन्ताहरू, पूर्वाग्रहहरू, बहिष्करण अभ्यासहरू, वा अनपेक्षित परिणामहरू पहिचान गर्न सकून्। हामी विश्वास गर्छौं कि AI प्रणालीहरू प्रयोग गर्नेहरूले तिनीहरूलाई कहिले, किन, र कसरी प्रयोग गर्ने निर्णय लिँदा इमानदार र स्पष्ट हुनुपर्छ। साथै तिनीहरूले प्रयोग गर्ने प्रणालीहरूको सीमाहरू। उदाहरणका लागि, यदि बैंकले उपभोक्ता ऋण निर्णयहरू समर्थन गर्न AI प्रणाली प्रयोग गर्छ भने, परिणामहरूको परीक्षण गर्नु र प्रणालीको सिफारिसहरूलाई प्रभावित गर्ने डाटालाई बुझ्नु महत्त्वपूर्ण छ। सरकारहरूले उद्योगहरूमा AI नियमन गर्न सुरु गरिरहेका छन्, त्यसैले डाटा वैज्ञानिकहरू र संगठनहरूले AI प्रणालीले नियामक आवश्यकताहरू पूरा गर्छ कि गर्दैन भन्ने कुरा व्याख्या गर्नुपर्छ, विशेष गरी जब अवांछित परिणाम हुन्छ।

- AI प्रणालीहरू यति जटिल छन् कि तिनीहरू कसरी काम गर्छन् र परिणामहरूको व्याख्या गर्न गाह्रो छ।

- यो बुझाइको अभावले यी प्रणालीहरू कसरी व्यवस्थापन गरिन्छ, सञ्चालन गरिन्छ, र कागजात गरिन्छ भन्ने कुरालाई असर गर्छ।

- यो बुझाइको अभावले अझ महत्त्वपूर्ण रूपमा यी प्रणालीहरूले उत्पादन गर्ने परिणामहरू प्रयोग गरेर गरिएका निर्णयहरूलाई असर गर्छ।

जिम्मेवारी

AI प्रणालीहरू डिजाइन र तैनात गर्ने व्यक्तिहरूले तिनीहरूको प्रणालीहरू कसरी सञ्चालन गर्छन् भन्ने कुराको लागि जिम्मेवार हुनुपर्छ। जिम्मेवारीको आवश्यकता विशेष रूपमा संवेदनशील प्रयोग प्रविधिहरू जस्तै अनुहार पहिचानको साथमा महत्त्वपूर्ण छ। हालै, अनुहार पहिचान प्रविधिको माग बढ्दै गएको छ, विशेष गरी कानून प्रवर्तन संगठनहरूबाट जसले हराएका बच्चाहरूलाई फेला पार्न जस्ता प्रयोगहरूमा प्रविधिको सम्भावना देख्छन्। तर, यी प्रविधिहरूले सरकारलाई नागरिकहरूको मौलिक स्वतन्त्रतालाई जोखिममा राख्न सक्ने सम्भावना छ, उदाहरणका लागि, विशिष्ट व्यक्तिहरूको निरन्तर निगरानी सक्षम गरेर। त्यसैले, डाटा वैज्ञानिकहरू र संगठनहरूले तिनीहरूको AI प्रणालीले व्यक्तिहरू वा समाजलाई कसरी प्रभाव पार्छ भन्ने कुराको लागि जिम्मेवार हुनुपर्छ।

🎥 माथिको छवि क्लिक गर्नुहोस्: अनुहार पहिचान मार्फत व्यापक निगरानीको चेतावनी

अन्ततः हाम्रो पुस्ताका लागि सबैभन्दा ठूलो प्रश्न, AI लाई समाजमा ल्याउने पहिलो पुस्ताका रूपमा, कम्प्युटरहरू मानिसहरूलाई जिम्मेवार रहन कसरी सुनिश्चित गर्ने र कम्प्युटर डिजाइन गर्ने व्यक्तिहरू सबैलाई जिम्मेवार रहन कसरी सुनिश्चित गर्ने भन्ने हो।

प्रभाव मूल्याङ्कन

मेसिन लर्निङ मोडेल प्रशिक्षण गर्नु अघि, AI प्रणालीको उद्देश्य बुझ्न, यसको इच्छित प्रयोग के हो, यो कहाँ तैनात हुनेछ, र प्रणालीसँग को अन्तर्क्रिया गर्नेछ भन्ने कुरा बुझ्न प्रभाव मूल्याङ्कन गर्नु महत्त्वपूर्ण छ। यी समीक्षक(हरू) वा प्रणालीको मूल्याङ्कन गर्ने परीक्षकहरूलाई सम्भावित जोखिमहरू र अपेक्षित परिणामहरू पहिचान गर्दा विचार गर्नुपर्ने कारकहरू थाहा पाउन उपयोगी हुन्छन्।

प्रभाव मूल्याङ्कन गर्दा ध्यान दिनुपर्ने क्षेत्रहरू निम्न छन्:

- व्यक्तिहरूमा प्रतिकूल प्रभाव। प्रणालीको प्रदर्शनलाई बाधा पुर्याउने कुनै पनि प्रतिबन्ध वा आवश्यकताहरू, असमर्थित प्रयोग वा कुनै ज्ञात सीमाहरूको बारेमा सचेत हुनु प्रणालीलाई व्यक्तिहरूलाई हानि पुर्याउने तरिकामा प्रयोग नगरिने सुनिश्चित गर्न महत्त्वपूर्ण छ।

- डाटा आवश्यकताहरू। प्रणालीले डाटालाई कसरी र कहाँ प्रयोग गर्नेछ भन्ने कुरा बुझ्दा समीक्षकहरूले तपाईंले ध्यान दिनुपर्ने कुनै पनि डाटा आवश्यकताहरू (जस्तै, GDPR वा HIPPA डाटा नियमहरू) अन्वेषण गर्न सक्षम बनाउँछ। साथै, प्रशिक्षणको लागि स्रोत वा डाटाको मात्रा पर्याप्त छ कि छैन भन्ने कुरा जाँच गर्नुहोस्।

- प्रभावको सारांश। प्रणाली प्रयोग गर्दा उत्पन्न हुन सक्ने सम्भावित हानिहरूको सूची संकलन गर्नुहोस्। ML जीवनचक्रभरि, पहिचान गरिएका मुद्दाहरूलाई कम गरिएको छ वा सम्बोधन गरिएको छ कि छैन भन्ने कुरा समीक्षा गर्नुहोस्।

- छ वटा मुख्य सिद्धान्तहरूको लागि लागू हुने लक्ष्यहरू। प्रत्येक सिद्धान्तबाट लक्ष्यहरू पूरा भएका छन् कि छैनन् र कुनै पनि अन्तराल छन् कि छैनन् भन्ने कुरा मूल्याङ्कन गर्नुहोस्।

जिम्मेवार AI को साथमा डिबगिङ

सफ्टवेयर अनुप्रयोग डिबगिङ जस्तै, AI प्रणाली डिबगिङ प्रणालीमा समस्या पहिचान र समाधान गर्ने आवश्यक प्रक्रिया हो। प्रणालीले अपेक्षित रूपमा वा जिम्मेवार रूपमा प्रदर्शन नगर्ने मोडेललाई असर गर्ने धेरै कारकहरू छन्। अधिकांश परम्परागत मोडेल प्रदर्शन मेट्रिक्स मोडेलको प्रदर्शनको मात्रात्मक समग्र हुन्, जसले जिम्मेवार AI सिद्धान्तहरू उल्लङ्घन गर्ने मोडेललाई विश्लेषण गर्न पर्याप्त छैन। थप रूपमा, मेसिन लर्निङ मोडेल एक ब्ल्याक बक्स हो जसले यसको परिणामलाई के चलाउँछ भन्ने कुरा बुझ्न वा गल्ती गर्दा व्याख्या प्रदान गर्न गाह्रो बनाउँछ। पछि यस पाठ्यक्रममा, हामी जिम्मेवार AI ड्यासबोर्ड प्रयोग गरेर AI प्रणालीहरू डिबग गर्ने तरिका सिक्नेछौं। ड्यासबोर्डले डाटा वैज्ञानिकहरू र AI विकासकर्ताहरूलाई निम्न कार्यहरू गर्न समग्र उपकरण प्रदान गर्दछ:

- त्रुटि विश्लेषण। प्रणालीको निष्पक्षता वा विश्वसनीयतालाई असर गर्न सक्ने मोडेलको त्रुटि वितरण पहिचान गर्न।

- मोडेल अवलोकन। मोडेलको प्रदर्शनमा डाटा समूहहरूमा असमानता कहाँ छ भनेर पत्ता लगाउन।

- डाटा विश्लेषण। डाटा वितरण बुझ्न र डाटामा सम्भावित पूर्वाग्रह पहिचान गर्न जसले निष्पक्षता, समावेशिता, र विश्वसनीयता समस्याहरू निम्त्याउन सक्छ।

- मोडेल व्याख्या। मोडेलको भविष्यवाणीलाई के असर गर्छ वा प्रभाव पार्छ भन्ने कुरा बुझ्न। यसले मोडेलको व्यवहार व्याख्या गर्न मद्दत गर्दछ, जुन पारदर्शिता र जिम्मेवारीको लागि महत्त्वपूर्ण छ।

🚀 चुनौती

हानिहरूलाई सुरुमा नै परिचय गराउनबाट रोक्नका लागि, हामीले:

-

प्रणालीमा काम गर्ने व्यक्तिहरूको पृष्ठभूमि र दृष्टिकोणको विविधता हुनुपर्छ।

-

हाम्रो समाजको विविधतालाई प्रतिबिम्बित गर्ने डाटासेटहरूमा लगानी गर्नुपर्छ।

-

मेसिन लर्निङ जीवनचक्रभरि जिम्मेवार AI पत्ता लगाउने र यो कार्यशाला हेरेर विषयवस्तुमा गहिरो जानकारी लिनुहोस्:

-

जिम्मेवार AI को खोजमा: सिद्धान्तलाई व्यवहारमा ल्याउने Besmira Nushi, Mehrnoosh Sameki र Amit Sharma द्वारा

🎥 माथिको चित्रमा क्लिक गर्नुहोस् भिडियोका लागि: RAI Toolbox: जिम्मेवार AI निर्माणका लागि खुला स्रोत फ्रेमवर्क Besmira Nushi, Mehrnoosh Sameki, र Amit Sharma द्वारा

यसलाई पनि पढ्नुहोस्:

-

Microsoft को RAI स्रोत केन्द्र: Responsible AI Resources – Microsoft AI

-

Microsoft को FATE अनुसन्धान समूह: FATE: Fairness, Accountability, Transparency, and Ethics in AI - Microsoft Research

RAI Toolbox:

Azure Machine Learning को उपकरणहरूबारे पढ्नुहोस् जसले निष्पक्षता सुनिश्चित गर्छ:

असाइनमेन्ट

अस्वीकरण:

यो दस्तावेज़ AI अनुवाद सेवा Co-op Translator प्रयोग गरेर अनुवाद गरिएको छ। हामी शुद्धताको लागि प्रयास गर्छौं, तर कृपया ध्यान दिनुहोस् कि स्वचालित अनुवादहरूमा त्रुटि वा अशुद्धता हुन सक्छ। यसको मूल भाषा मा रहेको मूल दस्तावेज़लाई आधिकारिक स्रोत मानिनुपर्छ। महत्वपूर्ण जानकारीको लागि, व्यावसायिक मानव अनुवाद सिफारिस गरिन्छ। यस अनुवादको प्रयोगबाट उत्पन्न हुने कुनै पनि गलतफहमी वा गलत व्याख्याको लागि हामी जिम्मेवार हुने छैनौं।