35 KiB

मशीन लर्निंगसह जबाबदार AI उपाय तयार करणे

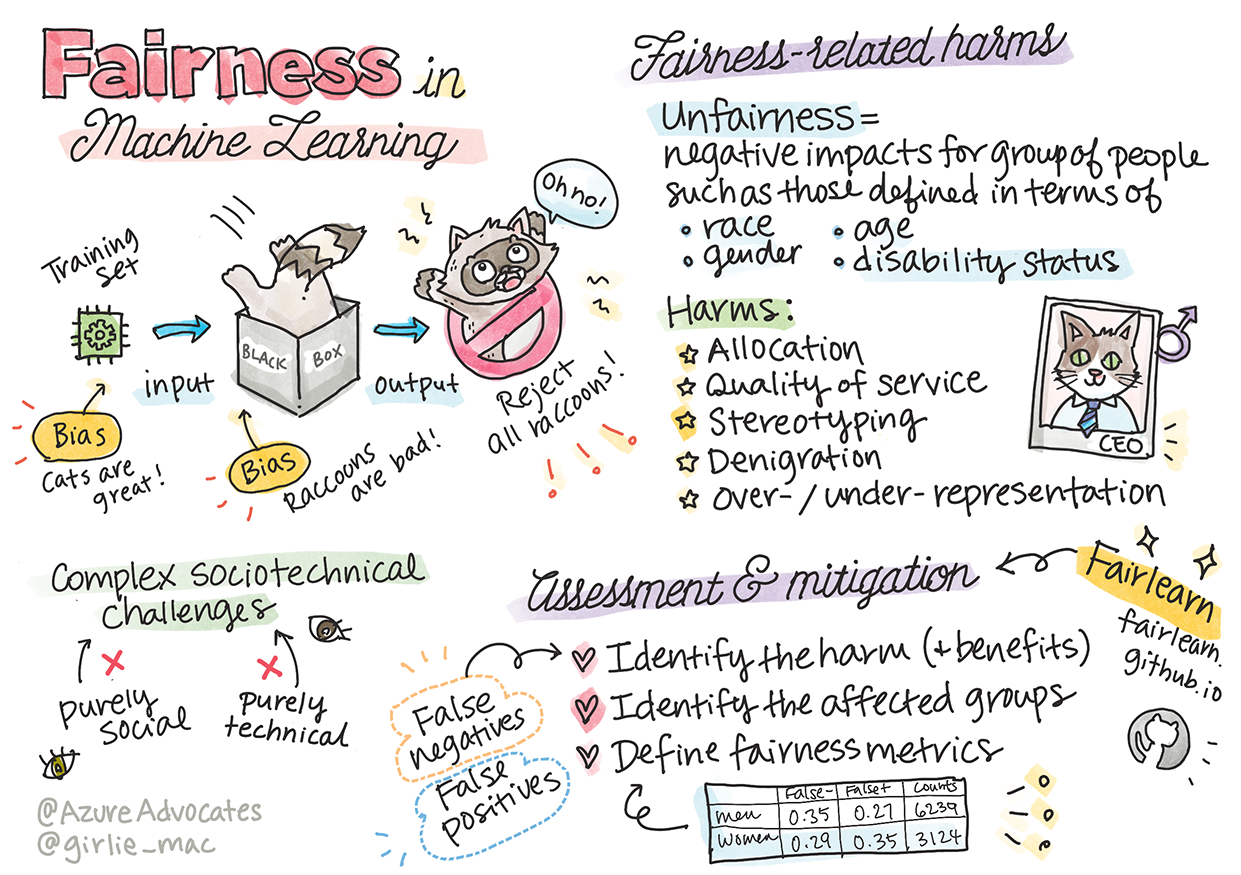

स्केच नोट: Tomomi Imura

पूर्व-व्याख्यान प्रश्नमंजुषा

परिचय

या अभ्यासक्रमात, तुम्ही मशीन लर्निंग कसे आणि कशा प्रकारे आपल्या दैनंदिन जीवनावर परिणाम करत आहे हे शोधायला सुरुवात कराल. सध्या, आरोग्य सेवा निदान, कर्ज मंजुरी किंवा फसवणूक शोधणे यासारख्या दैनंदिन निर्णय घेण्याच्या कामांमध्ये प्रणाली आणि मॉडेल्स सहभागी आहेत. त्यामुळे हे मॉडेल्स विश्वासार्ह परिणाम देण्यासाठी चांगले कार्य करणे महत्त्वाचे आहे. कोणत्याही सॉफ्टवेअर अनुप्रयोगाप्रमाणेच, AI प्रणाली अपेक्षांमध्ये अपयशी ठरू शकतात किंवा अवांछित परिणाम देऊ शकतात. म्हणूनच AI मॉडेलच्या वर्तनाला समजून घेणे आणि स्पष्ट करणे आवश्यक आहे.

कल्पना करा की तुम्ही वापरत असलेल्या डेटामध्ये विशिष्ट लोकसंख्येचा अभाव आहे, जसे की वंश, लिंग, राजकीय दृष्टिकोन, धर्म, किंवा अशा लोकसंख्येचे असमान प्रतिनिधित्व आहे. मॉडेलचा आउटपुट काही लोकसंख्येला प्राधान्य देण्यासाठी व्याख्या केला जातो तेव्हा काय होते? अनुप्रयोगासाठी त्याचा परिणाम काय होतो? याशिवाय, जेव्हा मॉडेलचा प्रतिकूल परिणाम होतो आणि तो लोकांसाठी हानिकारक ठरतो तेव्हा काय होते? AI प्रणालीच्या वर्तनासाठी कोण जबाबदार आहे? हे काही प्रश्न आहेत जे आपण या अभ्यासक्रमात शोधू.

या धड्यात तुम्ही:

- मशीन लर्निंगमधील न्याय्यतेचे महत्त्व आणि न्याय्यतेशी संबंधित हानींबद्दल जागरूकता वाढवाल.

- विश्वासार्हता आणि सुरक्षितता सुनिश्चित करण्यासाठी अपवाद आणि असामान्य परिस्थितींचा अभ्यास करण्याच्या पद्धतीशी परिचित व्हाल.

- सर्वांना सक्षम करण्यासाठी समावेशक प्रणाली डिझाइन करण्याची गरज समजून घ्याल.

- डेटा आणि लोकांच्या गोपनीयतेचे आणि सुरक्षिततेचे संरक्षण करणे किती महत्त्वाचे आहे हे शोधाल.

- AI मॉडेल्सच्या वर्तनाचे स्पष्टीकरण देण्यासाठी पारदर्शक दृष्टिकोनाचे महत्त्व पाहाल.

- AI प्रणालींमध्ये विश्वास निर्माण करण्यासाठी जबाबदारी किती आवश्यक आहे याची जाणीव ठेवाल.

पूर्वतयारी

पूर्वतयारी म्हणून, कृपया "Responsible AI Principles" शिकण्याचा मार्ग घ्या आणि खालील व्हिडिओ पहा:

Responsible AI शिकण्याचा मार्ग

🎥 वरील प्रतिमेवर क्लिक करा: Microsoft चा जबाबदार AI दृष्टिकोन

न्याय्यता

AI प्रणालींनी प्रत्येकाशी न्याय्य वर्तन करावे आणि समान गटांवर वेगळ्या प्रकारे परिणाम होण्याचे टाळावे. उदाहरणार्थ, जेव्हा AI प्रणाली वैद्यकीय उपचार, कर्ज अर्ज किंवा रोजगाराबाबत मार्गदर्शन प्रदान करतात, तेव्हा त्यांना समान लक्षणे, आर्थिक परिस्थिती किंवा व्यावसायिक पात्रता असलेल्या प्रत्येकासाठी समान शिफारसी करणे आवश्यक आहे. आपल्यापैकी प्रत्येकजण मानवी म्हणून वारसा मिळालेल्या पूर्वग्रहांसह जगतो, जे आपल्या निर्णयांवर आणि कृतींवर परिणाम करतात. हे पूर्वग्रह आपण AI प्रणालींना प्रशिक्षण देण्यासाठी वापरत असलेल्या डेटामध्ये दिसून येऊ शकतात. अशा प्रकारचे फेरफार कधीकधी अनवधानाने होऊ शकते. डेटामध्ये पूर्वग्रह कधी सादर केला जातो हे जाणून घेणे अनेकदा कठीण असते.

"अन्याय" म्हणजे लोकांच्या गटासाठी नकारात्मक परिणाम किंवा "हानी", जसे की वंश, लिंग, वय किंवा अपंगत्व स्थितीच्या संदर्भात परिभाषित केलेले. न्याय्यतेशी संबंधित मुख्य हानी वर्गीकृत केल्या जाऊ शकतात:

- वाटप, जसे की एखाद्या लिंगाला किंवा वंशाला दुसऱ्यापेक्षा प्राधान्य दिले जाते.

- सेवेची गुणवत्ता. जर तुम्ही डेटा एका विशिष्ट परिस्थितीसाठी प्रशिक्षण दिला असेल परंतु वास्तव अधिक जटिल असेल, तर ते खराब कार्यक्षमतेच्या सेवेकडे नेते. उदाहरणार्थ, एक हात साबण डिस्पेंसर जो गडद त्वचेच्या लोकांना ओळखू शकत नाही. संदर्भ

- निंदा. एखाद्या गोष्टीची किंवा व्यक्तीची अन्यायकारक टीका करणे आणि लेबल लावणे. उदाहरणार्थ, एक प्रतिमा लेबलिंग तंत्रज्ञानाने गडद त्वचेच्या लोकांच्या प्रतिमांना गोरिला म्हणून चुकीचे लेबल दिले.

- अतिरिक्त किंवा अपुरे प्रतिनिधित्व. एखाद्या विशिष्ट गटाला विशिष्ट व्यवसायात न पाहण्याची कल्पना, आणि कोणतीही सेवा किंवा कार्य जे ते सतत प्रोत्साहित करते ते हानीसाठी योगदान देते.

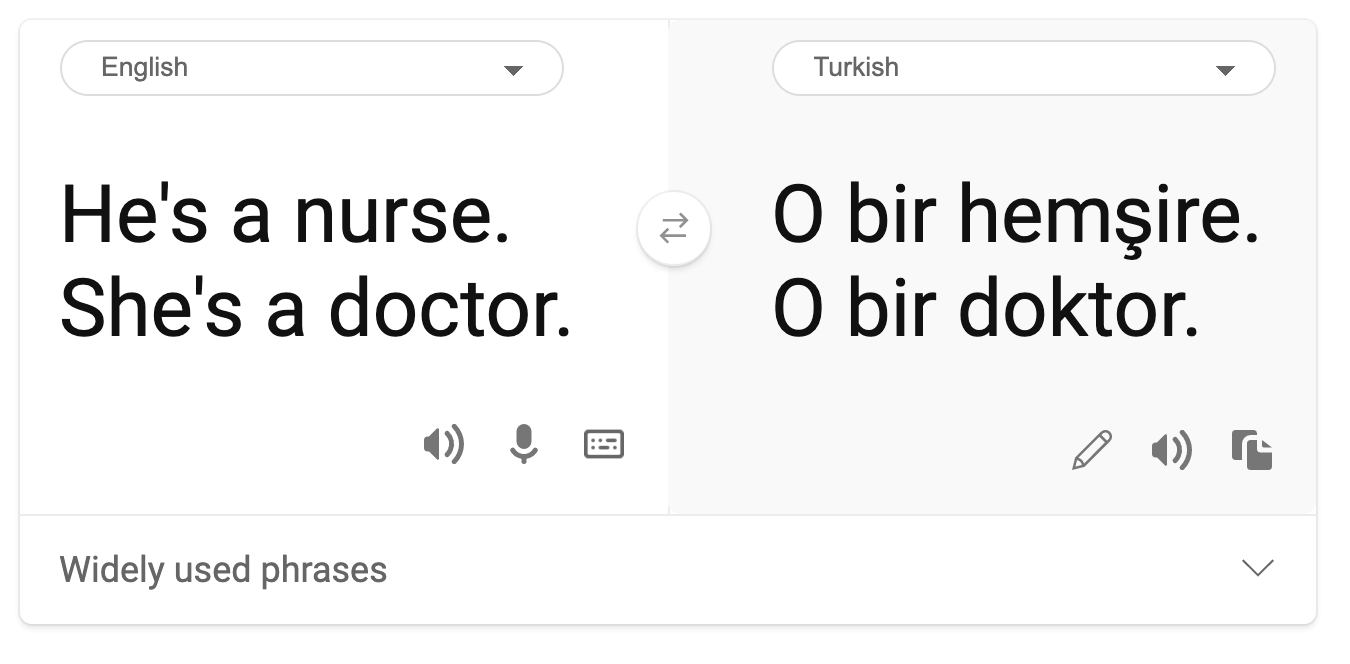

- स्टीरिओटायपिंग. एखाद्या गटाशी पूर्वनिर्धारित गुणधर्म जोडणे. उदाहरणार्थ, इंग्रजी आणि तुर्की भाषांमधील भाषांतर प्रणालीमध्ये लिंगाशी संबंधित स्टीरिओटायपिकल शब्दांमुळे अचूकतेचा अभाव असू शकतो.

तुर्की भाषेत भाषांतर

पुन्हा इंग्रजीत भाषांतर

AI प्रणाली डिझाइन करताना आणि चाचणी करताना, आपल्याला सुनिश्चित करणे आवश्यक आहे की AI न्याय्य आहे आणि पूर्वग्रह किंवा भेदभावपूर्ण निर्णय घेण्यासाठी प्रोग्राम केलेले नाही, जे मानवी देखील घेण्यास मनाई आहे. AI आणि मशीन लर्निंगमध्ये न्याय्यता सुनिश्चित करणे हे एक जटिल सामाजिक-तांत्रिक आव्हान आहे.

विश्वासार्हता आणि सुरक्षितता

विश्वास निर्माण करण्यासाठी, AI प्रणालींना सामान्य आणि अनपेक्षित परिस्थितीत विश्वासार्ह, सुरक्षित आणि सुसंगत असणे आवश्यक आहे. AI प्रणाली विविध परिस्थितीत कसे वागतील हे जाणून घेणे महत्त्वाचे आहे, विशेषतः जेव्हा ते अपवाद असतात. AI उपाय तयार करताना, AI उपायांना सामोरे जावे लागणाऱ्या विविध परिस्थिती हाताळण्यासाठी कसे लक्ष केंद्रित करावे यावर भर देणे आवश्यक आहे. उदाहरणार्थ, एक स्वयंचलित कार लोकांच्या सुरक्षिततेला सर्वोच्च प्राधान्य म्हणून ठेवणे आवश्यक आहे. परिणामी, कारला चालवणाऱ्या AI ने कारला रात्री, वादळ किंवा हिमवृष्टी, रस्त्यावर धावणारी मुले, पाळीव प्राणी, रस्त्याचे बांधकाम इत्यादीसारख्या सर्व संभाव्य परिस्थितींचा विचार करणे आवश्यक आहे. AI प्रणाली विविध परिस्थिती विश्वासार्हपणे आणि सुरक्षितपणे कशी हाताळते हे डेटा वैज्ञानिक किंवा AI विकसकाने प्रणालीच्या डिझाइन किंवा चाचणी दरम्यान विचारात घेतलेल्या अपेक्षेच्या पातळीचे प्रतिबिंब आहे.

समावेशकता

AI प्रणाली सर्वांना गुंतवून ठेवण्यासाठी आणि सक्षम करण्यासाठी डिझाइन केल्या पाहिजेत. AI प्रणाली डिझाइन करताना आणि अंमलात आणताना डेटा वैज्ञानिक आणि AI विकसक प्रणालीतील संभाव्य अडथळे ओळखतात आणि त्यांना दूर करतात जे अनवधानाने लोकांना वगळू शकतात. उदाहरणार्थ, जगभरात 1 अब्ज लोक अपंग आहेत. AI च्या प्रगतीमुळे, ते त्यांच्या दैनंदिन जीवनात अधिक सहजपणे माहिती आणि संधींचा मोठ्या प्रमाणावर प्रवेश करू शकतात. अडथळ्यांना दूर करून, ते सर्वांसाठी चांगल्या अनुभवांसह AI उत्पादने विकसित करण्याच्या संधी निर्माण करते.

सुरक्षा आणि गोपनीयता

AI प्रणाली सुरक्षित असाव्यात आणि लोकांच्या गोपनीयतेचा आदर करावा. जेव्हा प्रणाली गोपनीयता, माहिती किंवा जीवन धोक्यात आणते तेव्हा लोकांना त्या प्रणालींवर कमी विश्वास असतो. मशीन लर्निंग मॉडेल्स प्रशिक्षण देताना, सर्वोत्तम परिणाम मिळवण्यासाठी डेटावर अवलंबून राहतो. असे करताना, डेटाचा उगम आणि अखंडता विचारात घेतली पाहिजे. उदाहरणार्थ, डेटा वापरकर्त्याने सबमिट केला होता का किंवा सार्वजनिकपणे उपलब्ध होता का? पुढे, डेटासह काम करताना, गोपनीय माहितीचे संरक्षण करू शकणाऱ्या आणि हल्ल्यांना प्रतिकार करू शकणाऱ्या AI प्रणाली विकसित करणे आवश्यक आहे. AI अधिक प्रचलित होत असताना, गोपनीयता आणि महत्त्वाची वैयक्तिक आणि व्यावसायिक माहिती सुरक्षित करणे अधिक महत्त्वाचे आणि जटिल होत आहे. AI साठी गोपनीयता आणि डेटा सुरक्षा समस्यांवर विशेष लक्ष देणे आवश्यक आहे कारण डेटाचा प्रवेश AI प्रणालींना लोकांबद्दल अचूक आणि माहितीपूर्ण अंदाज आणि निर्णय घेण्यासाठी आवश्यक आहे.

- उद्योग म्हणून, गोपनीयता आणि सुरक्षिततेमध्ये आम्ही महत्त्वपूर्ण प्रगती केली आहे, जी GDPR (General Data Protection Regulation) सारख्या नियमांमुळे मोठ्या प्रमाणात प्रेरित झाली आहे.

- तरीही AI प्रणालींसह, अधिक वैयक्तिक डेटा आवश्यकतेची तणाव मान्य करणे आवश्यक आहे जे प्रणालींना अधिक वैयक्तिक आणि प्रभावी बनवते – आणि गोपनीयता.

- इंटरनेटसह कनेक्टेड संगणकांच्या जन्माप्रमाणेच, आम्ही AI संबंधित सुरक्षा समस्यांमध्ये मोठी वाढ पाहत आहोत.

- त्याच वेळी, आम्ही सुरक्षा सुधारण्यासाठी AI वापरले जात असल्याचे पाहिले आहे. उदाहरणार्थ, आज बहुतेक आधुनिक अँटी-व्हायरस स्कॅनर AI ह्युरिस्टिक्सद्वारे चालवले जातात.

- आपली डेटा विज्ञान प्रक्रिया नवीनतम गोपनीयता आणि सुरक्षा पद्धतींसह सुसंवादीपणे मिसळली पाहिजे.

पारदर्शकता

AI प्रणाली समजण्यासारख्या असाव्यात. पारदर्शकतेचा एक महत्त्वाचा भाग म्हणजे AI प्रणाली आणि त्यांच्या घटकांच्या वर्तनाचे स्पष्टीकरण देणे. AI प्रणालींचे समज सुधारण्यासाठी भागधारकांना त्यांचे कार्य कसे आणि का कार्य करते हे समजणे आवश्यक आहे जेणेकरून ते संभाव्य कार्यप्रदर्शन समस्या, सुरक्षा आणि गोपनीयता चिंता, पूर्वग्रह, वगळण्याच्या पद्धती किंवा अनपेक्षित परिणाम ओळखू शकतील. आम्हाला असेही वाटते की जे AI प्रणाली वापरतात त्यांनी त्या कधी, का आणि कशा प्रकारे तैनात करायचे ते प्रामाणिक आणि स्पष्ट असावे. तसेच ते वापरत असलेल्या प्रणालींच्या मर्यादा. उदाहरणार्थ, जर एखाद्या बँकेने ग्राहक कर्ज निर्णयांना समर्थन देण्यासाठी AI प्रणालीचा वापर केला असेल, तर परिणाम तपासणे आणि कोणता डेटा प्रणालीच्या शिफारसींवर प्रभाव टाकतो हे समजून घेणे महत्त्वाचे आहे. सरकार विविध उद्योगांमध्ये AI नियमन करण्यास सुरुवात करत आहेत, त्यामुळे डेटा वैज्ञानिक आणि संस्थांनी AI प्रणाली नियामक आवश्यकता पूर्ण करते का हे स्पष्ट करणे आवश्यक आहे, विशेषतः जेव्हा अवांछित परिणाम होतो.

- AI प्रणाली इतक्या जटिल असल्यामुळे, त्यांचे कार्य कसे चालते आणि परिणामांची व्याख्या करणे कठीण आहे.

- या समजण्याचा अभाव प्रणालींचे व्यवस्थापन, ऑपरेशनलायझेशन आणि दस्तऐवजीकरण यावर परिणाम करतो.

- या समजण्याचा अभाव अधिक महत्त्वाचा म्हणजे या प्रणालींनी तयार केलेल्या परिणामांचा वापर करून घेतलेले निर्णय प्रभावित करतो.

जबाबदारी

AI प्रणाली डिझाइन करणारे आणि तैनात करणारे लोक त्यांच्या प्रणाली कशा प्रकारे कार्य करतात यासाठी जबाबदार असले पाहिजेत. चेहरा ओळखण्यासारख्या संवेदनशील तंत्रज्ञानासह जबाबदारीची गरज विशेषतः महत्त्वाची आहे. अलीकडे, चेहरा ओळखण्याच्या तंत्रज्ञानाची मागणी वाढत आहे, विशेषतः कायद्याची अंमलबजावणी करणाऱ्या संस्थांकडून ज्यांना हरवलेल्या मुलांना शोधण्यासारख्या वापरांमध्ये तंत्रज्ञानाची क्षमता दिसते. तथापि, या तंत्रज्ञानाचा वापर सरकारकडून त्यांच्या नागरिकांच्या मूलभूत स्वातंत्र्याला धोका निर्माण करण्यासाठी केला जाऊ शकतो, उदाहरणार्थ, विशिष्ट व्यक्तींच्या सतत देखरेख सक्षम करून. त्यामुळे डेटा वैज्ञानिक आणि संस्थांनी त्यांच्या AI प्रणालीचा व्यक्ती किंवा समाजावर होणाऱ्या परिणामासाठी जबाबदार असणे आवश्यक आहे.

🎥 वरील प्रतिमेवर क्लिक करा: चेहरा ओळखण्याद्वारे मोठ्या प्रमाणावर देखरेखीसाठी इशारा

शेवटी, आमच्या पिढीसाठी सर्वात मोठा प्रश्न, AI समाजात आणणारी पहिली पिढी म्हणून, संगणक लोकांसाठी जबाबदार राहतील याची खात्री कशी करायची आणि संगणक डिझाइन करणारे लोक इतर सर्वांसाठी जबाबदार राहतील याची खात्री कशी करायची हा आहे.

परिणाम मूल्यांकन

मशीन लर्निंग मॉडेल प्रशिक्षण देण्यापूर्वी, AI प्रणालीचा उद्देश समजून घेण्यासाठी परिणाम मूल्यांकन करणे महत्त्वाचे आहे; त्याचा हेतू काय आहे; ते कुठे तैनात केले जाईल; आणि कोण प्रणालीशी संवाद साधत आहे. हे पुनरावलोकन करणाऱ्यांसाठी किंवा प्रणालीचे परीक्षण करणाऱ्यांसाठी संभाव्य जोखीम आणि अपेक्षित परिणाम ओळखताना विचारात घेण्यासारख्या घटकांना जाणून घेण्यासाठी उपयुक्त आहेत.

परिणाम मूल्यांकन करताना लक्ष केंद्रित करण्याचे क्षेत्र खालीलप्रमाणे आहेत:

- व्यक्तींवर प्रतिकूल परिणाम. कोणत्याही निर्बंध किंवा आवश्यकता, असमर्थित वापर किंवा प्रणालीच्या कार्यक्षमतेस अडथळा आणणाऱ्या कोणत्याही ज्ञात मर्यादा याची जाणीव असणे महत्त्वाचे आहे जेणेकरून प्रणालीचा वापर व्यक्तींना हानी पोहोचविण्याच्या पद्धतीने होऊ नये.

- डेटा आवश्यकता. प्रणाली डेटा कसा आणि कुठे वापरेल याची समज मिळवणे पुनरावलोकन करणाऱ्यांना कोणत्याही डेटा आवश्यकता (उदा., GDPR किंवा HIPPA डेटा नियम) विचारात घेणे आवश्यक आहे. याशिवाय, प्रशिक्षणासाठी स्रोत किंवा डेटाचे प्रमाण पुरेसे आहे का हे तपासा.

- परिणामाचा सारांश. प्रणाली वापरण्यामुळे उद्भवू शकणाऱ्या संभाव्य हानींची यादी तयार करा. ML जीवनचक्रादरम्यान, ओळखलेल्या समस्यांचे निराकरण किंवा निराकरण केले आहे का ते पुनरावलोकन करा.

- सहा मुख्य तत्त्वांसाठी लागू उद्दिष्टे. प्रत्येक तत्त्वांमधील उद्दिष्टे पूर्ण झाली आहेत का आणि काही अंतर आहेत का याचे मूल्यांकन करा.

जबाबदार AI सह डीबगिंग

सॉफ्टवेअर अनुप्रयोग डीबग करण्यासारखेच, AI प्रणाली डीबग करणे ही प्रणालीतील समस्या ओळखण्याची आणि सोडवण्याची आवश्यक प्रक्रिया आहे. मॉडेल अपेक्षेप्रमाणे किंवा जबाबदारीने कार्य करत नाही यावर परिणाम करणारे अनेक घटक आहेत. बहुतेक पारंपरिक मॉडेल कार्यप्रदर्शन मेट्रिक्स मॉडेलच्या कार्यप्रदर्शनाचे प्रमाणात्मक एकत्रीकरण आहेत, जे मॉडेल जबाबदार AI तत्त्वांचे उल्लंघन कसे करते हे विश्लेषण करण्यासाठी पुरेसे नाहीत. याव्यतिरिक्त, मशीन लर्निंग मॉडेल एक ब्लॅक बॉक्स आहे ज्यामुळे त्याच्या परिणामाचा काय परिणाम होतो हे समजणे कठीण होते किंवा जेव्हा ते चूक करते तेव्हा स्पष्टीकरण प्रदान करणे कठीण होते. या अभ्यासक्रमात नंतर, आम्ही जबाबदार AI डॅशबोर्ड वापरून AI प्रणाली डीबग कशी करावी हे शिकू. डॅशबोर्ड डेटा वैज्ञानिक आणि AI विकसकांना खालील कार्ये करण्यासाठी एक व्यापक साधन प्रदान करतो:

- त्रुटी विश्लेषण. मॉडेलच्या त्रुटी वितरणाची ओळख करण्यासाठी जे प्रणालीच्या न्याय्यतेवर किंवा विश्वासार्हतेवर परिणाम करू शकते.

- **मॉड या कार्यशाळेचा अभ्यास करून विषय अधिक सखोल समजून घ्या:

- जबाबदार AI च्या शोधात: तत्त्वांपासून प्रत्यक्षात आणण्यापर्यंत, Besmira Nushi, Mehrnoosh Sameki आणि Amit Sharma यांच्याकडून

🎥 वरील प्रतिमेवर क्लिक करा व्हिडिओसाठी: RAI Toolbox: जबाबदार AI तयार करण्यासाठी एक ओपन-सोर्स फ्रेमवर्क, Besmira Nushi, Mehrnoosh Sameki आणि Amit Sharma यांच्याकडून

तसेच वाचा:

-

Microsoft चा RAI संसाधन केंद्र: Responsible AI Resources – Microsoft AI

-

Microsoft चा FATE संशोधन गट: FATE: Fairness, Accountability, Transparency, and Ethics in AI - Microsoft Research

RAI Toolbox:

Azure Machine Learning च्या साधनांबद्दल वाचा जे न्याय सुनिश्चित करतात:

असाइनमेंट

अस्वीकरण:

हा दस्तऐवज AI भाषांतर सेवा Co-op Translator चा वापर करून भाषांतरित करण्यात आला आहे. आम्ही अचूकतेसाठी प्रयत्नशील असलो तरी, कृपया लक्षात घ्या की स्वयंचलित भाषांतरांमध्ये त्रुटी किंवा अचूकतेचा अभाव असू शकतो. मूळ भाषेतील मूळ दस्तऐवज हा अधिकृत स्रोत मानला जावा. महत्त्वाच्या माहितीसाठी व्यावसायिक मानवी भाषांतराची शिफारस केली जाते. या भाषांतराचा वापर केल्यामुळे उद्भवणाऱ्या कोणत्याही गैरसमजांकरिता किंवा चुकीच्या अर्थ लावण्याकरिता आम्ही जबाबदार राहणार नाही.