Italian translation - Chapter 9 completed. Quiz app: added italian version and updated index.js accordingly. Query string for iinks for pre/post lecture quizzes updated. Translated main README.md file

parent

591a25f436

commit

c0c469d436

@ -1,118 +1,118 @@

|

||||

# Storia di machine learning

|

||||

|

||||

|

||||

> Sketchnote di [Tomomi Imura](https://www.twitter.com/girlie_mac)

|

||||

|

||||

## [Quiz Pre-Lezione](https://white-water-09ec41f0f.azurestaticapps.net/quiz/3/)

|

||||

|

||||

In questa lezione, si camminerà attraverso le principali pietre miliari nella storia di machine learning e dell'intelligenza artificiale.

|

||||

|

||||

La storia dell'intelligenza artificiale, AI, come campo è intrecciata con la storia di machine learning, poiché gli algoritmi e i progressi computazionali alla base di machine learning hanno contribuito allo sviluppo dell'intelligenza artificiale. È utile ricordare che, mentre questi campi come distinte aree di indagine hanno cominciato a cristallizzarsi negli anni '50, importanti [scoperte algoritmiche, statistiche, matematiche, computazionali e tecniche](https://wikipedia.org/wiki/Timeline_of_machine_learning) hanno preceduto e si sono sovrapposte a questa era. In effetti, le persone hanno riflettuto su queste domande per [centinaia di anni](https://wikipedia.org/wiki/History_of_artificial_intelligence); questo articolo discute le basi intellettuali storiche dell'idea di una "macchina pensante".

|

||||

|

||||

## Scoperte rilevanti

|

||||

|

||||

- 1763, 1812 [Teorema di Bayes](https://it.wikipedia.org/wiki/Teorema_di_Bayes) e suoi predecessori. Questo teorema e le sue applicazioni sono alla base dell'inferenza, descrivendo la probabilità che un evento si verifichi in base alla conoscenza precedente.

|

||||

- 1805 [Metodo dei Minimi Quadrati](https://it.wikipedia.org/wiki/Metodo_dei_minimi_quadrati) del matematico francese Adrien-Marie Legendre. Questa teoria, che verrà trattata nell'unità Regressione, aiuta nell'adattamento dei dati.

|

||||

- 1913 [Processo Markoviano](https://it.wikipedia.org/wiki/Processo_markoviano) dal nome del matematico russo Andrey Markov è usato per descrivere una sequenza di possibili eventi basati su uno stato precedente.

|

||||

- 1957 [Percettrone](https://it.wikipedia.org/wiki/Percettrone) è un tipo di classificatore lineare inventato dallo psicologo americano Frank Rosenblatt che sta alla base dei progressi nel deep learning.

|

||||

- 1967 [Nearest Neighbor](https://wikipedia.org/wiki/Nearest_neighbor) è un algoritmo originariamente progettato per mappare i percorsi. In un contesto ML viene utilizzato per rilevare i modelli.

|

||||

- 1970 [La Retropropagazione dell'Errore](https://it.wikipedia.org/wiki/Retropropagazione_dell'errore) viene utilizzata per addestrare [le reti neurali feed-forward](https://it.wikipedia.org/wiki/Rete_neurale_feed-forward).

|

||||

- Le [Reti Neurali Ricorrenti](https://it.wikipedia.org/wiki/Rete_neurale_ricorrente) del 1982 sono reti neurali artificiali derivate da reti neurali feedforward che creano grafici temporali.

|

||||

|

||||

✅ Fare una piccola ricerca. Quali altre date si distinguono come fondamentali nella storia del machine learning e dell'intelligenza artificiale?

|

||||

## 1950: Macchine che pensano

|

||||

|

||||

Alan Turing, una persona davvero notevole che è stata votata [dal pubblico nel 2019](https://wikipedia.org/wiki/Icons:_The_Greatest_Person_of_the_20th_Century) come il più grande scienziato del XX secolo, è accreditato per aver contribuito a gettare le basi per il concetto di "macchina in grado di pensare". Ha affrontato gli oppositori e il suo stesso bisogno di prove empiriche di questo concetto in parte creando il [Test di Turing](https://www.bbc.com/news/technology-18475646), che verrà esplorato nelle lezioni di NLP (elaborazione del linguaggio naturale).

|

||||

|

||||

## 1956: Progetto di Ricerca Estivo Dartmouth

|

||||

|

||||

"Il Dartmouth Summer Research Project sull'intelligenza artificiale è stato un evento seminale per l'intelligenza artificiale come campo", qui è stato coniato il termine "intelligenza artificiale" ([fonte](https://250.dartmouth.edu/highlights/artificial-intelligence-ai-coined-dartmouth)).

|

||||

|

||||

> In linea di principio, ogni aspetto dell'apprendimento o qualsiasi altra caratteristica dell'intelligenza può essere descritto in modo così preciso che si può costruire una macchina per simularlo.

|

||||

|

||||

Il ricercatore capo, il professore di matematica John McCarthy, sperava "di procedere sulla base della congettura che ogni aspetto dell'apprendimento o qualsiasi altra caratteristica dell'intelligenza possa in linea di principio essere descritta in modo così preciso che si possa costruire una macchina per simularlo". I partecipanti includevano un altro luminare nel campo, Marvin Minsky.

|

||||

|

||||

Il workshop è accreditato di aver avviato e incoraggiato diverse discussioni tra cui "l'ascesa di metodi simbolici, sistemi focalizzati su domini limitati (primi sistemi esperti) e sistemi deduttivi contro sistemi induttivi". ([fonte](https://wikipedia.org/wiki/Dartmouth_workshop)).

|

||||

|

||||

## 1956 - 1974: "Gli anni d'oro"

|

||||

|

||||

Dagli anni '50 fino alla metà degli anni '70, l'ottimismo era alto nella speranza che l'AI potesse risolvere molti problemi. Nel 1967, Marvin Minsky dichiarò con sicurezza che "Entro una generazione... il problema della creazione di 'intelligenza artificiale' sarà sostanzialmente risolto". (Minsky, Marvin (1967), Computation: Finite and Infinite Machines, Englewood Cliffs, N.J.: Prentice-Hall)

|

||||

|

||||

La ricerca sull'elaborazione del linguaggio naturale è fiorita, la ricerca è stata perfezionata e resa più potente ed è stato creato il concetto di "micro-mondi", in cui compiti semplici sono stati completati utilizzando istruzioni in linguaggio semplice.

|

||||

|

||||

La ricerca è stata ben finanziata dalle agenzie governative, sono stati fatti progressi nel calcolo e negli algoritmi e sono stati costruiti prototipi di macchine intelligenti. Alcune di queste macchine includono:

|

||||

|

||||

* [Shakey il robot](https://wikipedia.org/wiki/Shakey_the_robot), che poteva manovrare e decidere come eseguire i compiti "intelligentemente".

|

||||

|

||||

|

||||

> Shakey nel 1972

|

||||

|

||||

* Eliza, una delle prime "chatterbot", poteva conversare con le persone e agire come una "terapeuta" primitiva. Si Imparerà di più su Eliza nelle lezioni di NLP.

|

||||

|

||||

|

||||

> Una versione di Eliza, un chatbot

|

||||

|

||||

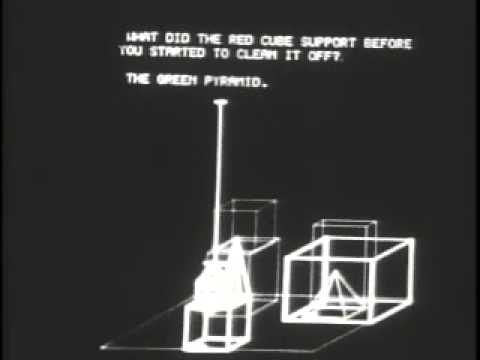

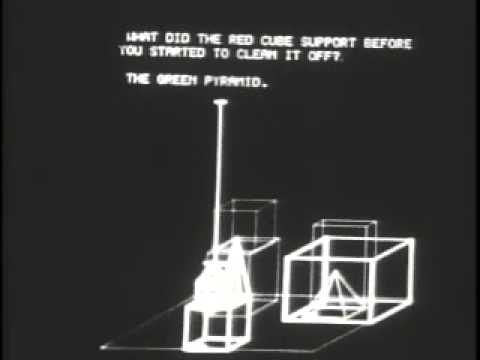

* Il "mondo dei blocchi" era un esempio di un micromondo in cui i blocchi potevano essere impilati e ordinati e si potevano testare esperimenti su macchine per insegnare a prendere decisioni. I progressi realizzati con librerie come [SHRDLU](https://it.wikipedia.org/wiki/SHRDLU) hanno contribuito a far progredire l'elaborazione del linguaggio.

|

||||

|

||||

[](https://www.youtube.com/watch?v=QAJz4YKUwqw "Il mondo dei blocchi con SHRDLU")

|

||||

|

||||

> 🎥 Fare clic sull'immagine sopra per un video: Blocks world con SHRDLU

|

||||

|

||||

## 1974 - 1980: "L'inverno dell'AI"

|

||||

|

||||

Verso la metà degli anni '70, era diventato evidente che la complessità della creazione di "macchine intelligenti" era stata sottovalutata e che la sua promessa, data la potenza di calcolo disponibile, era stata esagerata. I finanziamenti si sono prosciugati e la fiducia nel settore è rallentata. Alcuni problemi che hanno influito sulla fiducia includono:

|

||||

|

||||

- **Limitazioni**. La potenza di calcolo era troppo limitata.

|

||||

- **Esplosione combinatoria**. La quantità di parametri necessari per essere addestrati è cresciuta in modo esponenziale man mano che veniva chiesto di più ai computer, senza un'evoluzione parallela della potenza e delle capacità di calcolo.

|

||||

- **Scarsità di dati**. C'era una scarsità di dati che ostacolava il processo di test, sviluppo e perfezionamento degli algoritmi.

|

||||

- **Stiamo facendo le domande giuste?**. Le stesse domande che venivano poste cominciarono ad essere messe in discussione. I ricercatori hanno iniziato a criticare i loro approcci:

|

||||

- I test di Turing furono messi in discussione attraverso, tra le altre idee, la "teoria della stanza cinese" che postulava che "la programmazione di un computer digitale può far sembrare che capisca il linguaggio ma non potrebbe produrre una vera comprensione". ([fonte](https://plato.stanford.edu/entries/chinese-room/))

|

||||

- L'etica dell'introduzione di intelligenze artificiali come la "terapeuta" ELIZA nella società è stata messa in discussione.

|

||||

|

||||

Allo stesso tempo, iniziarono a formarsi varie scuole di pensiero sull'AI. È stata stabilita una dicotomia tra pratiche ["scruffy" contro "neat AI"](https://wikipedia.org/wiki/Neats_and_scruffies). I laboratori _scruffy_ ottimizzavano i programmi per ore fino a quando non ottenevano i risultati desiderati. I laboratori _Neat_ "si focalizzavano sulla logica e sulla risoluzione formale dei problemi". ELIZA e SHRDLU erano ben noti _sistemi scruffy_. Negli anni '80, quando è emersa la richiesta di rendere riproducibili i sistemi ML, l'_approccio neat_ ha gradualmente preso il sopravvento in quanto i suoi risultati sono più spiegabili.

|

||||

|

||||

## Sistemi esperti degli anni '80

|

||||

|

||||

Man mano che il settore cresceva, i suoi vantaggi per le imprese diventavano più chiari e negli anni '80 lo stesso accadeva con la proliferazione di "sistemi esperti". "I sistemi esperti sono stati tra le prime forme di software di intelligenza artificiale (AI) di vero successo". ([fonte](https://wikipedia.org/wiki/Expert_system)).

|

||||

|

||||

Questo tipo di sistema è in realtà _ibrido_, costituito in parte da un motore di regole che definisce i requisiti aziendali e un motore di inferenza che sfrutta il sistema di regole per dedurre nuovi fatti.

|

||||

|

||||

Questa era ha visto anche una crescente attenzione rivolta alle reti neurali.

|

||||

|

||||

## 1987 - 1993: AI 'Chill'

|

||||

|

||||

La proliferazione di hardware specializzato per sistemi esperti ha avuto lo sfortunato effetto di diventare troppo specializzato. L'ascesa dei personal computer ha anche gareggiato con questi grandi sistemi centralizzati specializzati. La democratizzazione dell'informatica era iniziata e alla fine ha spianato la strada alla moderna esplosione dei big data.

|

||||

|

||||

## 1993 - 2011

|

||||

|

||||

Questa epoca ha visto una nuova era per ML e AI per essere in grado di risolvere alcuni dei problemi che erano stati causati in precedenza dalla mancanza di dati e potenza di calcolo. La quantità di dati ha iniziato ad aumentare rapidamente e a diventare più ampiamente disponibile, nel bene e nel male, soprattutto con l'avvento degli smartphone intorno al 2007. La potenza di calcolo si è ampliata in modo esponenziale e gli algoritmi si sono evoluti di pari passo. Il campo ha iniziato a maturare quando i giorni a ruota libera del passato hanno iniziato a cristallizzarsi in una vera disciplina.

|

||||

|

||||

## Adesso

|

||||

|

||||

Oggi, machine learning e intelligenza artificiale toccano quasi ogni parte della nostra vita. Questa era richiede un'attenta comprensione dei rischi e dei potenziali effetti di questi algoritmi sulle vite umane. Come ha affermato Brad Smith di Microsoft, "La tecnologia dell'informazione solleva questioni che vanno al cuore delle protezioni fondamentali dei diritti umani come la privacy e la libertà di espressione. Questi problemi aumentano la responsabilità delle aziende tecnologiche che creano questi prodotti. A nostro avviso, richiedono anche un'attenta regolamentazione del governo e lo sviluppo di norme sugli usi accettabili" ([fonte](https://www.technologyreview.com/2019/12/18/102365/the-future-of-ais-impact-on-society/)).

|

||||

|

||||

Resta da vedere cosa riserva il futuro, ma è importante capire questi sistemi informatici e il software e gli algoritmi che eseguono. Ci si augura che questo programma di studi aiuti ad acquisire una migliore comprensione in modo che si possa decidere in autonomia.

|

||||

|

||||

[](https://www.youtube.com/watch?v=mTtDfKgLm54 " storia del deep learning")

|

||||

> 🎥 Fare clic sull'immagine sopra per un video: Yann LeCun discute la storia del deep learning in questa lezione

|

||||

|

||||

---

|

||||

|

||||

## 🚀 Sfida

|

||||

|

||||

Approfondire uno di questi momenti storici e scoprire

|

||||

di più sulle persone che stanno dietro ad essi. Ci sono personaggi affascinanti e nessuna scoperta scientifica è mai stata creata in un vuoto culturale. Cosa si è scoperto?

|

||||

|

||||

## [Quiz post-lezione](https://white-water-09ec41f0f.azurestaticapps.net/quiz/4/)

|

||||

|

||||

## Revisione e Auto Apprendimento

|

||||

|

||||

Ecco gli elementi da guardare e ascoltare:

|

||||

|

||||

[Questo podcast in cui Amy Boyd discute l'evoluzione dell'AI](http://runasradio.com/Shows/Show/739)

|

||||

|

||||

[](https://www.youtube.com/watch?v=EJt3_bFYKss "La storia dell'AI di Amy Boyd")

|

||||

|

||||

## Compito

|

||||

|

||||

[Creare una sequenza temporale](assignment.it.md)

|

||||

# Storia di machine learning

|

||||

|

||||

|

||||

> Sketchnote di [Tomomi Imura](https://www.twitter.com/girlie_mac)

|

||||

|

||||

## [Quiz pre-lezione](https://white-water-09ec41f0f.azurestaticapps.net/quiz/3/?loc=it)

|

||||

|

||||

In questa lezione, si camminerà attraverso le principali pietre miliari nella storia di machine learning e dell'intelligenza artificiale.

|

||||

|

||||

La storia dell'intelligenza artificiale, AI, come campo è intrecciata con la storia di machine learning, poiché gli algoritmi e i progressi computazionali alla base di machine learning hanno contribuito allo sviluppo dell'intelligenza artificiale. È utile ricordare che, mentre questi campi come distinte aree di indagine hanno cominciato a cristallizzarsi negli anni '50, importanti [scoperte algoritmiche, statistiche, matematiche, computazionali e tecniche](https://wikipedia.org/wiki/Timeline_of_machine_learning) hanno preceduto e si sono sovrapposte a questa era. In effetti, le persone hanno riflettuto su queste domande per [centinaia di anni](https://wikipedia.org/wiki/History_of_artificial_intelligence); questo articolo discute le basi intellettuali storiche dell'idea di una "macchina pensante".

|

||||

|

||||

## Scoperte rilevanti

|

||||

|

||||

- 1763, 1812 [Teorema di Bayes](https://it.wikipedia.org/wiki/Teorema_di_Bayes) e suoi predecessori. Questo teorema e le sue applicazioni sono alla base dell'inferenza, descrivendo la probabilità che un evento si verifichi in base alla conoscenza precedente.

|

||||

- 1805 [Metodo dei Minimi Quadrati](https://it.wikipedia.org/wiki/Metodo_dei_minimi_quadrati) del matematico francese Adrien-Marie Legendre. Questa teoria, che verrà trattata nell'unità Regressione, aiuta nell'adattamento dei dati.

|

||||

- 1913 [Processo Markoviano](https://it.wikipedia.org/wiki/Processo_markoviano) dal nome del matematico russo Andrey Markov è usato per descrivere una sequenza di possibili eventi basati su uno stato precedente.

|

||||

- 1957 [Percettrone](https://it.wikipedia.org/wiki/Percettrone) è un tipo di classificatore lineare inventato dallo psicologo americano Frank Rosenblatt che sta alla base dei progressi nel deep learning.

|

||||

- 1967 [Nearest Neighbor](https://wikipedia.org/wiki/Nearest_neighbor) è un algoritmo originariamente progettato per mappare i percorsi. In un contesto ML viene utilizzato per rilevare i modelli.

|

||||

- 1970 [La Retropropagazione dell'Errore](https://it.wikipedia.org/wiki/Retropropagazione_dell'errore) viene utilizzata per addestrare [le reti neurali feed-forward](https://it.wikipedia.org/wiki/Rete_neurale_feed-forward).

|

||||

- Le [Reti Neurali Ricorrenti](https://it.wikipedia.org/wiki/Rete_neurale_ricorrente) del 1982 sono reti neurali artificiali derivate da reti neurali feedforward che creano grafici temporali.

|

||||

|

||||

✅ Fare una piccola ricerca. Quali altre date si distinguono come fondamentali nella storia del machine learning e dell'intelligenza artificiale?

|

||||

## 1950: Macchine che pensano

|

||||

|

||||

Alan Turing, una persona davvero notevole che è stata votata [dal pubblico nel 2019](https://wikipedia.org/wiki/Icons:_The_Greatest_Person_of_the_20th_Century) come il più grande scienziato del XX secolo, è accreditato per aver contribuito a gettare le basi per il concetto di "macchina in grado di pensare". Ha affrontato gli oppositori e il suo stesso bisogno di prove empiriche di questo concetto in parte creando il [Test di Turing](https://www.bbc.com/news/technology-18475646), che verrà esplorato nelle lezioni di NLP (elaborazione del linguaggio naturale).

|

||||

|

||||

## 1956: Progetto di Ricerca Estivo Dartmouth

|

||||

|

||||

"Il Dartmouth Summer Research Project sull'intelligenza artificiale è stato un evento seminale per l'intelligenza artificiale come campo", qui è stato coniato il termine "intelligenza artificiale" ([fonte](https://250.dartmouth.edu/highlights/artificial-intelligence-ai-coined-dartmouth)).

|

||||

|

||||

> In linea di principio, ogni aspetto dell'apprendimento o qualsiasi altra caratteristica dell'intelligenza può essere descritto in modo così preciso che si può costruire una macchina per simularlo.

|

||||

|

||||

Il ricercatore capo, il professore di matematica John McCarthy, sperava "di procedere sulla base della congettura che ogni aspetto dell'apprendimento o qualsiasi altra caratteristica dell'intelligenza possa in linea di principio essere descritta in modo così preciso che si possa costruire una macchina per simularlo". I partecipanti includevano un altro luminare nel campo, Marvin Minsky.

|

||||

|

||||

Il workshop è accreditato di aver avviato e incoraggiato diverse discussioni tra cui "l'ascesa di metodi simbolici, sistemi focalizzati su domini limitati (primi sistemi esperti) e sistemi deduttivi contro sistemi induttivi". ([fonte](https://wikipedia.org/wiki/Dartmouth_workshop)).

|

||||

|

||||

## 1956 - 1974: "Gli anni d'oro"

|

||||

|

||||

Dagli anni '50 fino alla metà degli anni '70, l'ottimismo era alto nella speranza che l'AI potesse risolvere molti problemi. Nel 1967, Marvin Minsky dichiarò con sicurezza che "Entro una generazione... il problema della creazione di 'intelligenza artificiale' sarà sostanzialmente risolto". (Minsky, Marvin (1967), Computation: Finite and Infinite Machines, Englewood Cliffs, N.J.: Prentice-Hall)

|

||||

|

||||

La ricerca sull'elaborazione del linguaggio naturale è fiorita, la ricerca è stata perfezionata e resa più potente ed è stato creato il concetto di "micro-mondi", in cui compiti semplici sono stati completati utilizzando istruzioni in linguaggio semplice.

|

||||

|

||||

La ricerca è stata ben finanziata dalle agenzie governative, sono stati fatti progressi nel calcolo e negli algoritmi e sono stati costruiti prototipi di macchine intelligenti. Alcune di queste macchine includono:

|

||||

|

||||

* [Shakey il robot](https://wikipedia.org/wiki/Shakey_the_robot), che poteva manovrare e decidere come eseguire i compiti "intelligentemente".

|

||||

|

||||

|

||||

> Shakey nel 1972

|

||||

|

||||

* Eliza, una delle prime "chatterbot", poteva conversare con le persone e agire come una "terapeuta" primitiva. Si Imparerà di più su Eliza nelle lezioni di NLP.

|

||||

|

||||

|

||||

> Una versione di Eliza, un chatbot

|

||||

|

||||

* Il "mondo dei blocchi" era un esempio di un micromondo in cui i blocchi potevano essere impilati e ordinati e si potevano testare esperimenti su macchine per insegnare a prendere decisioni. I progressi realizzati con librerie come [SHRDLU](https://it.wikipedia.org/wiki/SHRDLU) hanno contribuito a far progredire l'elaborazione del linguaggio.

|

||||

|

||||

[](https://www.youtube.com/watch?v=QAJz4YKUwqw "Il mondo dei blocchi con SHRDLU")

|

||||

|

||||

> 🎥 Fare clic sull'immagine sopra per un video: Blocks world con SHRDLU

|

||||

|

||||

## 1974 - 1980: "L'inverno dell'AI"

|

||||

|

||||

Verso la metà degli anni '70, era diventato evidente che la complessità della creazione di "macchine intelligenti" era stata sottovalutata e che la sua promessa, data la potenza di calcolo disponibile, era stata esagerata. I finanziamenti si sono prosciugati e la fiducia nel settore è rallentata. Alcuni problemi che hanno influito sulla fiducia includono:

|

||||

|

||||

- **Limitazioni**. La potenza di calcolo era troppo limitata.

|

||||

- **Esplosione combinatoria**. La quantità di parametri necessari per essere addestrati è cresciuta in modo esponenziale man mano che veniva chiesto di più ai computer, senza un'evoluzione parallela della potenza e delle capacità di calcolo.

|

||||

- **Scarsità di dati**. C'era una scarsità di dati che ostacolava il processo di test, sviluppo e perfezionamento degli algoritmi.

|

||||

- **Stiamo facendo le domande giuste?**. Le stesse domande che venivano poste cominciarono ad essere messe in discussione. I ricercatori hanno iniziato a criticare i loro approcci:

|

||||

- I test di Turing furono messi in discussione attraverso, tra le altre idee, la "teoria della stanza cinese" che postulava che "la programmazione di un computer digitale può far sembrare che capisca il linguaggio ma non potrebbe produrre una vera comprensione". ([fonte](https://plato.stanford.edu/entries/chinese-room/))

|

||||

- L'etica dell'introduzione di intelligenze artificiali come la "terapeuta" ELIZA nella società è stata messa in discussione.

|

||||

|

||||

Allo stesso tempo, iniziarono a formarsi varie scuole di pensiero sull'AI. È stata stabilita una dicotomia tra pratiche ["scruffy" contro "neat AI"](https://wikipedia.org/wiki/Neats_and_scruffies). I laboratori _scruffy_ ottimizzavano i programmi per ore fino a quando non ottenevano i risultati desiderati. I laboratori _Neat_ "si focalizzavano sulla logica e sulla risoluzione formale dei problemi". ELIZA e SHRDLU erano ben noti _sistemi scruffy_. Negli anni '80, quando è emersa la richiesta di rendere riproducibili i sistemi ML, l'_approccio neat_ ha gradualmente preso il sopravvento in quanto i suoi risultati sono più spiegabili.

|

||||

|

||||

## Sistemi esperti degli anni '80

|

||||

|

||||

Man mano che il settore cresceva, i suoi vantaggi per le imprese diventavano più chiari e negli anni '80 lo stesso accadeva con la proliferazione di "sistemi esperti". "I sistemi esperti sono stati tra le prime forme di software di intelligenza artificiale (AI) di vero successo". ([fonte](https://wikipedia.org/wiki/Expert_system)).

|

||||

|

||||

Questo tipo di sistema è in realtà _ibrido_, costituito in parte da un motore di regole che definisce i requisiti aziendali e un motore di inferenza che sfrutta il sistema di regole per dedurre nuovi fatti.

|

||||

|

||||

Questa era ha visto anche una crescente attenzione rivolta alle reti neurali.

|

||||

|

||||

## 1987 - 1993: AI 'Chill'

|

||||

|

||||

La proliferazione di hardware specializzato per sistemi esperti ha avuto lo sfortunato effetto di diventare troppo specializzato. L'ascesa dei personal computer ha anche gareggiato con questi grandi sistemi centralizzati specializzati. La democratizzazione dell'informatica era iniziata e alla fine ha spianato la strada alla moderna esplosione dei big data.

|

||||

|

||||

## 1993 - 2011

|

||||

|

||||

Questa epoca ha visto una nuova era per ML e AI per essere in grado di risolvere alcuni dei problemi che erano stati causati in precedenza dalla mancanza di dati e potenza di calcolo. La quantità di dati ha iniziato ad aumentare rapidamente e a diventare più ampiamente disponibile, nel bene e nel male, soprattutto con l'avvento degli smartphone intorno al 2007. La potenza di calcolo si è ampliata in modo esponenziale e gli algoritmi si sono evoluti di pari passo. Il campo ha iniziato a maturare quando i giorni a ruota libera del passato hanno iniziato a cristallizzarsi in una vera disciplina.

|

||||

|

||||

## Adesso

|

||||

|

||||

Oggi, machine learning e intelligenza artificiale toccano quasi ogni parte della nostra vita. Questa era richiede un'attenta comprensione dei rischi e dei potenziali effetti di questi algoritmi sulle vite umane. Come ha affermato Brad Smith di Microsoft, "La tecnologia dell'informazione solleva questioni che vanno al cuore delle protezioni fondamentali dei diritti umani come la privacy e la libertà di espressione. Questi problemi aumentano la responsabilità delle aziende tecnologiche che creano questi prodotti. A nostro avviso, richiedono anche un'attenta regolamentazione del governo e lo sviluppo di norme sugli usi accettabili" ([fonte](https://www.technologyreview.com/2019/12/18/102365/the-future-of-ais-impact-on-society/)).

|

||||

|

||||

Resta da vedere cosa riserva il futuro, ma è importante capire questi sistemi informatici e il software e gli algoritmi che eseguono. Ci si augura che questo programma di studi aiuti ad acquisire una migliore comprensione in modo che si possa decidere in autonomia.

|

||||

|

||||

[](https://www.youtube.com/watch?v=mTtDfKgLm54 " storia del deep learning")

|

||||

> 🎥 Fare clic sull'immagine sopra per un video: Yann LeCun discute la storia del deep learning in questa lezione

|

||||

|

||||

---

|

||||

|

||||

## 🚀 Sfida

|

||||

|

||||

Approfondire uno di questi momenti storici e scoprire

|

||||

di più sulle persone che stanno dietro ad essi. Ci sono personaggi affascinanti e nessuna scoperta scientifica è mai stata creata in un vuoto culturale. Cosa si è scoperto?

|

||||

|

||||

## [Quiz post-lezione](https://white-water-09ec41f0f.azurestaticapps.net/quiz/4/?loc=it)

|

||||

|

||||

## Revisione e Auto Apprendimento

|

||||

|

||||

Ecco gli elementi da guardare e ascoltare:

|

||||

|

||||

[Questo podcast in cui Amy Boyd discute l'evoluzione dell'AI](http://runasradio.com/Shows/Show/739)

|

||||

|

||||

[](https://www.youtube.com/watch?v=EJt3_bFYKss "La storia dell'AI di Amy Boyd")

|

||||

|

||||

## Compito

|

||||

|

||||

[Creare una sequenza temporale](assignment.it.md)

|

||||

|

||||

@ -1,114 +1,114 @@

|

||||

# Tecniche di Machine Learning

|

||||

|

||||

Il processo di creazione, utilizzo e mantenimento dei modelli di machine learning e dei dati che utilizzano è un processo molto diverso da molti altri flussi di lavoro di sviluppo. In questa lezione si demistifica il processo, e si delineano le principali tecniche che occorre conoscere. Si dovrà:

|

||||

|

||||

- Comprendere i processi ad alto livello alla base di machine learning.

|

||||

- Esplorare concetti di base come "modelli", "previsioni" e "dati di addestramento".

|

||||

|

||||

## [Quiz Pre-Lezione](https://white-water-09ec41f0f.azurestaticapps.net/quiz/7/)

|

||||

|

||||

## Introduzione

|

||||

|

||||

Ad alto livello, il mestiere di creare processi di apprendimento automatico (ML) comprende una serie di passaggi:

|

||||

|

||||

1. **Decidere circa la domanda**. La maggior parte dei processi ML inizia ponendo una domanda alla quale non è possibile ottenere risposta da un semplice programma condizionale o da un motore basato su regole. Queste domande spesso ruotano attorno a previsioni basate su una raccolta di dati.

|

||||

2. **Raccogliere e preparare i dati**. Per poter rispondere alla domanda, servono dati. La qualità e, a volte, la quantità dei dati determineranno quanto bene sarà possibile rispondere alla domanda iniziale. La visualizzazione dei dati è un aspetto importante di questa fase. Questa fase include anche la suddivisione dei dati in un gruppo di addestramento (training) e test per costruire un modello.

|

||||

3. **Scegliere un metodo di addestramento**. A seconda della domanda e della natura dei dati, è necessario scegliere come si desidera addestrare un modello per riflettere al meglio i dati e fare previsioni accurate su di essi. Questa è la parte del processo di ML che richiede competenze specifiche e, spesso, una notevole quantità di sperimentazione.

|

||||

4. **Addestrare il modello**. Usando i dati di addestramento, si utilizzeranno vari algoritmi per addestrare un modello a riconoscere modelli nei dati. Il modello potrebbe sfruttare pesi interni che possono essere regolati per privilegiare alcune parti dei dati rispetto ad altre per costruire un modello migliore.

|

||||

5. **Valutare il modello**. Si utilizzano dati mai visti prima (i dati di test) da quelli raccolti per osservare le prestazioni del modello.

|

||||

6. **Regolazione dei parametri**. In base alle prestazioni del modello, si può ripetere il processo utilizzando parametri differenti, o variabili, che controllano il comportamento degli algoritmi utilizzati per addestrare il modello.

|

||||

7. **Prevedere**. Usare nuovi input per testare la precisione del modello.

|

||||

|

||||

## Che domanda fare

|

||||

|

||||

I computer sono particolarmente abili nello scoprire modelli nascosti nei dati. Questa caratteristica è molto utile per i ricercatori che hanno domande su un determinato campo a cui non è possibile rispondere facilmente creando un motore di regole basato su condizioni. Dato un compito attuariale, ad esempio, un data scientist potrebbe essere in grado di costruire manualmente regole sulla mortalità dei fumatori rispetto ai non fumatori.

|

||||

|

||||

Quando molte altre variabili vengono introdotte nell'equazione, tuttavia, un modello ML potrebbe rivelarsi più efficiente per prevedere i tassi di mortalità futuri in base alla storia sanitaria passata. Un esempio più allegro potrebbe essere fare previsioni meteorologiche per il mese di aprile in una determinata località sulla base di dati che includono latitudine, longitudine, cambiamento climatico, vicinanza all'oceano, modelli della corrente a getto e altro ancora.

|

||||

|

||||

✅ Questa [presentazione](https://www2.cisl.ucar.edu/sites/default/files/0900%20June%2024%20Haupt_0.pdf) sui modelli meteorologici offre una prospettiva storica per l'utilizzo di ML nell'analisi meteorologica.

|

||||

|

||||

## Attività di pre-costruzione

|

||||

|

||||

Prima di iniziare a costruire il proprio modello, ci sono diverse attività da completare. Per testare la domanda e formare un'ipotesi basata sulle previsioni di un modello, occorre identificare e configurare diversi elementi.

|

||||

|

||||

### Dati

|

||||

|

||||

Per poter rispondere con sicurezza alla domanda, serve una buona quantità di dati del tipo giusto. Ci sono due cose da fare a questo punto:

|

||||

|

||||

- **Raccogliere dati**. Tenendo presente la lezione precedente sull'equità nell'analisi dei dati, si raccolgano i dati con cura. Ci sia consapevolezza delle fonti di questi dati, di eventuali pregiudizi intrinseci che potrebbero avere e si documenti la loro origine.

|

||||

- **Preparare i dati**. Ci sono diversi passaggi nel processo di preparazione dei dati. Potrebbe essere necessario raccogliere i dati e normalizzarli se provengono da fonti diverse. Si può migliorare la qualità e la quantità dei dati attraverso vari metodi come la conversione di stringhe in numeri (come si fa in [Clustering](../../../5-Clustering/1-Visualize/transaltions/README.it.md)). Si potrebbero anche generare nuovi dati, basati sull'originale (come si fa in [Classificazione](../../../4-Classification/1-Introduction/translations/README.it.md)). Si possono pulire e modificare i dati (come verrà fatto prima della lezione sull'[app Web](../../../3-Web-App/translations/README.it.md) ). Infine, si potrebbe anche aver bisogno di renderli casuali e mescolarli, a seconda delle proprie tecniche di addestramento.

|

||||

|

||||

✅ Dopo aver raccolto ed elaborato i propri dati, si prenda un momento per vedere se la loro forma consentirà di rispondere alla domanda prevista. Potrebbe essere che i dati non funzionino bene nello svolgere il compito assegnato, come si scopre nelle lezioni di [Clustering](../../../5-Clustering/1-Visualize/translations/README.it.md)!

|

||||

|

||||

### Caratteristiche e destinazione

|

||||

|

||||

Una funzionalità è una proprietà misurabile dei dati. In molti set di dati è espresso come intestazione di colonna come 'date' 'size' o 'color'. La variabile di funzionalità, solitamente rappresentata come `X` nel codice, rappresenta la variabile di input che verrà utilizzata per il training del modello.

|

||||

|

||||

Un obiettivo è una cosa che stai cercando di prevedere. Target solitamente rappresentato come `y` nel codice, rappresenta la risposta alla domanda che stai cercando di porre dei tuoi dati: a dicembre, di che colore saranno le zucche più economiche? a San Francisco, quali quartieri avranno il miglior prezzo immobiliare? A volte la destinazione viene anche definita attributo label.

|

||||

|

||||

### Selezione della variabile caratteristica

|

||||

|

||||

🎓 **Selezione ed estrazione della caratteristica** Come si fa a sapere quale variabile scegliere quando si costruisce un modello? Probabilmente si dovrà passare attraverso un processo di selezione o estrazione delle caratteristiche per scegliere le variabili giuste per il modello più efficace. Tuttavia, non è la stessa cosa: "L'estrazione delle caratteristiche crea nuove caratteristiche dalle funzioni delle caratteristiche originali, mentre la selezione delle caratteristiche restituisce un sottoinsieme delle caratteristiche". ([fonte](https://it.wikipedia.org/wiki/Selezione_delle_caratteristiche))

|

||||

|

||||

### Visualizzare i dati

|

||||

|

||||

Un aspetto importante del bagaglio del data scientist è la capacità di visualizzare i dati utilizzando diverse eccellenti librerie come Seaborn o MatPlotLib. Rappresentare visivamente i propri dati potrebbe consentire di scoprire correlazioni nascoste che si possono sfruttare. Le visualizzazioni potrebbero anche aiutare a scoprire pregiudizi o dati sbilanciati (come si scopre in [Classificazione](../../../4-Classification/2-Classifiers-1/translations/README.it.md)).

|

||||

|

||||

### Dividere l'insieme di dati

|

||||

|

||||

Prima dell'addestramento, è necessario dividere l'insieme di dati in due o più parti di dimensioni diverse che rappresentano comunque bene i dati.

|

||||

|

||||

- **Addestramento**. Questa parte dell'insieme di dati è adatta al proprio modello per addestrarlo. Questo insieme costituisce la maggior parte dell'insieme di dati originale.

|

||||

- **Test**. Un insieme di dati di test è un gruppo indipendente di dati, spesso raccolti dai dati originali, che si utilizzano per confermare le prestazioni del modello creato.

|

||||

- **Convalida**. Un insieme di convalida è un gruppo indipendente più piccolo di esempi da usare per ottimizzare gli iperparametri, o architettura, del modello per migliorarlo. A seconda delle dimensioni dei propri dati e della domanda che si sta ponendo, si potrebbe non aver bisogno di creare questo terzo insieme (come si nota in [Previsione delle Serie Temporali](../../../7-TimeSeries/1-Introduction/translations/README.it.md)).

|

||||

|

||||

## Costruire un modello

|

||||

|

||||

Utilizzando i dati di addestramento, l'obiettivo è costruire un modello o una rappresentazione statistica dei propri dati, utilizzando vari algoritmi per **addestrarlo** . L'addestramento di un modello lo espone ai dati e consente di formulare ipotesi sui modelli percepiti che scopre, convalida e accetta o rifiuta.

|

||||

|

||||

### Decidere un metodo di addestramento

|

||||

|

||||

A seconda della domanda e della natura dei dati, si sceglierà un metodo per addestrarlo. Passando attraverso [la documentazione di Scikit-learn](https://scikit-learn.org/stable/user_guide.html), che si usa in questo corso, si possono esplorare molti modi per addestrare un modello. A seconda della propria esperienza, si potrebbe dover provare diversi metodi per creare il modello migliore. È probabile che si attraversi un processo in cui i data scientist valutano le prestazioni di un modello fornendogli dati non visti, verificandone l'accuratezza, i pregiudizi e altri problemi che degradano la qualità e selezionando il metodo di addestramento più appropriato per l'attività da svolgere.

|

||||

|

||||

### Allenare un modello

|

||||

|

||||

Armati dei tuoi dati di allenamento, sei pronto a "adattarlo" per creare un modello. Noterai che in molte librerie ML troverai il codice "model.fit" - è in questo momento che invii la tua variabile di funzionalità come matrice di valori (in genere `X`) e una variabile di destinazione (di solito `y`).

|

||||

|

||||

### Valutare il modello

|

||||

|

||||

Una volta completato il processo di addestramento (potrebbero essere necessarie molte iterazioni, o "epoche", per addestrare un modello di grandi dimensioni), si sarà in grado di valutare la qualità del modello utilizzando i dati di test per valutarne le prestazioni. Questi dati sono un sottoinsieme dei dati originali che il modello non ha analizzato in precedenza. Si può stampare una tabella di metriche sulla qualità del proprio modello.

|

||||

|

||||

🎓 **Adattamento del modello**

|

||||

|

||||

Nel contesto di machine learning, l'adattamento del modello si riferisce all'accuratezza della funzione sottostante del modello mentre tenta di analizzare dati con cui non ha familiarità.

|

||||

|

||||

🎓 **Inadeguatezza** o **sovraadattamento** sono problemi comuni che degradano la qualità del modello, poiché il modello non si adatta abbastanza bene o troppo bene. Ciò fa sì che il modello esegua previsioni troppo allineate o troppo poco allineate con i suoi dati di addestramento. Un modello overfit (sovraaddestrato) prevede troppo bene i dati di addestramento perché ha appreso troppo bene i dettagli e il rumore dei dati. Un modello underfit (inadeguato) non è accurato in quanto non può né analizzare accuratamente i suoi dati di allenamento né i dati che non ha ancora "visto".

|

||||

|

||||

|

||||

> Infografica di [Jen Looper](https://twitter.com/jenlooper)

|

||||

|

||||

## Sintonia dei parametri

|

||||

|

||||

Una volta completato l'addestramento iniziale, si osservi la qualità del modello e si valuti di migliorarlo modificando i suoi "iperparametri". Maggiori informazioni sul processo [nella documentazione](https://docs.microsoft.com/en-us/azure/machine-learning/how-to-tune-hyperparameters?WT.mc_id=academic-15963-cxa).

|

||||

|

||||

## Previsione

|

||||

|

||||

Questo è il momento in cui si possono utilizzare dati completamente nuovi per testare l'accuratezza del proprio modello. In un'impostazione ML "applicata", in cui si creano risorse Web per utilizzare il modello in produzione, questo processo potrebbe comportare la raccolta dell'input dell'utente (ad esempio, la pressione di un pulsante) per impostare una variabile e inviarla al modello per l'inferenza, oppure valutazione.

|

||||

|

||||

In queste lezioni si scoprirà come utilizzare questi passaggi per preparare, costruire, testare, valutare e prevedere - tutti gesti di un data scientist e altro ancora, mentre si avanza nel proprio viaggio per diventare un ingegnere ML "full stack".

|

||||

|

||||

---

|

||||

|

||||

## 🚀 Sfida

|

||||

|

||||

Disegnare un diagramma di flusso che rifletta i passaggi di un professionista di ML. Dove ci si vede in questo momento nel processo? Dove si prevede che sorgeranno difficoltà? Cosa sembra facile?

|

||||

|

||||

## [Quiz post-lezione](https://white-water-09ec41f0f.azurestaticapps.net/quiz/8/)

|

||||

|

||||

## Revisione e Auto Apprendimento

|

||||

|

||||

Cercare online le interviste con i data scientist che discutono del loro lavoro quotidiano. Eccone [una](https://www.youtube.com/watch?v=Z3IjgbbCEfs).

|

||||

|

||||

## Compito

|

||||

|

||||

[Intervista a un data scientist](assignment.it.md)

|

||||

# Tecniche di Machine Learning

|

||||

|

||||

Il processo di creazione, utilizzo e mantenimento dei modelli di machine learning e dei dati che utilizzano è un processo molto diverso da molti altri flussi di lavoro di sviluppo. In questa lezione si demistifica il processo, e si delineano le principali tecniche che occorre conoscere. Si dovrà:

|

||||

|

||||

- Comprendere i processi ad alto livello alla base di machine learning.

|

||||

- Esplorare concetti di base come "modelli", "previsioni" e "dati di addestramento".

|

||||

|

||||

## [Quiz pre-lezione](https://white-water-09ec41f0f.azurestaticapps.net/quiz/7/?loc=it)

|

||||

|

||||

## Introduzione

|

||||

|

||||

Ad alto livello, il mestiere di creare processi di apprendimento automatico (ML) comprende una serie di passaggi:

|

||||

|

||||

1. **Decidere circa la domanda**. La maggior parte dei processi ML inizia ponendo una domanda alla quale non è possibile ottenere risposta da un semplice programma condizionale o da un motore basato su regole. Queste domande spesso ruotano attorno a previsioni basate su una raccolta di dati.

|

||||

2. **Raccogliere e preparare i dati**. Per poter rispondere alla domanda, servono dati. La qualità e, a volte, la quantità dei dati determineranno quanto bene sarà possibile rispondere alla domanda iniziale. La visualizzazione dei dati è un aspetto importante di questa fase. Questa fase include anche la suddivisione dei dati in un gruppo di addestramento (training) e test per costruire un modello.

|

||||

3. **Scegliere un metodo di addestramento**. A seconda della domanda e della natura dei dati, è necessario scegliere come si desidera addestrare un modello per riflettere al meglio i dati e fare previsioni accurate su di essi. Questa è la parte del processo di ML che richiede competenze specifiche e, spesso, una notevole quantità di sperimentazione.

|

||||

4. **Addestrare il modello**. Usando i dati di addestramento, si utilizzeranno vari algoritmi per addestrare un modello a riconoscere modelli nei dati. Il modello potrebbe sfruttare pesi interni che possono essere regolati per privilegiare alcune parti dei dati rispetto ad altre per costruire un modello migliore.

|

||||

5. **Valutare il modello**. Si utilizzano dati mai visti prima (i dati di test) da quelli raccolti per osservare le prestazioni del modello.

|

||||

6. **Regolazione dei parametri**. In base alle prestazioni del modello, si può ripetere il processo utilizzando parametri differenti, o variabili, che controllano il comportamento degli algoritmi utilizzati per addestrare il modello.

|

||||

7. **Prevedere**. Usare nuovi input per testare la precisione del modello.

|

||||

|

||||

## Che domanda fare

|

||||

|

||||

I computer sono particolarmente abili nello scoprire modelli nascosti nei dati. Questa caratteristica è molto utile per i ricercatori che hanno domande su un determinato campo a cui non è possibile rispondere facilmente creando un motore di regole basato su condizioni. Dato un compito attuariale, ad esempio, un data scientist potrebbe essere in grado di costruire manualmente regole sulla mortalità dei fumatori rispetto ai non fumatori.

|

||||

|

||||

Quando molte altre variabili vengono introdotte nell'equazione, tuttavia, un modello ML potrebbe rivelarsi più efficiente per prevedere i tassi di mortalità futuri in base alla storia sanitaria passata. Un esempio più allegro potrebbe essere fare previsioni meteorologiche per il mese di aprile in una determinata località sulla base di dati che includono latitudine, longitudine, cambiamento climatico, vicinanza all'oceano, modelli della corrente a getto e altro ancora.

|

||||

|

||||

✅ Questa [presentazione](https://www2.cisl.ucar.edu/sites/default/files/0900%20June%2024%20Haupt_0.pdf) sui modelli meteorologici offre una prospettiva storica per l'utilizzo di ML nell'analisi meteorologica.

|

||||

|

||||

## Attività di pre-costruzione

|

||||

|

||||

Prima di iniziare a costruire il proprio modello, ci sono diverse attività da completare. Per testare la domanda e formare un'ipotesi basata sulle previsioni di un modello, occorre identificare e configurare diversi elementi.

|

||||

|

||||

### Dati

|

||||

|

||||

Per poter rispondere con sicurezza alla domanda, serve una buona quantità di dati del tipo giusto. Ci sono due cose da fare a questo punto:

|

||||

|

||||

- **Raccogliere dati**. Tenendo presente la lezione precedente sull'equità nell'analisi dei dati, si raccolgano i dati con cura. Ci sia consapevolezza delle fonti di questi dati, di eventuali pregiudizi intrinseci che potrebbero avere e si documenti la loro origine.

|

||||

- **Preparare i dati**. Ci sono diversi passaggi nel processo di preparazione dei dati. Potrebbe essere necessario raccogliere i dati e normalizzarli se provengono da fonti diverse. Si può migliorare la qualità e la quantità dei dati attraverso vari metodi come la conversione di stringhe in numeri (come si fa in [Clustering](../../../5-Clustering/1-Visualize/transaltions/README.it.md)). Si potrebbero anche generare nuovi dati, basati sull'originale (come si fa in [Classificazione](../../../4-Classification/1-Introduction/translations/README.it.md)). Si possono pulire e modificare i dati (come verrà fatto prima della lezione sull'[app Web](../../../3-Web-App/translations/README.it.md) ). Infine, si potrebbe anche aver bisogno di renderli casuali e mescolarli, a seconda delle proprie tecniche di addestramento.

|

||||

|

||||

✅ Dopo aver raccolto ed elaborato i propri dati, si prenda un momento per vedere se la loro forma consentirà di rispondere alla domanda prevista. Potrebbe essere che i dati non funzionino bene nello svolgere il compito assegnato, come si scopre nelle lezioni di [Clustering](../../../5-Clustering/1-Visualize/translations/README.it.md)!

|

||||

|

||||

### Caratteristiche e destinazione

|

||||

|

||||

Una caratteristica è una proprietà misurabile dei dati. In molti set di dati è espresso come intestazione di colonna come 'date' 'size' o 'color'. La variabile di caratteristica, solitamente rappresentata come `X` nel codice, rappresenta la variabile di input che verrà utilizzata per il training del modello.

|

||||

|

||||

Un obiettivo è una cosa che stai cercando di prevedere. Target solitamente rappresentato come `y` nel codice, rappresenta la risposta alla domanda che stai cercando di porre dei tuoi dati: a dicembre, di che colore saranno le zucche più economiche? a San Francisco, quali quartieri avranno il miglior prezzo immobiliare? A volte la destinazione viene anche definita attributo label.

|

||||

|

||||

### Selezione della variabile caratteristica

|

||||

|

||||

🎓 **Selezione ed estrazione della caratteristica** Come si fa a sapere quale variabile scegliere quando si costruisce un modello? Probabilmente si dovrà passare attraverso un processo di selezione o estrazione delle caratteristiche per scegliere le variabili giuste per il modello più efficace. Tuttavia, non è la stessa cosa: "L'estrazione delle caratteristiche crea nuove caratteristiche dalle funzioni delle caratteristiche originali, mentre la selezione delle caratteristiche restituisce un sottoinsieme delle caratteristiche". ([fonte](https://it.wikipedia.org/wiki/Selezione_delle_caratteristiche))

|

||||

|

||||

### Visualizzare i dati

|

||||

|

||||

Un aspetto importante del bagaglio del data scientist è la capacità di visualizzare i dati utilizzando diverse eccellenti librerie come Seaborn o MatPlotLib. Rappresentare visivamente i propri dati potrebbe consentire di scoprire correlazioni nascoste che si possono sfruttare. Le visualizzazioni potrebbero anche aiutare a scoprire pregiudizi o dati sbilanciati (come si scopre in [Classificazione](../../../4-Classification/2-Classifiers-1/translations/README.it.md)).

|

||||

|

||||

### Dividere l'insieme di dati

|

||||

|

||||

Prima dell'addestramento, è necessario dividere l'insieme di dati in due o più parti di dimensioni diverse che rappresentano comunque bene i dati.

|

||||

|

||||

- **Addestramento**. Questa parte dell'insieme di dati è adatta al proprio modello per addestrarlo. Questo insieme costituisce la maggior parte dell'insieme di dati originale.

|

||||

- **Test**. Un insieme di dati di test è un gruppo indipendente di dati, spesso raccolti dai dati originali, che si utilizzano per confermare le prestazioni del modello creato.

|

||||

- **Convalida**. Un insieme di convalida è un gruppo indipendente più piccolo di esempi da usare per ottimizzare gli iperparametri, o architettura, del modello per migliorarlo. A seconda delle dimensioni dei propri dati e della domanda che si sta ponendo, si potrebbe non aver bisogno di creare questo terzo insieme (come si nota in [Previsione delle Serie Temporali](../../../7-TimeSeries/1-Introduction/translations/README.it.md)).

|

||||

|

||||

## Costruire un modello

|

||||

|

||||

Utilizzando i dati di addestramento, l'obiettivo è costruire un modello o una rappresentazione statistica dei propri dati, utilizzando vari algoritmi per **addestrarlo** . L'addestramento di un modello lo espone ai dati e consente di formulare ipotesi sui modelli percepiti che scopre, convalida e accetta o rifiuta.

|

||||

|

||||

### Decidere un metodo di addestramento

|

||||

|

||||

A seconda della domanda e della natura dei dati, si sceglierà un metodo per addestrarlo. Passando attraverso [la documentazione di Scikit-learn](https://scikit-learn.org/stable/user_guide.html), che si usa in questo corso, si possono esplorare molti modi per addestrare un modello. A seconda della propria esperienza, si potrebbe dover provare diversi metodi per creare il modello migliore. È probabile che si attraversi un processo in cui i data scientist valutano le prestazioni di un modello fornendogli dati non visti, verificandone l'accuratezza, i pregiudizi e altri problemi che degradano la qualità e selezionando il metodo di addestramento più appropriato per l'attività da svolgere.

|

||||

|

||||

### Allenare un modello

|

||||

|

||||

Armati dei tuoi dati di allenamento, sei pronto a "adattarlo" per creare un modello. Noterai che in molte librerie ML troverai il codice "model.fit" - è in questo momento che invii la tua variabile di funzionalità come matrice di valori (in genere `X`) e una variabile di destinazione (di solito `y`).

|

||||

|

||||

### Valutare il modello

|

||||

|

||||

Una volta completato il processo di addestramento (potrebbero essere necessarie molte iterazioni, o "epoche", per addestrare un modello di grandi dimensioni), si sarà in grado di valutare la qualità del modello utilizzando i dati di test per valutarne le prestazioni. Questi dati sono un sottoinsieme dei dati originali che il modello non ha analizzato in precedenza. Si può stampare una tabella di metriche sulla qualità del proprio modello.

|

||||

|

||||

🎓 **Adattamento del modello**

|

||||

|

||||

Nel contesto di machine learning, l'adattamento del modello si riferisce all'accuratezza della funzione sottostante del modello mentre tenta di analizzare dati con cui non ha familiarità.

|

||||

|

||||

🎓 **Inadeguatezza** o **sovraadattamento** sono problemi comuni che degradano la qualità del modello, poiché il modello non si adatta abbastanza bene o troppo bene. Ciò fa sì che il modello esegua previsioni troppo allineate o troppo poco allineate con i suoi dati di addestramento. Un modello overfit (sovraaddestrato) prevede troppo bene i dati di addestramento perché ha appreso troppo bene i dettagli e il rumore dei dati. Un modello underfit (inadeguato) non è accurato in quanto non può né analizzare accuratamente i suoi dati di allenamento né i dati che non ha ancora "visto".

|

||||

|

||||

|

||||

> Infografica di [Jen Looper](https://twitter.com/jenlooper)

|

||||

|

||||

## Sintonia dei parametri

|

||||

|

||||

Una volta completato l'addestramento iniziale, si osservi la qualità del modello e si valuti di migliorarlo modificando i suoi "iperparametri". Maggiori informazioni sul processo [nella documentazione](https://docs.microsoft.com/en-us/azure/machine-learning/how-to-tune-hyperparameters?WT.mc_id=academic-15963-cxa).

|

||||

|

||||

## Previsione

|

||||

|

||||

Questo è il momento in cui si possono utilizzare dati completamente nuovi per testare l'accuratezza del proprio modello. In un'impostazione ML "applicata", in cui si creano risorse Web per utilizzare il modello in produzione, questo processo potrebbe comportare la raccolta dell'input dell'utente (ad esempio, la pressione di un pulsante) per impostare una variabile e inviarla al modello per l'inferenza, oppure valutazione.

|

||||

|

||||

In queste lezioni si scoprirà come utilizzare questi passaggi per preparare, costruire, testare, valutare e prevedere - tutti gesti di un data scientist e altro ancora, mentre si avanza nel proprio viaggio per diventare un ingegnere ML "full stack".

|

||||

|

||||

---

|

||||

|

||||

## 🚀 Sfida

|

||||

|

||||

Disegnare un diagramma di flusso che rifletta i passaggi di un professionista di ML. Dove ci si vede in questo momento nel processo? Dove si prevede che sorgeranno difficoltà? Cosa sembra facile?

|

||||

|

||||

## [Quiz post-lezione](https://white-water-09ec41f0f.azurestaticapps.net/quiz/8/?loc=it)

|

||||

|

||||

## Revisione e Auto Apprendimento

|

||||

|

||||

Cercare online le interviste con i data scientist che discutono del loro lavoro quotidiano. Eccone [una](https://www.youtube.com/watch?v=Z3IjgbbCEfs).

|

||||

|

||||

## Compito

|

||||

|

||||

[Intervista a un data scientist](assignment.it.md)

|

||||

|

||||

@ -0,0 +1,13 @@

|

||||

# Una caccia al tesoro per ML

|

||||

|

||||

## Istruzioni

|

||||

|

||||

In questa lezione si sono appresi molti casi d'uso reali che sono stati risolti utilizzando machine learning classico. Sebbene l'uso del deep learning, di nuove tecniche e strumenti nell'intelligenza artificiale e lo sfruttamento delle reti neurali abbia contribuito ad accelerare la produzione di strumenti per aiutare in questi settori, il machine learning classico che utilizza le tecniche esposte in questo programma di studi ha ancora un grande valore.

|

||||

|

||||

In questo compito, si immagini di partecipare a un [hackathon](https://it.wikipedia.org/wiki/Hackathon). Usare ciò che si è appreso nel programma di studi per proporre una soluzione usando ML classico per risolvere un problema in uno dei settori discussi in questa lezione. Creare una presentazione in cui si discute come implementare la propria idea. Punti bonus se si riesce a raccogliere dati di esempio e creare un modello ML per supportare il proprio concetto!

|

||||

|

||||

## Rubrica

|

||||

|

||||

| Criteri | Ottimo | Adeguato | Necessita miglioramento |

|

||||

| -------- | ------------------------------------------------------------------- | ------------------------------------------------- | ---------------------- |

|

||||

| | Viene esposta una presentazione PowerPoint - bonus per la creazione di un modello | Viene esposta una presentazione di base non innovativa | Il lavoro è incompleto |

|

||||

@ -0,0 +1,15 @@

|

||||

# Poscritto: applicazioni del mondo reale di machine learning classico

|

||||

|

||||

In questa sezione del programma di studi, verranno presentate alcune applicazioni del mondo reale di machine learning classico. Internet è stata setacciata per trovare [whitepaper](https://it.wikipedia.org/wiki/White_paper) e articoli sulle applicazioni che hanno utilizzato queste strategie, evitando il più possibile le reti neurali, il deep learning e l'intelligenza artificiale. Si scoprirà come viene utilizzato machine learning nei sistemi aziendali, applicazioni ecologiche, finanza, arte e cultura e altro ancora.

|

||||

|

||||

|

||||

|

||||

> Foto di <a href="https://unsplash.com/@childeye?utm_source=unsplash&utm_medium=referral&utm_content=creditCopyText">Alexis Fauvet</a> su <a href="https://unsplash.com/s/photos/artificial-intelligence?utm_source=unsplash&utm_medium=referral&utm_content=creditCopyText">Unsplash</a>

|

||||

|

||||

## Lezione

|

||||

|

||||

1. [Applicazioni del mondo reale per ML](../1-Applications/translations/README.it.md)

|

||||

|

||||

## Crediti

|

||||

|

||||

"Real-World Applications" è stato scritto da un team di persone, tra cui [Jen Looper](https://twitter.com/jenlooper) e [Ornella Altunyan](https://twitter.com/ornelladotcom).

|

||||

File diff suppressed because it is too large

Load Diff

@ -0,0 +1,123 @@

|

||||

[](https://github.com/microsoft/ML-For-Beginners/blob/master/LICENSE)

|

||||

[](https://GitHub.com/microsoft/ML-For-Beginners/graphs/contributors/)

|

||||

[](https://GitHub.com/microsoft/ML-For-Beginners/issues/)

|

||||

[](https://GitHub.com/microsoft/ML-For-Beginners/pulls/)

|

||||

[](http://makeapullrequest.com)

|

||||

|

||||

[](https://GitHub.com/microsoft/ML-For-Beginners/watchers/)

|

||||

[](https://GitHub.com/microsoft/ML-For-Beginners/network/)

|

||||

[](https://GitHub.com/microsoft/ML-For-Beginners/stargazers/)

|

||||

|

||||

# Machine Learning per Principianti - Un Programma di Studio

|

||||

|

||||

> 🌍 Viaggio intorno al mondo esploreando Machine Learning per mezzo delle culture mondiali 🌍

|

||||

|

||||

Azure Cloud Advocates in Microsoft sono lieti di offrire un programma di studi di 12 settimane, 24 lezioni (più una!) tutto su **Machine Learning**. In questo programma di studi, si imparerà di ciò che a volte è chiamato **machine learning classico**, usando principalmente Scikit-learn come libreria ed evitando il depp learning, che è coperto nel nostro prossimo programma "AI per il curriculum dei principianti". Queste lezioni si accoppiano anche con il programma di studi di prossima uscita "Data Science per principianti"!

|

||||

|

||||

Si viaggerà insieme in tutto il mondo mentre si applicano queste tecniche classiche ai dati di molte aree del mondo. Ogni lezione include quiz pre e post-lezione, istruzioni scritte per completare la lezione, una soluzione, un compito e altro ancora. La pedagogia basata su progetto consente di imparare durante la costruzione, un modo comprovato per fissare nella mente nuove abilità.

|

||||

|

||||

**✍️ Un grazie di cuore agli autori** Jen Looper, Stephen Howell, Francesca Lazzeri, Tomomi Imura, Cassie Breviu, Dmitry Soshnikov, Chris Noring, Ornella Altunyan, e Amy Boyd

|

||||

|

||||

**🎨 Grazie anche ai nostri illustratori** Tomomi Imura, Dasani Madipalli, e Jen Looper

|

||||

|

||||

**🙏 Un ringraziamento speciale 🙏 agli autori di Microsoft Student Ambassador, revisori e collaboratori per i contenuti**, in particolare Rishit Dagli, Muhammad Sakib Khan Inan, Rohan Raj, Alexandru Petrescu, Abhishek Jaiswal, Nawrin Tabassum, Ioan Samuila, e Snigdha Agarwal

|

||||

|

||||

**🤩 Un grazie supplementare al Microsoft Student Ambassador Eric Wanjau per le lezioni su R!**

|

||||

|

||||

---

|

||||

|

||||

# Per Iniziare

|

||||

|

||||

**Studenti**, per utilizzare questo programma di studi, eseguire il fork dell'intero repo sul proprio account GitHub e completare gli esercizi da soli o in gruppo:

|

||||

|

||||

- Iniziare con un quiz pre-lezione.

|

||||

- Leggere la lezione e completare le attività, facendo una pausa di riflessione in ogni controllo della conoscenza.

|

||||

- Provare a creare i progetti capendo le lezioni piuttosto che eseguire il codice della soluzione; comunque quel codice è disponibile nelle cartelle `/solution` in ogni lezione relativa al progetto.

|

||||

- Fare il quiz post-lezione.

|

||||

- Completare la sfida.

|

||||

- Completare il compito.

|

||||

- Dopo il completamento di un gruppo di lezioni, visitar il [Forum di discussione](https://github.com/microsoft/ML-For-Beginners/discussions) e imparare ad alta voce riempiendo la rubrica di Pat appropriata. Un 'PAT' è uno Strumento di valutazione del progresso che è una rubrica che si compila per promuovere il proprio apprendimento. Si può entrare anche in altri PAT in modo da imparare assieme.

|

||||

|

||||

> Per ulteriori approfondimenti, si raccomanda di sequire i seguenti moduli e percorsi di apprendimento [Microsoft Learn](https://docs.microsoft.com/en-us/users/jenlooper-2911/collections/k7o7tg1gp306q4?WT.mc_id=academic-15963-cxa).

|

||||

|

||||

**Insegnanti**, sono stati [inclusi alcuni suggerimenti](for-teachers.md) su come usare questo programma di studi.

|

||||

|

||||

---

|

||||

|

||||

## Incontrare la squadra

|

||||

|

||||

[](https://youtu.be/Tj1XWrDSYJU "Promo video")

|

||||

|

||||

> 🎥 Cliccare l'immagine qui sopra per un video sul progetto e sulle persone che lo hanno creato!

|

||||

|

||||

---

|

||||

|

||||

## Pedagogia

|

||||

|

||||

Sono stati scelti due principi pedagogici durante la creazione di questo programma di studi: assicurandosi che sia pratico **basato su progetto** e che includa **quiz frequenti**. Inoltre, questo programma di studi ha un **tema** comune per conferirgli coesione.

|

||||

|

||||

Assicurandosi che il contenuto si allinei con i progetti, il processo è reso più coinvolgente per gli studenti e la conservazione dei concetti sarà aumentata. Inoltre, un quiz di poca difficoltà prima di una lezione imposta l'intenzione dello studente verso l'apprendimento di un argomento, mentre un secondo quiz dopo la lezione garantisce ulteriore ritenzione. Questo programma di studi è stato progettato per essere flessibile e divertente e può essere seguito in tutto o in parte. I progetti iniziano piccoli e diventano sempre più complessi entro la fine del ciclo di 12 settimane. Questo programma di studi include anche un poscritto sulle applicazioni del mondo reale di ML, che può essere utilizzata come credito extra o come base per la discussione.

|

||||

|

||||

> Consultare Le linee guida del [Codice di Condotta](CODE_OF_CONDUCT.md), per [Collaborare](CONTRIBUTING.md), e [Tradurre](TRANSLATIONS.md). Un feedback costruttivo sarà accolto con piacere!

|

||||

|

||||

## Ogni lezione include:

|

||||

|

||||

- sketchNote opzionale

|

||||

- video supplementare opzionale

|

||||

- quiz di riscaldamento pre-lezione

|

||||

- lezione scritta

|

||||

- per lezioni basate su progetto, guide passo-passo su come costruire il progetto

|

||||

- controlli della conoscenza

|

||||

- una sfida

|

||||

- lettura supplementare

|

||||

- Compito

|

||||

- Quiz post-lezione

|

||||

|

||||

> **Una nota sui quiz**: Tutti i quiz sono contenuti [in questa app](https://white-water-09ec41f0f.azurestaticapps.net/), per un totale di 50 quiz con tre domande ciascuno. They are linked from within the lessons but the quiz app can be run locally; follow the instruction in the `quiz-app` folder.

|

||||

|

||||

| Numero Lezione | Argomento | Gruppo Lezioni | Obiettivi di Apprendimento | Lezioni Collegate | Autore |

|

||||

| :-----------: | :--------------------------------------------------------: | :-------------------------------------------------: | ------------------------------------------------------------------------------------------------------------------------------- | :---------------------------------------------------: | :------------: |

|

||||

| 01 | Introduzione a machine learning | [Introduzione](../1-Introduction/translations/README.it.md) | Apprendere i concetti di base dietro machine learning | [lezione](../1-Introduction/1-intro-to-ML/translations/README.it.md) | Muhammad |

|

||||

| 02 | La storia di machine learning | [Introduzione](../1-Introduction/translations/README.it.md) | Apprendere la storia alla base di questo campo | [lezione](../1-Introduction/2-history-of-ML/translations/README.it.md) | Jen e Amy |

|

||||

| 03 | Equità e machine learning | [Introduzione](../1-Introduction/translations/README.it.md) | Quali sono gli importanti quesiti filosofici attorno all'equità che gli studenti dovrebbero prendere in considerazione quando si costruiscono e applicano i modelli ML? | [lezione](../1-Introduction/3-fairness/translations/README.it.md) | Tomomi |

|

||||

| 04 | Tecniche di machine learning | [Introduzione](../1-Introduction/translations/README.it.md) | Quali tecniche usano i ricercatori ML per costruire modelli ML? | [lezione](../1-Introduction/4-techniques-of-ML/translations/README.it.md) | Chris e Jen |

|

||||

| 05 | Introduzione alla regressione | [Regressione](../2-Regression/translations/README.it.md) | Iniziare con Python e Scikit-learn per i modelli di regressione | [lezione](../2-Regression/1-Tools/translations/README.it.md) | Jen |

|

||||

| 06 | Prezzi della zucca del Nord America 🎃 | [Regressione](../2-Regression/translations/README.it.md) | Visualizzare e pulire i dati in preparazione per ML | [lezione](../2-Regression/2-Data/translations/README.it.md) | Jen |

|

||||

| 07 | Prezzi della zucca del Nord America 🎃 | [Regressione](../2-Regression/translations/README.it.md) | Costruire modelli di regressione lineare e polinomiale | [lezione](../2-Regression/3-Linear/translations/README.it.md) | Jen |

|

||||

| 08 | Prezzi della zucca del Nord America 🎃 | [Regressione](../2-Regression/translations/README.it.md) | Costruire un modello di regressione logistico | [lezione](../2-Regression/4-Logistic/translations/README.it.md) | Jen |

|

||||

| 09 | Una App web 🔌 | [App Web](../3-Web-App/translations/README.it.md) | Costruire un'App web per utilizzare il proprio modello addestrato | [lezione](../3-Web-App/1-Web-App/translations/README.it.md) | Jen |

|

||||

| 10 | Introduzione alla classificazione | [Classificazione](../4-Classification/translations/README.it.md) | Pulire, preparare e visualizzare i dati;Introduzione alla classificazione | [lezione](../4-Classification/1-Introduction/translations/README.it.md) | Jen e Cassie |

|

||||

| 11 | Deliziose cucine asiatiche e indiane 🍜 | [Classificazione](../4-Classification/translations/README.it.md) | Introduzione ai classificatori | [lezione](../4-Classification/2-Classifiers-1/translations/README.it.md) | Jen e Cassie |

|

||||

| 12 | Deliziose cucine asiatiche e indiane 🍜 | [Classificazione](../4-Classification/translations/README.it.md) | Ancora classificatori | [lezione](../4-Classification/3-Classifiers-2/translations/README.it.md) | Jen e Cassie |

|

||||

| 13 | Deliziose cucine asiatiche e indiane 🍜 | [Classificazione](../4-Classification/translations/README.it.md) | Costruisci un'App web di raccomandazione usando il proprio modello | [lezione](../4-Classification/4-Applied/translations/README.it.md) | Jen |

|

||||

| 14 | Introduzione al clustering. | [Clustering](../5-Clustering/translations/README.it.md) | Pulire, preparare e visualizzare i dati; Introduzione al clustering. | [lezione](../5-Clustering/1-Visualize/translations/README.it.md) | Jen |

|

||||

| 15 | Esplorare i gusti musicali nigeriani 🎧 | [Clustering](../5-Clustering/translations/README.it.md) | Esplora il metodo di clustering K-means | [lezione](../5-Clustering/2-K-Means/translations/README.it.md) | Jen |

|

||||

| 16 | Introduzione all'elaborazione naturale del linguaggio ☕️ | [Elaborazione del linguaggio naturale](../6-NLP/translations/README.it.md) | Imparare le basi di NLP costruendo un semplice bot | [lezione](../6-NLP/1-Introduction-to-NLP/translations/README.it.md) | Stephen |

|

||||

| 17 | Attività NLP comuni ☕️ | [Elaborazione del linguaggio naturale](../6-NLP/translations/README.it.md) | Approfondisci la tua conoscenza dell'NLP comprendendo i compiti comuni richiesti quando si tratta di gestire strutture linguistiche | [lezione](../6-NLP/2-Tasks/translations/README.it.md) | Stephen |

|

||||

| 18 | Translation e analisi del sentimento ♥️ | [Elaborazione del linguaggio naturale](../6-NLP/translations/README.it.md) | Traduzione e analisi del sentimento con Jane Austen | [lezione](../6-NLP/3-Translation-Sentiment/translations/README.it.md) | Stephen |

|

||||

| 19 | Hotel romantici dell'Europa ♥️ | [Elaborazione del linguaggio naturale](../6-NLP/translations/README.it.md) | Analisi del sentimento con le recensioni di hotel 1 | [lezione](../6-NLP/4-Hotel-Reviews-1/translations/README.it.md) | Stephen |

|

||||

| 20 | Hotel romantici dell'Europa ♥️ | [Elaborazione del linguaggio naturale](../6-NLP/translations/README.it.md) | Analisi del sentimento con le recensioni di hotel 2 | [lezione](../6-NLP/5-Hotel-Reviews-2/translations/README.it.md) | Stephen |

|

||||

| 21 | Introduzione alle previsioni delle serie temporali | [Time series](../7-TimeSeries/translations/README.it.md) | Introduzione alle previsioni delle serie temporali | [lezione](../7-TimeSeries/1-Introduction/translations/README.it.md) | Francesca |

|

||||

| 22 | ⚡️ Utilizzo energetico mondiale ⚡️ - previsione di serie temporali con ARIMA | [Time series](../7-TimeSeries/translations/README.it.md) | Previsione di serie temporali con ARIMA | [lezione](../7-TimeSeries/2-ARIMA/translations/README.it.md) | Francesca |

|

||||

| 23 | Introduzione al reinforcement learning | [Reinforcement learning](../8-Reinforcement/translations/README.it.md) | Introduzione al reinforcement learning con Q-Learning | [lezione](../8-Reinforcement/1-QLearning/translations/README.it.md) | Dmitry |

|

||||

| 24 | Aiutare Pierino a evitare il lupo! 🐺 | [Reinforcement learning](../8-Reinforcement/translations/README.it.md) | Reinforcement learning Gym | [lezione](../8-Reinforcement/2-Gym/translations/README.it.md) | Dmitry |

|

||||

| Poscritto | Scenari e applicazioni ML del mondo reale | [ML in the Wild](../9-Real-World/translations/README.it.md) | Applicazioni interessanti e rivelanti applicazioni di ML classico del mondo reale | [lezione](../9-Real-World/1-Applications/translations/README.it.md) | Team |

|

||||

|

||||

## Accesso offline

|

||||

|

||||

Si può eseguire questa documentazione offline usando [Docsify](https://docsify.js.org/#/). Effettuare il fork di questo, [installare Docsify](https://docsify.js.org/#/quickstart) sulla propria macchina locale, quindi nella cartella radice di questo repo digitare `docsify serve`. Il sito web sarà servito sulla porta 3000 di localhost: `localhost:3000`.

|

||||

|

||||

## PDF

|

||||

|

||||

Si può trovare un pdf con il programma di studio e collegamenti [qui](pdf/readme.pdf).

|

||||

|

||||

## Cercasi aiuto!

|

||||

|

||||

Si vorrebbe contribuire a una traduzione? Per favore leggere le [linee guida di traduzione](TRANSLATIONS.md) e aggiungere eventuale input [qui](https://github.com/microsoft/ML-For-Beginners/issues/71).

|

||||

|

||||

## Altri Programmi di Studi\

|

||||

|

||||

Il nostro team produce altri Programmi di Studi! Dare un occhiatat:

|

||||

|

||||

- [Web Dev per Principianti](https://aka.ms/webdev-beginners)

|

||||

- [IoT for Beginners](https://aka.ms/iot-beginners)

|

||||

Loading…

Reference in new issue