|

|

2 weeks ago | |

|---|---|---|

| .. | ||

| solution | 2 weeks ago | |

| README.md | 2 weeks ago | |

| assignment.ipynb | 2 weeks ago | |

| assignment.md | 3 weeks ago | |

| notebook.ipynb | 2 weeks ago | |

README.md

ਸਟੈਟਿਸਟਿਕਸ ਅਤੇ ਪ੍ਰੋਬੈਬਿਲਿਟੀ ਦਾ ਸੰਖੇਪ ਪਰੀਚਯ

| ਸਟੈਟਿਸਟਿਕਸ ਅਤੇ ਪ੍ਰੋਬੈਬਿਲਿਟੀ - @nitya ਦੁਆਰਾ ਸਕੈਚਨੋਟ |

ਸਟੈਟਿਸਟਿਕਸ ਅਤੇ ਪ੍ਰੋਬੈਬਿਲਿਟੀ ਥਿਊਰੀ ਗਣਿਤ ਦੇ ਦੋ ਬਹੁਤ ਹੀ ਜੁੜੇ ਹੋਏ ਖੇਤਰ ਹਨ ਜੋ ਡਾਟਾ ਸਾਇੰਸ ਲਈ ਬਹੁਤ ਮਹੱਤਵਪੂਰਨ ਹਨ। ਡਾਟਾ ਨਾਲ ਬਿਨਾ ਗਣਿਤ ਦੀ ਗਹਿਰਾਈ ਵਾਲੀ ਜਾਣਕਾਰੀ ਦੇ ਕੰਮ ਕਰਨਾ ਸੰਭਵ ਹੈ, ਪਰ ਕੁਝ ਮੂਲ ਧਾਰਨਾਵਾਂ ਜਾਣਨਾ ਫਿਰ ਵੀ ਵਧੀਆ ਹੈ। ਇੱਥੇ ਅਸੀਂ ਇੱਕ ਛੋਟਾ ਪਰੀਚਯ ਪੇਸ਼ ਕਰਾਂਗੇ ਜੋ ਤੁਹਾਨੂੰ ਸ਼ੁਰੂਆਤ ਕਰਨ ਵਿੱਚ ਮਦਦ ਕਰੇਗਾ।

ਪ੍ਰੀ-ਲੈਕਚਰ ਕਵਿਜ਼

ਪ੍ਰੋਬੈਬਿਲਿਟੀ ਅਤੇ ਰੈਂਡਮ ਵੈਰੀਏਬਲਜ਼

ਪ੍ਰੋਬੈਬਿਲਿਟੀ 0 ਅਤੇ 1 ਦੇ ਵਿਚਕਾਰ ਇੱਕ ਗਿਣਤੀ ਹੈ ਜੋ ਦੱਸਦੀ ਹੈ ਕਿ ਕੋਈ ਘਟਨਾ ਕਿੰਨੀ ਸੰਭਾਵਨਾ ਵਾਲੀ ਹੈ। ਇਹ ਸਾਰੇ ਸੰਭਾਵਨਾਵਾਂ ਦੇ ਸਮਾਨ ਹੋਣ ਦੀ ਸ਼ਰਤ 'ਤੇ, ਸਕਾਰਾਤਮਕ ਨਤੀਜਿਆਂ ਦੀ ਗਿਣਤੀ ਨੂੰ ਕੁੱਲ ਨਤੀਜਿਆਂ ਦੀ ਗਿਣਤੀ ਨਾਲ ਵੰਡ ਕੇ ਪਰਿਭਾਸ਼ਿਤ ਕੀਤੀ ਜਾਂਦੀ ਹੈ। ਉਦਾਹਰਣ ਲਈ, ਜਦੋਂ ਅਸੀਂ ਪਾਸਾ ਸੁੱਟਦੇ ਹਾਂ, ਤਾਂ ਇੱਕ ਜੋੜੇ ਨੰਬਰ ਆਉਣ ਦੀ ਸੰਭਾਵਨਾ 3/6 = 0.5 ਹੈ।

ਜਦੋਂ ਅਸੀਂ ਘਟਨਾਵਾਂ ਬਾਰੇ ਗੱਲ ਕਰਦੇ ਹਾਂ, ਤਾਂ ਅਸੀਂ ਰੈਂਡਮ ਵੈਰੀਏਬਲਜ਼ ਦੀ ਵਰਤੋਂ ਕਰਦੇ ਹਾਂ। ਉਦਾਹਰਣ ਲਈ, ਪਾਸਾ ਸੁੱਟਣ 'ਤੇ ਪ੍ਰਾਪਤ ਨੰਬਰ ਨੂੰ ਦਰਸਾਉਣ ਵਾਲਾ ਰੈਂਡਮ ਵੈਰੀਏਬਲ 1 ਤੋਂ 6 ਤੱਕ ਦੇ ਮੁੱਲ ਲੈਂਦਾ ਹੈ। 1 ਤੋਂ 6 ਤੱਕ ਦੇ ਨੰਬਰਾਂ ਦਾ ਸੈਟ ਸੈਂਪਲ ਸਪੇਸ ਕਿਹਾ ਜਾਂਦਾ ਹੈ। ਅਸੀਂ ਰੈਂਡਮ ਵੈਰੀਏਬਲ ਦੇ ਕਿਸੇ ਵਿਸ਼ੇਸ਼ ਮੁੱਲ ਨੂੰ ਲੈਣ ਦੀ ਸੰਭਾਵਨਾ ਬਾਰੇ ਗੱਲ ਕਰ ਸਕਦੇ ਹਾਂ, ਉਦਾਹਰਣ ਲਈ P(X=3)=1/6।

ਪਿਛਲੇ ਉਦਾਹਰਣ ਵਿੱਚ ਰੈਂਡਮ ਵੈਰੀਏਬਲ ਨੂੰ ਡਿਸਕ੍ਰੀਟ ਕਿਹਾ ਜਾਂਦਾ ਹੈ, ਕਿਉਂਕਿ ਇਸਦਾ ਸੈਂਪਲ ਸਪੇਸ ਗਿਣਤੀਯੋਗ ਹੈ, ਅਰਥਾਤ ਅਲੱਗ ਅਲੱਗ ਮੁੱਲ ਹਨ ਜੋ ਗਿਣੇ ਜਾ ਸਕਦੇ ਹਨ। ਕੁਝ ਮਾਮਲਿਆਂ ਵਿੱਚ ਸੈਂਪਲ ਸਪੇਸ ਅਸਲ ਨੰਬਰਾਂ ਦੀ ਰੇਂਜ ਜਾਂ ਅਸਲ ਨੰਬਰਾਂ ਦਾ ਪੂਰਾ ਸੈਟ ਹੁੰਦਾ ਹੈ। ਇਸ ਤਰ੍ਹਾਂ ਦੇ ਵੈਰੀਏਬਲਜ਼ ਨੂੰ ਕੰਟਿਨਿਊਅਸ ਕਿਹਾ ਜਾਂਦਾ ਹੈ। ਇੱਕ ਵਧੀਆ ਉਦਾਹਰਣ ਹੈ ਬੱਸ ਦੇ ਆਉਣ ਦਾ ਸਮਾਂ।

ਪ੍ਰੋਬੈਬਿਲਿਟੀ ਡਿਸਟ੍ਰੀਬਿਊਸ਼ਨ

ਡਿਸਕ੍ਰੀਟ ਰੈਂਡਮ ਵੈਰੀਏਬਲਜ਼ ਦੇ ਮਾਮਲੇ ਵਿੱਚ, ਹਰ ਘਟਨਾ ਦੀ ਸੰਭਾਵਨਾ ਨੂੰ P(X) ਫੰਕਸ਼ਨ ਦੁਆਰਾ ਵਰਣਨ ਕਰਨਾ ਆਸਾਨ ਹੈ। ਸੈਂਪਲ ਸਪੇਸ S ਦੇ ਹਰ ਮੁੱਲ s ਲਈ ਇਹ 0 ਤੋਂ 1 ਤੱਕ ਦੀ ਗਿਣਤੀ ਦੇਵੇਗਾ, ਇਸ ਤਰ੍ਹਾਂ ਕਿ P(X=s) ਦੇ ਸਾਰੇ ਮੁੱਲਾਂ ਦਾ ਜੋੜ 1 ਹੋਵੇਗਾ।

ਸਭ ਤੋਂ ਪ੍ਰਸਿੱਧ ਡਿਸਕ੍ਰੀਟ ਡਿਸਟ੍ਰੀਬਿਊਸ਼ਨ ਯੂਨੀਫਾਰਮ ਡਿਸਟ੍ਰੀਬਿਊਸ਼ਨ ਹੈ, ਜਿਸ ਵਿੱਚ N ਤੱਤਾਂ ਦਾ ਸੈਂਪਲ ਸਪੇਸ ਹੁੰਦਾ ਹੈ, ਅਤੇ ਹਰ ਇੱਕ ਲਈ 1/N ਦੀ ਸਮਾਨ ਸੰਭਾਵਨਾ ਹੁੰਦੀ ਹੈ।

ਕੰਟਿਨਿਊਅਸ ਵੈਰੀਏਬਲ ਦੇ ਪ੍ਰੋਬੈਬਿਲਿਟੀ ਡਿਸਟ੍ਰੀਬਿਊਸ਼ਨ ਨੂੰ ਵਰਣਨ ਕਰਨਾ ਜ਼ਿਆਦਾ ਮੁਸ਼ਕਲ ਹੈ, ਜਿਸਦੇ ਮੁੱਲ ਕੁਝ ਇੰਟਰਵਾਲ [a,b] ਤੋਂ ਲਏ ਜਾਂਦੇ ਹਨ, ਜਾਂ ਅਸਲ ਨੰਬਰਾਂ ਦੇ ਪੂਰੇ ਸੈਟ ℝ ਤੋਂ। ਬੱਸ ਦੇ ਆਉਣ ਦੇ ਸਮੇਂ ਦੇ ਮਾਮਲੇ ਨੂੰ ਵਿਚਾਰ ਕਰੋ। ਅਸਲ ਵਿੱਚ, ਹਰ ਵਿਸ਼ੇਸ਼ ਆਉਣ ਦੇ ਸਮੇਂ t ਲਈ, ਬੱਸ ਦੇ ਉਸ ਸਮੇਂ 'ਤੇ ਆਉਣ ਦੀ ਸੰਭਾਵਨਾ 0 ਹੈ!

ਹੁਣ ਤੁਹਾਨੂੰ ਪਤਾ ਹੈ ਕਿ 0 ਸੰਭਾਵਨਾ ਵਾਲੀਆਂ ਘਟਨਾਵਾਂ ਹੁੰਦੀਆਂ ਹਨ, ਅਤੇ ਬਹੁਤ ਵਾਰ ਹੁੰਦੀਆਂ ਹਨ! ਘੱਟੋ-ਘੱਟ ਹਰ ਵਾਰ ਜਦੋਂ ਬੱਸ ਆਉਂਦੀ ਹੈ!

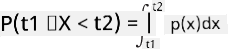

ਅਸੀਂ ਸਿਰਫ਼ ਕਿਸੇ ਵੈਰੀਏਬਲ ਦੇ ਮੁੱਲਾਂ ਦੇ ਦਿੱਤੇ ਇੰਟਰਵਾਲ ਵਿੱਚ ਪੈਣ ਦੀ ਸੰਭਾਵਨਾ ਬਾਰੇ ਗੱਲ ਕਰ ਸਕਦੇ ਹਾਂ, ਜਿਵੇਂ P(t1≤X<t2)। ਇਸ ਮਾਮਲੇ ਵਿੱਚ, ਪ੍ਰੋਬੈਬਿਲਿਟੀ ਡਿਸਟ੍ਰੀਬਿਊਸ਼ਨ ਨੂੰ ਪ੍ਰੋਬੈਬਿਲਿਟੀ ਡੈਂਸਿਟੀ ਫੰਕਸ਼ਨ p(x) ਦੁਆਰਾ ਵਰਣਨ ਕੀਤਾ ਜਾਂਦਾ ਹੈ, ਇਸ ਤਰ੍ਹਾਂ ਕਿ

ਯੂਨੀਫਾਰਮ ਡਿਸਟ੍ਰੀਬਿਊਸ਼ਨ ਦਾ ਇੱਕ ਕੰਟਿਨਿਊਅਸ ਰੂਪ ਕੰਟਿਨਿਊਅਸ ਯੂਨੀਫਾਰਮ ਕਿਹਾ ਜਾਂਦਾ ਹੈ, ਜੋ ਇੱਕ ਸੀਮਿਤ ਇੰਟਰਵਾਲ 'ਤੇ ਪਰਿਭਾਸ਼ਿਤ ਹੁੰਦਾ ਹੈ। ਸੰਭਾਵਨਾ ਕਿ ਮੁੱਲ X ਲੰਬਾਈ l ਦੇ ਇੰਟਰਵਾਲ ਵਿੱਚ ਪੈਂਦਾ ਹੈ, l ਦੇ ਅਨੁਪਾਤ ਵਿੱਚ ਹੁੰਦੀ ਹੈ, ਅਤੇ 1 ਤੱਕ ਵਧਦੀ ਹੈ।

ਇੱਕ ਹੋਰ ਮਹੱਤਵਪੂਰਨ ਡਿਸਟ੍ਰੀਬਿਊਸ਼ਨ ਨਾਰਮਲ ਡਿਸਟ੍ਰੀਬਿਊਸ਼ਨ ਹੈ, ਜਿਸ ਬਾਰੇ ਅਸੀਂ ਹੇਠਾਂ ਵਧੇਰੇ ਵਿਸਤਾਰ ਵਿੱਚ ਗੱਲ ਕਰਾਂਗੇ।

ਮੀਨ, ਵੈਰੀਅੰਸ ਅਤੇ ਸਟੈਂਡਰਡ ਡਿਵਿਏਸ਼ਨ

ਮੰਨੋ ਅਸੀਂ ਰੈਂਡਮ ਵੈਰੀਏਬਲ X ਦੇ n ਸੈਂਪਲਾਂ ਦੀ ਲੜੀ ਖਿੱਚਦੇ ਹਾਂ: x1, x2, ..., xn। ਅਸੀਂ ਲੜੀ ਦੇ ਮੀਨ (ਜਾਂ ਅੰਕਗਣਿਤ ਔਸਤ) ਮੁੱਲ ਨੂੰ ਰਵਾਇਤੀ ਢੰਗ ਨਾਲ (x1+x2+xn)/n ਵਜੋਂ ਪਰਿਭਾਸ਼ਿਤ ਕਰ ਸਕਦੇ ਹਾਂ। ਜਿਵੇਂ ਜਿਵੇਂ ਅਸੀਂ ਸੈਂਪਲ ਦਾ ਆਕਾਰ ਵਧਾਉਂਦੇ ਹਾਂ (ਅਰਥਾਤ n→∞), ਅਸੀਂ ਡਿਸਟ੍ਰੀਬਿਊਸ਼ਨ ਦਾ ਮੀਨ (ਜਾਂ ਐਕਸਪੈਕਟੇਸ਼ਨ) ਪ੍ਰਾਪਤ ਕਰਾਂਗੇ। ਅਸੀਂ ਐਕਸਪੈਕਟੇਸ਼ਨ ਨੂੰ E(x) ਨਾਲ ਦਰਸਾਵਾਂਗੇ।

ਇਹ ਦਿਖਾਇਆ ਜਾ ਸਕਦਾ ਹੈ ਕਿ ਕਿਸੇ ਵੀ ਡਿਸਕ੍ਰੀਟ ਡਿਸਟ੍ਰੀਬਿਊਸ਼ਨ ਲਈ ਜਿਸਦੇ ਮੁੱਲ {x1, x2, ..., xN} ਅਤੇ ਸੰਬੰਧਿਤ ਸੰਭਾਵਨਾਵਾਂ p1, p2, ..., pN ਹਨ, ਐਕਸਪੈਕਟੇਸ਼ਨ E(X)=x1p1+x2p2+...+xNpN ਦੇ ਬਰਾਬਰ ਹੋਵੇਗਾ।

ਮੁੱਲਾਂ ਕਿੰਨੇ ਫੈਲੇ ਹੋਏ ਹਨ, ਇਹ ਪਛਾਣਣ ਲਈ ਅਸੀਂ ਵੈਰੀਅੰਸ σ2 = ∑(xi - μ)2/n ਦੀ ਗਣਨਾ ਕਰ ਸਕਦੇ ਹਾਂ, ਜਿੱਥੇ μ ਲੜੀ ਦਾ ਮੀਨ ਹੈ। ਮੁੱਲ σ ਨੂੰ ਸਟੈਂਡਰਡ ਡਿਵਿਏਸ਼ਨ ਕਿਹਾ ਜਾਂਦਾ ਹੈ, ਅਤੇ σ2 ਨੂੰ ਵੈਰੀਅੰਸ ਕਿਹਾ ਜਾਂਦਾ ਹੈ।

ਮੋਡ, ਮੀਡਿਅਨ ਅਤੇ ਕਵਾਰਟਾਈਲਜ਼

ਕਈ ਵਾਰ, ਮੀਨ ਡਾਟਾ ਲਈ "ਟਿਪਿਕਲ" ਮੁੱਲ ਨੂੰ ਢੰਗ ਨਾਲ ਦਰਸਾਉਣ ਵਿੱਚ ਅਸਫਲ ਰਹਿੰਦਾ ਹੈ। ਉਦਾਹਰਣ ਲਈ, ਜਦੋਂ ਕੁਝ ਅਤਿ ਮੁੱਲ ਹੁੰਦੇ ਹਨ ਜੋ ਪੂਰੀ ਤਰ੍ਹਾਂ ਰੇਂਜ ਤੋਂ ਬਾਹਰ ਹੁੰਦੇ ਹਨ, ਉਹ ਮੀਨ ਨੂੰ ਪ੍ਰਭਾਵਿਤ ਕਰ ਸਕਦੇ ਹਨ। ਇੱਕ ਹੋਰ ਵਧੀਆ ਸੰਕੇਤ ਮੀਡਿਅਨ ਹੈ, ਇੱਕ ਮੁੱਲ ਜਿਸਦੇ ਹੇਠਾਂ ਡਾਟਾ ਪੌਇੰਟਾਂ ਦਾ ਅੱਧਾ ਹਿੱਸਾ ਹੁੰਦਾ ਹੈ, ਅਤੇ ਬਾਕੀ ਅੱਧਾ - ਉੱਪਰ।

ਡਾਟਾ ਦੇ ਡਿਸਟ੍ਰੀਬਿਊਸ਼ਨ ਨੂੰ ਸਮਝਣ ਵਿੱਚ ਸਹਾਇਤਾ ਕਰਨ ਲਈ, ਕਵਾਰਟਾਈਲਜ਼ ਬਾਰੇ ਗੱਲ ਕਰਨਾ ਲਾਭਦਾਇਕ ਹੈ:

- ਪਹਿਲਾ ਕਵਾਰਟਾਈਲ, ਜਾਂ Q1, ਇੱਕ ਮੁੱਲ ਹੈ, ਜਿਸਦੇ ਹੇਠਾਂ 25% ਡਾਟਾ ਪੈਂਦਾ ਹੈ

- ਤੀਜਾ ਕਵਾਰਟਾਈਲ, ਜਾਂ Q3, ਇੱਕ ਮੁੱਲ ਹੈ ਜਿਸਦੇ ਹੇਠਾਂ 75% ਡਾਟਾ ਪੈਂਦਾ ਹੈ

ਗ੍ਰਾਫਿਕਲ ਤੌਰ 'ਤੇ ਅਸੀਂ ਮੀਡਿਅਨ ਅਤੇ ਕਵਾਰਟਾਈਲਜ਼ ਦੇ ਸੰਬੰਧ ਨੂੰ ਬਾਕਸ ਪਲਾਟ ਵਿੱਚ ਦਰਸਾ ਸਕਦੇ ਹਾਂ:

ਇੱਥੇ ਅਸੀਂ ਇੰਟਰ-ਕਵਾਰਟਾਈਲ ਰੇਂਜ IQR=Q3-Q1 ਦੀ ਗਣਨਾ ਕਰਦੇ ਹਾਂ, ਅਤੇ ਆਊਟਲਾਇਰਜ਼ - ਮੁੱਲ ਜੋ ਸੀਮਾਵਾਂ [Q1-1.5IQR,Q3+1.5IQR] ਤੋਂ ਬਾਹਰ ਪੈਂਦੇ ਹਨ।

ਜਦੋਂ ਡਿਸਟ੍ਰੀਬਿਊਸ਼ਨ ਵਿੱਚ ਕੁਝ ਸੰਭਾਵਤ ਮੁੱਲਾਂ ਦੀ ਗਿਣਤੀ ਘੱਟ ਹੁੰਦੀ ਹੈ, ਇੱਕ ਵਧੀਆ "ਟਿਪਿਕਲ" ਮੁੱਲ ਉਹ ਹੁੰਦਾ ਹੈ ਜੋ ਸਭ ਤੋਂ ਵੱਧ ਵਾਰ ਆਉਂਦਾ ਹੈ, ਜਿਸਨੂੰ ਮੋਡ ਕਿਹਾ ਜਾਂਦਾ ਹੈ। ਇਹ ਅਕਸਰ ਸ਼੍ਰੇਣੀਬੱਧ ਡਾਟਾ, ਜਿਵੇਂ ਰੰਗਾਂ, 'ਤੇ ਲਾਗੂ ਹੁੰਦਾ ਹੈ। ਮੰਨੋ ਇੱਕ ਸਥਿਤੀ ਜਿੱਥੇ ਸਾਡੇ ਕੋਲ ਦੋ ਲੋਕਾਂ ਦੇ ਸਮੂਹ ਹਨ - ਕੁਝ ਜੋ ਲਾਲ ਨੂੰ ਪਸੰਦ ਕਰਦੇ ਹਨ, ਅਤੇ ਹੋਰ ਜੋ ਨੀਲੇ ਨੂੰ ਪਸੰਦ ਕਰਦੇ ਹਨ। ਜੇਕਰ ਅਸੀਂ ਰੰਗਾਂ ਨੂੰ ਨੰਬਰਾਂ ਦੁਆਰਾ ਕੋਡ ਕਰਦੇ ਹਾਂ, ਤਾਂ ਪਸੰਦੀਦਾ ਰੰਗ ਲਈ ਮੀਨ ਮੁੱਲ ਕਿਤੇ ਸੰਤਰੀ-ਹਰੇ ਸਪੈਕਟ੍ਰਮ ਵਿੱਚ ਹੋਵੇਗਾ, ਜੋ ਕਿਸੇ ਵੀ ਸਮੂਹ ਦੀ ਅਸਲ ਪਸੰਦ ਨੂੰ ਦਰਸਾਉਂਦਾ ਨਹੀਂ। ਹਾਲਾਂਕਿ, ਮੋਡ ਜਾਂ ਤਾਂ ਇੱਕ ਰੰਗ ਹੋਵੇਗਾ, ਜਾਂ ਦੋਵੇਂ ਰੰਗ, ਜੇਕਰ ਉਨ੍ਹਾਂ ਲਈ ਵੋਟ ਕਰਨ ਵਾਲੇ ਲੋਕਾਂ ਦੀ ਗਿਣਤੀ ਬਰਾਬਰ ਹੋਵੇ (ਇਸ ਮਾਮਲੇ ਵਿੱਚ ਅਸੀਂ ਸੈਂਪਲ ਨੂੰ ਮਲਟੀਮੋਡਲ ਕਹਿੰਦੇ ਹਾਂ)।

1, ..., Xn ਸਾਡੇ ਵੰਡ ਤੋਂ। ਹਰ ਵਾਰ ਜਦੋਂ ਅਸੀਂ ਸਾਡੇ ਵੰਡ ਤੋਂ ਨਮੂਨਾ ਖਿੱਚਦੇ ਹਾਂ, ਅਸੀਂ ਵੱਖ-ਵੱਖ ਔਸਤ ਮੁੱਲ μ ਨਾਲ ਖਤਮ ਕਰਦੇ ਹਾਂ। ਇਸ ਤਰ੍ਹਾਂ μ ਨੂੰ ਇੱਕ ਰੈਂਡਮ ਵੈਰੀਏਬਲ ਮੰਨਿਆ ਜਾ ਸਕਦਾ ਹੈ। ਇੱਕ ਭਰੋਸੇਮੰਦ ਅੰਤਰਾਲ ਭਰੋਸੇ p ਦੇ ਨਾਲ ਇੱਕ ਜੋੜੇ ਮੁੱਲਾਂ (Lp,Rp) ਦੇ ਰੂਪ ਵਿੱਚ ਹੁੰਦਾ ਹੈ, ਇਸ ਤਰ੍ਹਾਂ P(Lp≤μ≤Rp) = p, ਅਰਥਾਤ ਮਾਪੇ ਗਏ ਔਸਤ ਮੁੱਲ ਦੇ ਅੰਤਰਾਲ ਵਿੱਚ ਆਉਣ ਦੀ ਸੰਭਾਵਨਾ p ਦੇ ਬਰਾਬਰ ਹੁੰਦੀ ਹੈ।

ਇਹ ਸਾਡੇ ਛੋਟੇ ਜਾਨ-ਪਛਾਣ ਤੋਂ ਪਰੇ ਜਾਂਦਾ ਹੈ ਕਿ ਇਹ ਭਰੋਸੇਮੰਦ ਅੰਤਰਾਲ ਕਿਵੇਂ ਗਣਨਾ ਕੀਤੇ ਜਾਂਦੇ ਹਨ। ਕੁਝ ਹੋਰ ਵੇਰਵੇ ਵਿਕੀਪੀਡੀਆ 'ਤੇ ਮਿਲ ਸਕਦੇ ਹਨ। ਸੰਖੇਪ ਵਿੱਚ, ਅਸੀਂ ਅਸਲੀ ਵੰਡ ਦੇ ਔਸਤ ਦੇ ਸਬੰਧ ਵਿੱਚ ਗਣਨਾ ਕੀਤੇ ਗਏ ਨਮੂਨਾ ਔਸਤ ਦੀ ਵੰਡ ਨੂੰ ਪਰਿਭਾਸ਼ਿਤ ਕਰਦੇ ਹਾਂ, ਜਿਸ ਨੂੰ ਸਟੂਡੈਂਟ ਵੰਡ ਕਿਹਾ ਜਾਂਦਾ ਹੈ।

ਦਿਲਚਸਪ ਤੱਥ: ਸਟੂਡੈਂਟ ਵੰਡ ਦਾ ਨਾਮ ਗਣਿਤਜੀ ਵਿਲੀਅਮ ਸੀਲੀ ਗੋਸੇਟ ਦੇ ਨਾਮ 'ਤੇ ਰੱਖਿਆ ਗਿਆ ਹੈ, ਜਿਸ ਨੇ ਆਪਣਾ ਪੇਪਰ "ਸਟੂਡੈਂਟ" ਉਪਨਾਮ ਦੇ ਤਹਿਤ ਪ੍ਰਕਾਸ਼ਿਤ ਕੀਤਾ। ਉਹ ਗਿਨੀਜ਼ ਬਰੂਅਰੀ ਵਿੱਚ ਕੰਮ ਕਰਦਾ ਸੀ, ਅਤੇ, ਇੱਕ ਵਰਜਨ ਦੇ ਅਨੁਸਾਰ, ਉਸਦੇ ਨਿਯਮਕ ਨੇ ਨਹੀਂ ਚਾਹਿਆ ਕਿ ਆਮ ਜਨਤਾ ਨੂੰ ਪਤਾ ਲੱਗੇ ਕਿ ਉਹ ਕੱਚੇ ਸਮੱਗਰੀ ਦੀ ਗੁਣਵੱਤਾ ਨਿਰਧਾਰਤ ਕਰਨ ਲਈ ਅੰਕੜੇਕਸ਼ੀ ਪਰੀਖਣਾਂ ਦੀ ਵਰਤੋਂ ਕਰ ਰਹੇ ਹਨ।

ਜੇਕਰ ਅਸੀਂ ਭਰੋਸੇ p ਦੇ ਨਾਲ ਸਾਡੇ ਵੰਡ ਦੇ ਔਸਤ μ ਦਾ ਅਨੁਮਾਨ ਲਗਾਉਣਾ ਚਾਹੁੰਦੇ ਹਾਂ, ਤਾਂ ਸਾਨੂੰ ਸਟੂਡੈਂਟ ਵੰਡ A ਦੇ (1-p)/2-ਵੇਂ ਪ੍ਰਤੀਸ਼ਤਕ ਨੂੰ ਲੈਣਾ ਪਵੇਗਾ, ਜੋ ਜਾਂ ਤਾਂ ਟੇਬਲਾਂ ਤੋਂ ਲਿਆ ਜਾ ਸਕਦਾ ਹੈ, ਜਾਂ ਅੰਕੜੇਕਸ਼ੀ ਸਾਫਟਵੇਅਰ (ਜਿਵੇਂ ਕਿ Python, R, ਆਦਿ) ਦੇ ਕੁਝ ਬਿਲਟ-ਇਨ ਫੰਕਸ਼ਨਾਂ ਦੀ ਵਰਤੋਂ ਕਰਕੇ ਗਣਨਾ ਕੀਤੀ ਜਾ ਸਕਦੀ ਹੈ। ਫਿਰ μ ਲਈ ਅੰਤਰਾਲ X±A*D/√n ਦੇ ਰੂਪ ਵਿੱਚ ਦਿੱਤਾ ਜਾਵੇਗਾ, ਜਿੱਥੇ X ਨਮੂਨੇ ਦਾ ਪ੍ਰਾਪਤ ਔਸਤ ਹੈ, D ਮਿਆਰੀ ਵਿਸਥਾਪਨ ਹੈ।

ਨੋਟ: ਅਸੀਂ ਡਿਗਰੀਜ਼ ਆਫ ਫ੍ਰੀਡਮ ਦੇ ਇੱਕ ਮਹੱਤਵਪੂਰਨ ਧਾਰਨਾ ਦੀ ਚਰਚਾ ਵੀ ਛੱਡ ਰਹੇ ਹਾਂ, ਜੋ ਸਟੂਡੈਂਟ ਵੰਡ ਦੇ ਸਬੰਧ ਵਿੱਚ ਮਹੱਤਵਪੂਰਨ ਹੈ। ਇਸ ਧਾਰਨਾ ਨੂੰ ਗਹਿਰਾਈ ਨਾਲ ਸਮਝਣ ਲਈ ਅੰਕੜੇਕਸ਼ੀ ਵਿਸ਼ੇ 'ਤੇ ਹੋਰ ਪੂਰੇ ਪੁਸਤਕਾਂ ਨੂੰ ਪੜ੍ਹ ਸਕਦੇ ਹੋ।

ਭਾਰ ਅਤੇ ਉਚਾਈਆਂ ਲਈ ਭਰੋਸੇਮੰਦ ਅੰਤਰਾਲ ਦੀ ਗਣਨਾ ਦਾ ਇੱਕ ਉਦਾਹਰਨ ਸੰਬੰਧਿਤ ਨੋਟਬੁੱਕ ਵਿੱਚ ਦਿੱਤਾ ਗਿਆ ਹੈ।

| p | ਭਾਰ ਦਾ ਔਸਤ |

|---|---|

| 0.85 | 201.73±0.94 |

| 0.90 | 201.73±1.08 |

| 0.95 | 201.73±1.28 |

ਧਿਆਨ ਦਿਓ ਕਿ ਜਿੰਨਾ ਜ਼ਿਆਦਾ ਭਰੋਸੇ ਦੀ ਸੰਭਾਵਨਾ ਹੈ, ਉਨਾ ਚੌੜਾ ਭਰੋਸੇਮੰਦ ਅੰਤਰਾਲ ਹੁੰਦਾ ਹੈ।

ਧਾਰਨਾ ਪਰੀਖਣ

ਸਾਡੇ ਬੇਸਬਾਲ ਖਿਡਾਰੀਆਂ ਦੇ ਡਾਟਾਸੈਟ ਵਿੱਚ, ਵੱਖ-ਵੱਖ ਖਿਡਾਰੀ ਭੂਮਿਕਾਵਾਂ ਹਨ, ਜੋ ਹੇਠਾਂ ਸੰਖੇਪ ਕੀਤੀਆਂ ਜਾ ਸਕਦੀਆਂ ਹਨ (ਇਹ ਟੇਬਲ ਕਿਵੇਂ ਗਣਨਾ ਕੀਤੀ ਜਾ ਸਕਦੀ ਹੈ, ਇਹ ਦੇਖਣ ਲਈ ਸੰਬੰਧਿਤ ਨੋਟਬੁੱਕ 'ਤੇ ਜਾਓ):

| ਭੂਮਿਕਾ | ਉਚਾਈ | ਭਾਰ | ਗਿਣਤੀ |

|---|---|---|---|

| ਕੈਚਰ | 72.723684 | 204.328947 | 76 |

| ਡਿਜ਼ਾਈਨਟਿਡ_ਹਿਟਰ | 74.222222 | 220.888889 | 18 |

| ਫਸਟ_ਬੇਸਮੈਨ | 74.000000 | 213.109091 | 55 |

| ਆਉਟਫੀਲਡਰ | 73.010309 | 199.113402 | 194 |

| ਰੀਲੀਫ_ਪਿਚਰ | 74.374603 | 203.517460 | 315 |

| ਸੈਕੰਡ_ਬੇਸਮੈਨ | 71.362069 | 184.344828 | 58 |

| ਸ਼ਾਰਟਸਟਾਪ | 71.903846 | 182.923077 | 52 |

| ਸਟਾਰਟਿੰਗ_ਪਿਚਰ | 74.719457 | 205.163636 | 221 |

| ਥਰਡ_ਬੇਸਮੈਨ | 73.044444 | 200.955556 | 45 |

ਅਸੀਂ ਦੇਖ ਸਕਦੇ ਹਾਂ ਕਿ ਫਸਟ ਬੇਸਮੈਨ ਦੀ ਔਸਤ ਉਚਾਈ ਸੈਕੰਡ ਬੇਸਮੈਨ ਦੀ ਔਸਤ ਉਚਾਈ ਤੋਂ ਵੱਧ ਹੈ। ਇਸ ਤਰ੍ਹਾਂ, ਅਸੀਂ ਇਹ ਨਿਸਚਿਤ ਕਰਨ ਲਈ ਪ੍ਰੇਰਿਤ ਹੋ ਸਕਦੇ ਹਾਂ ਕਿ ਫਸਟ ਬੇਸਮੈਨ ਸੈਕੰਡ ਬੇਸਮੈਨ ਤੋਂ ਉੱਚੇ ਹਨ।

ਇਸ ਬਿਆਨ ਨੂੰ ਧਾਰਨਾ ਕਿਹਾ ਜਾਂਦਾ ਹੈ, ਕਿਉਂਕਿ ਸਾਨੂੰ ਪਤਾ ਨਹੀਂ ਕਿ ਇਹ ਤੱਥ ਅਸਲ ਵਿੱਚ ਸੱਚ ਹੈ ਜਾਂ ਨਹੀਂ।

ਹਾਲਾਂਕਿ, ਇਹ ਹਮੇਸ਼ਾ ਸਪਸ਼ਟ ਨਹੀਂ ਹੁੰਦਾ ਕਿ ਅਸੀਂ ਇਹ ਨਿਸਚਿਤ ਕਰ ਸਕਦੇ ਹਾਂ। ਉਪਰੋਕਤ ਚਰਚਾ ਤੋਂ ਅਸੀਂ ਜਾਣਦੇ ਹਾਂ ਕਿ ਹਰ ਔਸਤ ਨਾਲ ਇੱਕ ਸੰਬੰਧਿਤ ਭਰੋਸੇਮੰਦ ਅੰਤਰਾਲ ਹੁੰਦਾ ਹੈ, ਅਤੇ ਇਸ ਤਰ੍ਹਾਂ ਇਹ ਅੰਤਰ ਸਿਰਫ ਅੰਕੜੇਕਸ਼ੀ ਗਲਤੀ ਹੋ ਸਕਦੀ ਹੈ। ਸਾਨੂੰ ਆਪਣੀ ਧਾਰਨਾ ਦੀ ਜਾਂਚ ਕਰਨ ਲਈ ਕੁਝ ਹੋਰ ਅਧਿਕਾਰਤ ਤਰੀਕੇ ਦੀ ਲੋੜ ਹੈ।

ਆਓ ਫਸਟ ਅਤੇ ਸੈਕੰਡ ਬੇਸਮੈਨ ਦੀਆਂ ਉਚਾਈਆਂ ਲਈ ਭਰੋਸੇਮੰਦ ਅੰਤਰਾਲ ਨੂੰ ਵੱਖ-ਵੱਖ ਗਣਨਾ ਕਰੀਏ:

| ਭਰੋਸਾ | ਫਸਟ ਬੇਸਮੈਨ | ਸੈਕੰਡ ਬੇਸਮੈਨ |

|---|---|---|

| 0.85 | 73.62..74.38 | 71.04..71.69 |

| 0.90 | 73.56..74.44 | 70.99..71.73 |

| 0.95 | 73.47..74.53 | 70.92..71.81 |

ਅਸੀਂ ਦੇਖ ਸਕਦੇ ਹਾਂ ਕਿ ਕਿਸੇ ਵੀ ਭਰੋਸੇ ਦੇ ਅੰਤਰਾਲ ਵਿੱਚ ਕੋਈ ਓਵਰਲੈਪ ਨਹੀਂ ਹੈ। ਇਹ ਸਾਡੀ ਧਾਰਨਾ ਨੂੰ ਸਾਬਤ ਕਰਦਾ ਹੈ ਕਿ ਫਸਟ ਬੇਸਮੈਨ ਸੈਕੰਡ ਬੇਸਮੈਨ ਤੋਂ ਉੱਚੇ ਹਨ।

ਅਧਿਕਾਰਤ ਤੌਰ 'ਤੇ, ਸਾਡਾ ਸਮੱਸਿਆ ਇਹ ਦੇਖਣ ਦੀ ਹੈ ਕਿ ਦੋ ਸੰਭਾਵਨਾ ਵੰਡ ਇੱਕੋ ਜਿਹੇ ਹਨ, ਜਾਂ ਘੱਟੋ-ਘੱਟ ਇੱਕੋ ਜਿਹੇ ਪੈਰਾਮੀਟਰ ਹਨ। ਵੰਡ ਦੇ ਅਨੁਸਾਰ, ਸਾਨੂੰ ਇਸ ਲਈ ਵੱਖ-ਵੱਖ ਪਰੀਖਣਾਂ ਦੀ ਵਰਤੋਂ ਕਰਨ ਦੀ ਲੋੜ ਹੈ। ਜੇਕਰ ਸਾਨੂੰ ਪਤਾ ਹੈ ਕਿ ਸਾਡੀਆਂ ਵੰਡਾਂ ਸਧਾਰਨ ਹਨ, ਤਾਂ ਅਸੀਂ ਸਟੂਡੈਂਟ ਟੀ-ਟੈਸਟ ਲਾਗੂ ਕਰ ਸਕਦੇ ਹਾਂ।

ਸਟੂਡੈਂਟ ਟੀ-ਟੈਸਟ ਵਿੱਚ, ਅਸੀਂ ਟੀ-ਮੁੱਲ ਦੀ ਗਣਨਾ ਕਰਦੇ ਹਾਂ, ਜੋ ਔਸਤਾਂ ਦੇ ਅੰਤਰ ਨੂੰ ਦਰਸਾਉਂਦਾ ਹੈ, ਵਿਸਥਾਪਨ ਨੂੰ ਧਿਆਨ ਵਿੱਚ ਰੱਖਦੇ ਹੋਏ। ਇਹ ਸਾਬਤ ਕੀਤਾ ਗਿਆ ਹੈ ਕਿ ਟੀ-ਮੁੱਲ ਸਟੂਡੈਂਟ ਵੰਡ ਦੀ ਪਾਲਨਾ ਕਰਦਾ ਹੈ, ਜੋ ਸਾਨੂੰ ਦਿੱਤੇ ਗਏ ਭਰੋਸੇ ਦੇ ਪੱਧਰ p ਲਈ ਥ੍ਰੈਸ਼ਹੋਲਡ ਮੁੱਲ ਪ੍ਰਾਪਤ ਕਰਨ ਦੀ ਆਗਿਆ ਦਿੰਦਾ ਹੈ (ਇਹ ਗਣਨਾ ਕੀਤੀ ਜਾ ਸਕਦੀ ਹੈ, ਜਾਂ ਅੰਕੜੇਕਸ਼ੀ ਟੇਬਲਾਂ ਵਿੱਚ ਦੇਖਿਆ ਜਾ ਸਕਦਾ ਹੈ)। ਫਿਰ ਅਸੀਂ ਟੀ-ਮੁੱਲ ਨੂੰ ਇਸ ਥ੍ਰੈਸ਼ਹੋਲਡ ਨਾਲ ਤੁਲਨਾ ਕਰਦੇ ਹਾਂ ਤਾਂ ਕਿ ਧਾਰਨਾ ਨੂੰ ਮਨਜ਼ੂਰ ਜਾਂ ਰੱਦ ਕੀਤਾ ਜਾ ਸਕੇ।

Python ਵਿੱਚ, ਅਸੀਂ SciPy ਪੈਕੇਜ ਦੀ ਵਰਤੋਂ ਕਰ ਸਕਦੇ ਹਾਂ, ਜਿਸ ਵਿੱਚ ttest_ind ਫੰਕਸ਼ਨ ਸ਼ਾਮਲ ਹੈ (ਕਈ ਹੋਰ ਉਪਯੋਗ ਅੰਕੜੇਕਸ਼ੀ ਫੰਕਸ਼ਨਾਂ ਦੇ ਨਾਲ!)। ਇਹ ਸਾਡੇ ਲਈ ਟੀ-ਮੁੱਲ ਦੀ ਗਣਨਾ ਕਰਦਾ ਹੈ, ਅਤੇ ਭਰੋਸੇ p-ਮੁੱਲ ਦੀ ਵਿਰੋਧੀ ਖੋਜ ਵੀ ਕਰਦਾ ਹੈ, ਤਾਂ ਜੋ ਅਸੀਂ ਸਿਰਫ ਭਰੋਸੇ ਨੂੰ ਦੇਖ ਕੇ ਨਿਸਚਿਤ ਕਰ ਸਕੀਏ।

ਉਦਾਹਰਨ ਲਈ, ਫਸਟ ਅਤੇ ਸੈਕੰਡ ਬੇਸਮੈਨ ਦੀਆਂ ਉਚਾਈਆਂ ਦੇ ਤੁਲਨਾਤਮਕ ਨਤੀਜੇ ਹੇਠਾਂ ਦਿੱਤੇ ਗਏ ਹਨ:

from scipy.stats import ttest_ind

tval, pval = ttest_ind(df.loc[df['Role']=='First_Baseman',['Height']], df.loc[df['Role']=='Designated_Hitter',['Height']],equal_var=False)

print(f"T-value = {tval[0]:.2f}\nP-value: {pval[0]}")

T-value = 7.65

P-value: 9.137321189738925e-12

ਸਾਡੇ ਮਾਮਲੇ ਵਿੱਚ, p-ਮੁੱਲ ਬਹੁਤ ਘੱਟ ਹੈ, ਜਿਸਦਾ ਅਰਥ ਹੈ ਕਿ ਫਸਟ ਬੇਸਮੈਨ ਦੇ ਉੱਚੇ ਹੋਣ ਦੇ ਹੱਕ ਵਿੱਚ ਮਜ਼ਬੂਤ ਸਬੂਤ ਹਨ।

ਇਸ ਤੋਂ ਇਲਾਵਾ, ਹੋਰ ਵੱਖ-ਵੱਖ ਕਿਸਮਾਂ ਦੀਆਂ ਧਾਰਨਾਵਾਂ ਹਨ ਜਿਨ੍ਹਾਂ ਦੀ ਅਸੀਂ ਜਾਂਚ ਕਰ ਸਕਦੇ ਹਾਂ, ਉਦਾਹਰਨ ਲਈ:

- ਸਾਬਤ ਕਰਨਾ ਕਿ ਦਿੱਤਾ ਗਿਆ ਨਮੂਨਾ ਕੁਝ ਵੰਡ ਦੀ ਪਾਲਨਾ ਕਰਦਾ ਹੈ। ਸਾਡੇ ਮਾਮਲੇ ਵਿੱਚ ਅਸੀਂ ਮੰਨਿਆ ਹੈ ਕਿ ਉਚਾਈਆਂ ਸਧਾਰਨ ਵੰਡੀਆਂ ਹਨ, ਪਰ ਇਸਦੀ ਅੰਕੜੇਕਸ਼ੀ ਪੁਸ਼ਟੀ ਦੀ ਲੋੜ ਹੈ।

- ਸਾਬਤ ਕਰਨਾ ਕਿ ਨਮੂਨੇ ਦਾ ਔਸਤ ਮੁੱਲ ਕੁਝ ਪੂਰਵ-ਨਿਰਧਾਰਤ ਮੁੱਲ ਦੇ ਅਨੁਕੂਲ ਹੈ।

- ਕਈ ਨਮੂਨਿਆਂ ਦੇ ਔਸਤਾਂ ਦੀ ਤੁਲਨਾ ਕਰਨਾ (ਉਦਾਹਰਨ ਲਈ, ਵੱਖ-ਵੱਖ ਉਮਰ ਸਮੂਹਾਂ ਵਿੱਚ ਖੁਸ਼ੀ ਦੇ ਪੱਧਰਾਂ ਵਿੱਚ ਅੰਤਰ ਕੀ ਹੈ)

ਵੱਡੇ ਨੰਬਰਾਂ ਦਾ ਕਾਨੂੰਨ ਅਤੇ ਕੇਂਦਰੀ ਸੀਮਾ ਸਿਧਾਂਤ

ਇੱਕ ਕਾਰਨ ਕਿ ਸਧਾਰਨ ਵੰਡ ਇੰਨੀ ਮਹੱਤਵਪੂਰਨ ਹੈ, ਇਸ ਨੂੰ ਕੇਂਦਰੀ ਸੀਮਾ ਸਿਧਾਂਤ ਕਿਹਾ ਜਾਂਦਾ ਹੈ। ਮੰਨ ਲਓ ਕਿ ਸਾਡੇ ਕੋਲ N ਅਜ਼ਾਦ ਮੁੱਲਾਂ X1, ..., XN ਦਾ ਇੱਕ ਵੱਡਾ ਨਮੂਨਾ ਹੈ, ਜੋ ਕਿਸੇ ਵੀ ਵੰਡ ਤੋਂ ਔਸਤ μ ਅਤੇ ਵਿਸਥਾਪਨ σ2 ਦੇ ਨਾਲ ਨਮੂਨਾ ਲਿਆ ਗਿਆ ਹੈ। ਫਿਰ, ਕਾਫ਼ੀ ਵੱਡੇ N ਲਈ (ਦੂਜੇ ਸ਼ਬਦਾਂ ਵਿੱਚ, ਜਦੋਂ N→∞), ਔਸਤ ΣiXi ਸਧਾਰਨ ਵੰਡਿਆ ਜਾਵੇਗਾ, ਔਸਤ μ ਅਤੇ ਵਿਸਥਾਪਨ σ2/N ਦੇ ਨਾਲ।

ਕੇਂਦਰੀ ਸੀਮਾ ਸਿਧਾਂਤ ਨੂੰ ਵੱਖ-ਵੱਖ ਤਰੀਕੇ ਨਾਲ ਸਮਝਾਇਆ ਜਾ ਸਕਦਾ ਹੈ ਕਿ ਚਾਹੇ ਕੋਈ ਵੀ ਵੰਡ ਹੋਵੇ, ਜਦੋਂ ਤੁਸੀਂ ਕਿਸੇ ਵੀ ਰੈਂਡਮ ਵੈਰੀਏਬਲ ਮੁੱਲਾਂ ਦੇ ਜੋੜ ਦਾ ਔਸਤ ਗਣਨਾ ਕਰਦੇ ਹੋ, ਤਾਂ ਤੁਸੀਂ ਸਧਾਰਨ ਵੰਡ ਨਾਲ ਖਤਮ ਕਰਦੇ ਹੋ।

ਕੇਂਦਰੀ ਸੀਮਾ ਸਿਧਾਂਤ ਤੋਂ ਇਹ ਵੀ ਨਿਸਚਿਤ ਹੁੰਦਾ ਹੈ ਕਿ, ਜਦੋਂ N→∞, ਨਮੂਨਾ ਔਸਤ μ ਦੇ ਬਰਾਬਰ ਹੋਣ ਦੀ ਸੰਭਾਵਨਾ 1 ਬਣ ਜਾਂਦੀ ਹੈ। ਇਸ ਨੂੰ ਵੱਡੇ ਨੰਬਰਾਂ ਦਾ ਕਾਨੂੰਨ ਕਿਹਾ ਜਾਂਦਾ ਹੈ।

ਸਹ-ਵਿਕਾਸ ਅਤੇ ਸਹ-ਸੰਬੰਧ

ਡਾਟਾ ਸਾਇੰਸ ਦਾ ਇੱਕ ਕੰਮ ਡਾਟਾ ਦੇ ਸਬੰਧਾਂ ਨੂੰ ਖੋਜਣਾ ਹੈ। ਅਸੀਂ ਕਹਿੰਦੇ ਹਾਂ ਕਿ ਦੋ ਲੜੀਆਂ ਸਹ-ਸੰਬੰਧਿਤ ਹਨ ਜਦੋਂ ਉਹ ਇੱਕੋ ਸਮੇਂ ਵਿੱਚ ਇੱਕੋ ਜਿਹੇ ਵਿਹਾਰ ਦਾ ਪ੍ਰਦਰਸ਼ਨ ਕਰਦੀਆਂ ਹਨ, ਅਰਥਾਤ ਉਹ ਇੱਕੋ ਸਮੇਂ ਉੱਪਰ ਜਾਂ ਹੇਠਾਂ ਜਾਂਦੀਆਂ ਹਨ, ਜਾਂ ਇੱਕ ਲੜੀ ਉੱਪਰ ਜਾਂਦੀ ਹੈ ਜਦੋਂ ਦੂਜੀ ਹੇਠਾਂ ਜਾਂਦੀ ਹੈ ਅਤੇ ਵਿਰੋਧੀ। ਦੂਜੇ ਸ਼ਬਦਾਂ ਵਿੱਚ, ਦੋ ਲੜੀਆਂ ਦੇ ਵਿਚਕਾਰ ਕੁਝ ਸਬੰਧ ਜਾਪਦਾ ਹੈ।

ਸਹ-ਸੰਬੰਧ ਲਾਜ਼ਮੀ ਨਹੀਂ ਹੈ ਕਿ ਦੋ ਲੜੀਆਂ ਦੇ ਵਿਚਕਾਰ ਕਾਰਨਾਤਮਕ ਸਬੰਧ ਦਰਸਾਏ; ਕਈ ਵਾਰ ਦੋਵੇਂ ਚਲਾਂ ਕੁਝ ਬਾਹਰੀ ਕਾਰਨ 'ਤੇ ਨਿਰਭਰ ਕਰ ਸਕਦੇ ਹਨ, ਜਾਂ ਇਹ ਸਿਰਫ਼ ਮੌਕੇ ਦੇ ਨਾਲ ਹੋ ਸਕਦਾ ਹੈ ਕਿ ਦੋ ਲੜੀਆਂ ਸਹ-ਸੰਬੰਧਿਤ ਹਨ। ਹਾਲਾਂਕਿ, ਮਜ਼ਬੂਤ ਗਣਿਤਜੀ ਸਹ-ਸੰਬੰਧ ਇਹ ਦਰਸਾਉਣ ਲਈ ਇੱਕ ਚੰਗਾ ਸੰਕੇਤ ਹੈ ਕਿ ਦੋ ਚਲਾਂ ਕਿਸੇ ਤਰੀਕੇ ਨਾਲ ਜੁੜੇ ਹੋਏ ਹਨ।

ਗਣਿਤਜੀ ਤੌਰ 'ਤੇ, ਦੋ ਰੈਂਡਮ ਵੈਰੀਏਬਲਾਂ ਦੇ ਵਿਚਕਾਰ ਸਬੰਧ ਨੂੰ ਦਰਸਾਉਣ ਵਾਲਾ ਮੁੱਖ ਧਾਰਨਾ ਸਹ-ਵਿਕਾਸ ਹੈ, ਜੋ ਇਸ ਤਰ੍ਹਾਂ ਗਣਨਾ ਕੀਤੀ ਜਾਂਦੀ ਹੈ: Cov(X,Y) = E[(X-E(X))(Y-E(Y))]। ਅਸੀਂ ਦੋਵੇਂ ਚਲਾਂ ਦੇ ਔਸਤ ਮੁੱਲਾਂ ਤੋਂ ਵਿਸਥਾਪਨ ਦੀ ਗਣਨਾ ਕਰਦੇ ਹਾਂ, ਅਤੇ ਫਿਰ ਉਹਨਾਂ ਵਿਸਥਾਪਨਾਂ ਦਾ ਗੁਣਨ। ਜੇਕਰ ਦੋਵੇਂ ਚਲਾਂ ਇਕੱਠੇ ਵਿਸਥਾਪਨ ਕਰਦੇ ਹਨ, ਤਾਂ ਗੁਣਨ ਹਮੇਸ਼ਾ ਇੱਕ ਸਕਾਰਾਤਮਕ ਮੁੱਲ ਹੋਵੇਗਾ, ਜੋ ਸਕਾਰਾਤਮਕ ਸਹ-ਵਿਕਾਸ ਵਿੱਚ ਸ਼ਾਮਲ ਹੋਵੇਗਾ। ਜੇਕਰ ਦੋਵੇਂ ਚਲਾਂ ਅਸਮਰਥਿਤ ਵਿਸਥਾਪਨ ਕਰਦੇ ਹਨ (ਅਰਥਾਤ ਇੱਕ ਔਸਤ ਤੋਂ ਹੇਠਾਂ ਜਾਂਦਾ ਹੈ ਜਦੋਂ ਦੂਜਾ ਔਸਤ ਤੋਂ ਉੱਪਰ ਜਾਂਦਾ ਹੈ), ਤਾਂ ਅਸੀਂ ਹਮੇਸ਼ਾ ਨਕਾਰਾਤਮਕ ਸੰਖਿਆਵਾਂ ਪ੍ਰਾਪਤ ਕਰਦੇ ਹਾਂ, ਜੋ ਨਕਾਰਾਤਮਕ ਸਹ-ਵਿਕਾਸ ਵਿੱਚ ਸ਼ਾਮਲ ਹੋਵੇਗਾ। ਜੇਕਰ ਵਿਸਥਾਪਨ ਨਿਰਭਰ ਨਹੀਂ ਹਨ, ਤਾਂ ਉਹ ਲਗਭਗ ਸ਼ੂਨਯ ਵਿੱਚ ਸ਼ਾਮਲ ਹੋਣਗੇ।

ਸਹ-ਵਿਕਾਸ ਦਾ ਅਬਸੋਲਿਊਟ ਮੁੱਲ ਸਾਨੂੰ ਇਹ ਨਹੀਂ ਦੱਸਦਾ ਕਿ ਸਹ-ਸੰਬੰਧ ਕਿੰਨਾ ਵੱਡਾ ਹੈ, ਕਿਉਂਕਿ ਇਹ ਅਸਲ ਮੁੱਲਾਂ ਦੇ ਮਾਪ 'ਤੇ ਨਿਰਭਰ ਕਰਦਾ ਹੈ। ਇਸਨੂੰ ਸਧਾਰਨ ਕਰਨ ਲਈ, ਅਸੀਂ ਦੋਵੇਂ ਚਲਾਂ ਦੇ ਮਿਆਰੀ ਵਿਸਥਾਪਨ ਦੁਆਰਾ ਸਹ-ਵਿਕਾਸ ਨੂੰ ਵੰਡ ਸਕਦੇ ਹਾਂ, ਤਾਂ ਜੋ ਸਹ-ਸੰਬੰਧ ਪ੍ਰਾਪਤ ਕੀਤਾ ਜਾ ਸਕੇ। ਚੰਗੀ ਗੱਲ ਇਹ ਹੈ ਕਿ ਸਹ-ਸੰਬੰਧ ਹਮੇਸ਼ਾ [-1,1] ਦੇ ਰੇਂਜ ਵਿੱਚ ਹੁੰਦਾ ਹੈ, ਜਿੱਥੇ 1 ਮੁੱਲਾਂ ਦੇ ਵਿਚਕਾਰ ਮਜ਼ਬੂਤ ਸਕਾਰਾਤਮਕ ਸਹ-ਸੰਬੰਧ ਦਰਸਾਉਂਦਾ ਹੈ, -1 - ਮਜ਼ਬੂਤ ਨਕਾਰਾਤਮਕ ਸਹ-ਸੰਬੰਧ, ਅਤੇ 0 - ਕੋਈ ਸਹ-ਸੰਬੰਧ ਨਹੀਂ (ਚਲਾਂ ਅਜ਼ਾਦ ਹਨ)।

ਉਦਾਹਰਨ: ਅਸੀਂ ਬੇਸਬਾਲ ਖਿਡਾਰੀਆਂ ਦੇ ਭਾਰ ਅਤੇ ਉਚਾਈਆਂ ਦੇ

ਅਸਵੀਕਰਤੀ:

ਇਹ ਦਸਤਾਵੇਜ਼ AI ਅਨੁਵਾਦ ਸੇਵਾ Co-op Translator ਦੀ ਵਰਤੋਂ ਕਰਕੇ ਅਨੁਵਾਦ ਕੀਤਾ ਗਿਆ ਹੈ। ਜਦੋਂ ਕਿ ਅਸੀਂ ਸਹੀ ਹੋਣ ਦਾ ਯਤਨ ਕਰਦੇ ਹਾਂ, ਕਿਰਪਾ ਕਰਕੇ ਧਿਆਨ ਦਿਓ ਕਿ ਸਵੈਚਾਲਿਤ ਅਨੁਵਾਦਾਂ ਵਿੱਚ ਗਲਤੀਆਂ ਜਾਂ ਅਸੁੱਛਤਾਵਾਂ ਹੋ ਸਕਦੀਆਂ ਹਨ। ਇਸ ਦੀ ਮੂਲ ਭਾਸ਼ਾ ਵਿੱਚ ਮੌਜੂਦ ਮੂਲ ਦਸਤਾਵੇਜ਼ ਨੂੰ ਪ੍ਰਮਾਣਿਕ ਸਰੋਤ ਮੰਨਿਆ ਜਾਣਾ ਚਾਹੀਦਾ ਹੈ। ਮਹੱਤਵਪੂਰਨ ਜਾਣਕਾਰੀ ਲਈ, ਪੇਸ਼ੇਵਰ ਮਨੁੱਖੀ ਅਨੁਵਾਦ ਦੀ ਸਿਫਾਰਸ਼ ਕੀਤੀ ਜਾਂਦੀ ਹੈ। ਇਸ ਅਨੁਵਾਦ ਦੇ ਪ੍ਰਯੋਗ ਤੋਂ ਪੈਦਾ ਹੋਣ ਵਾਲੇ ਕਿਸੇ ਵੀ ਗਲਤਫਹਮੀਆਂ ਜਾਂ ਗਲਤ ਵਿਆਖਿਆਵਾਂ ਲਈ ਅਸੀਂ ਜ਼ਿੰਮੇਵਾਰ ਨਹੀਂ ਹਾਂ।